एका प्रतिमेतून नेव्हिगेबल 3D जगापर्यंत

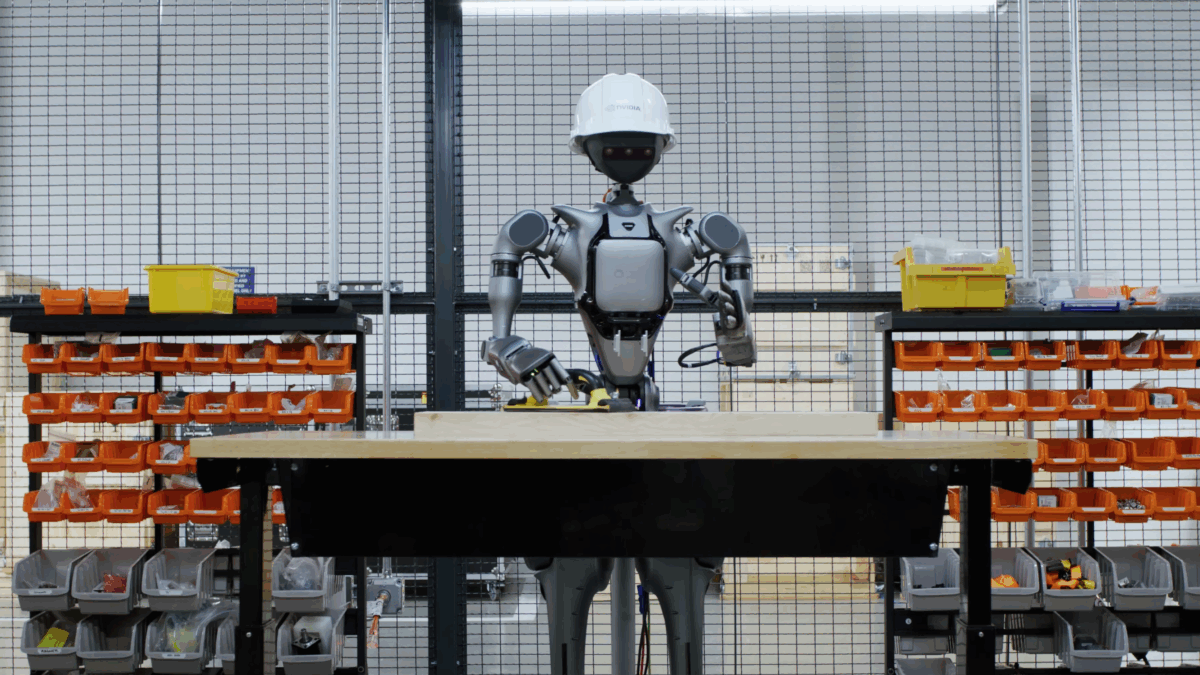

एनव्हिडिया संशोधकांनी Lyra 2.0 सादर केले आहे, ही एक अशी प्रणाली आहे जी एकाच छायाचित्रातून मोठी, सुसंगत 3D वातावरणे तयार करण्यासाठी डिझाइन करण्यात आली आहे. कंपनीचा दावा आहे की ही दृश्ये रिअल टाइममध्ये एक्सप्लोर करता येतात आणि Isaac Sim सारख्या simulation प्लॅटफॉर्मवर export करता येतात, जिथे त्यांचा वापर रोबोट प्रशिक्षणासाठी केला जाऊ शकतो.

हा प्रस्ताव महत्त्वाकांक्षी आहे, पण robotics मधील आधुनिक AI च्या मध्यवर्ती समस्येशी तो चांगला जुळतो: simulation मध्ये agentsना प्रशिक्षण देणे प्रत्यक्ष भौतिक जगात प्रशिक्षण देण्यापेक्षा खूप सोपे, स्वस्त, आणि सुरक्षित आहे. मात्र उपयुक्त simulation अजूनही पुरेसे मोठे, स्थिर, आणि वास्तववादी वातावरण तयार करण्यावर अवलंबून असते. जर एकच प्रतिमा अनेक दहा मीटरपर्यंत पसरलेल्या सुसंगत दृश्याची सुरुवात करू शकत असेल, तर simulation content तयार करण्याचा खर्च लक्षणीयरीत्या कमी होऊ शकतो.

रिपोर्टनुसार, Lyra 2.0 सुमारे 90 मीटरपर्यंत पसरलेली दृश्ये तयार करू शकते. पण केवळ आकारापेक्षा अधिक महत्त्वाचे म्हणजे, मॉडेल पूर्वीच्या पद्धतींच्या दोन सामान्य कमकुवतपणांवर उपाय करते: ते आधी तयार केलेले विसरत नाही, आणि लहान visual चुका एकत्र येऊन मोठे विकृतीकरण होऊ देत नाही.

लांब-पल्ल्याच्या 3D निर्मितीमध्ये अडचण का येते

सध्याच्या 3D scene generation AI प्रणाली बहुतेक वेळा virtual camera आपल्या सुरुवातीच्या बिंदूपासून खूप दूर गेल्यावर खराब होऊ लागतात. रंग बदलतात, geometry बदलते, आणि वातावरण आपली सुसंगती गमावते. camera नंतर आधी पाहिलेल्या जागेत परतल्यास, model ती जागा आधीच्या सातत्यासह जपण्याऐवजी जवळजवळ पुन्हा कल्पून तयार करू शकतो.

रोबोटिक्ससाठी, या अपयशांचा परिणाम केवळ दृश्यात्मक नसतो. शोधादरम्यान स्वतःला थोडेफार बदलणारे simulation वातावरण स्थिर spatial structure वर अवलंबून असलेल्या embodied systems training साठी कमकुवत पाया ठरते. जर जग स्वतःच स्थिर नसेल, तर navigation, manipulation, आणि planning या सर्वांची विश्वासार्हता कमी होते.

म्हणूनच scene coherence novelty पेक्षा महत्त्वाची आहे. उपयुक्त प्रशिक्षण जगात इतकी सुसंगती असावी की agent त्यातून एखाद्या जागेसारखे फिरू शकेल, फक्त संभाव्य प्रतिमांचा प्रवाह म्हणून नव्हे.

Lyra 2.0 समस्या कशी सोडवण्याचा प्रयत्न करते

रिपोर्टनुसार, Lyra 2.0 प्रत्येक तयार केलेल्या frame साठी 3D geometry साठवते. virtual camera आधी भेट दिलेल्या भागाकडे परत गेल्यावर, प्रणाली त्या जुन्या frames पुनर्प्राप्त करते आणि त्यांची spatial माहिती संदर्भ म्हणून वापरते. image synthesis अजूनही video model द्वारे हाताळले जाते, पण साठवलेली geometry orientation जपून सातत्य टिकवण्यासाठी मदत करते.

हे डिझाइन पहिल्या मोठ्या कमकुवतपणावर, म्हणजे विसरण्यावर, लक्ष केंद्रित करते. आधी पाहिलेल्या भागांना stored geometry द्वारे पुन्हा आठवून spatially re-ground करता आले, तर तयार झालेले वातावरण लांब trajectories मध्येही अधिक सुसंगत राहू शकते.

दुसरी समस्या drift आहे, म्हणजे लहान generation चुका पायरीपायरीने वाढत जाणे. रिपोर्टनुसार, एनव्हिडियाचे उत्तर म्हणजे model ला त्याच्या स्वतःच्या त्रुटीपूर्ण outputs विरुद्ध प्रशिक्षित करणे, जेणेकरून ते degradation फक्त स्वीकारण्याऐवजी ओळखणे आणि दुरुस्त करणे शिकेल. ही व्यावहारिक पद्धत आहे. generation स्वच्छ असेल असे गृहीत धरण्याऐवजी, training process model ला ते निर्माण करू शकणाऱ्या noise शी परिचित करते.

Benchmark दावे आणि स्पर्धात्मक संदर्भ

दोन datasets वरच्या benchmark चाचण्यांमध्ये GEN3C, Yume-1.5, आणि CaM यांसह सहा स्पर्धात्मक पद्धतींपेक्षा Lyra 2.0 चांगले ठरले, असे एनव्हिडिया म्हणते. त्या मूल्यांकनांचे पूर्ण तपशील रिपोर्टमध्ये दिलेले नाहीत, त्यामुळे हा स्पर्धात्मक दावा पूर्ण तांत्रिक तुलना म्हणून न वाचता सारांश म्हणून घ्यावा. तरीही, त्याचे महत्त्व स्पष्ट आहे: एनव्हिडिया Lyra 2.0 ला प्रयोगशाळेतील कुतूहल म्हणून नाही, तर दीर्घ-पर्यायी scene generation मधील state-of-the-art उमेदवार म्हणून सादर करत आहे.

हे महत्त्वाचे आहे, कारण हे क्षेत्र खूप गर्दीचे आहे. अनेक संघ image-to-3D, video world models, आणि simulation-friendly generative systems वर काम करत आहेत. वेगळे दिसण्यासाठी, पद्धतीने फक्त आकर्षक demo नव्हे, तर हालचालीदरम्यान टिकणारी scene qualityही दाखवावी लागते.

रोबोटिक्स हेच तातडीचे वापरप्रकरण का

Isaac Sim सारख्या physics engines मध्ये थेट export करण्याचा मार्ग हा रिपोर्टमधील सर्वात महत्त्वाचा तपशील आहे. यावरून असे दिसते की एनव्हिडियाला फक्त visualization किंवा virtual tours साठी content generation मध्ये रस नाही. लक्ष्य embodied AI आहे.

रोबोट प्रशिक्षणात अनेकदा data bottleneck येतो. प्रत्यक्ष जगातील माहिती गोळा करणे महाग असते, आणि हाताने simulation वातावरण तयार करणे वेळखाऊ असते. एका फोटोवरून plausible, एक्सप्लोर करण्यायोग्य 3D जागा तयार करणारी प्रणाली training data जलद वाढविण्यात मदत करू शकते, विशेषतः navigation किंवा interaction tasks साठी जिथे पर्यावरणीय विविधता महत्त्वाची असते.

व्यवहारात, यामुळे developers sparse visual references पासून सुरू करून त्यांना जलदपणे उपयुक्त simulation scenes मध्ये विस्तारित करू शकतात. हे real-world validation ची जागा घेणार नाही, पण pretraining आणि testing pipeline विस्तृत करू शकते.

हे काय सोडवते आणि काय नाही

Lyra 2.0 एक वास्तविक तांत्रिक अडथळा सोडवत आहे, पण त्याला पूर्ण physical realism समजता कामा नये. सुसंगत scene तयार करणे एक गोष्ट आहे. अशी scene तयार करणे ज्याची geometry, materials, dynamics, आणि object affordances robust transfer साठी पुरेशी अचूक असतील, ही दुसरी गोष्ट आहे.

simulation तेव्हाच उपयुक्त ठरते, जेव्हा तिथे शिकलेली वर्तणूक वास्तवाच्या संपर्कात टिकते. उत्कृष्ट visual coherence देखील आपोआप उपयुक्त physics किंवा योग्य object interaction हमी देत नाही. एनव्हिडियाच्या रिपोर्टमध्ये हे अप्रत्यक्षपणे मान्य केले आहे, कारण physics engines कडे export करण्यावर भर दिला आहे; यावरून Lyra चे output हा मोठ्या simulation stack चा एक भाग आहे, पूर्ण उपाय नाही, हे स्पष्ट होते.

स्केलेबल world generation कडे एक पाऊल

तरीही, हे काम महत्त्वाचे आहे, कारण ते क्षेत्राला robot training worlds तयार करण्याच्या अधिक scalable पद्धतीकडे घेऊन जाते. long-path coherence, स्पष्ट geometry recall, आणि drift-aware training यांचे संयोजन पूर्वीच्या प्रणालींना मर्यादा घालणाऱ्या अचूक समस्यांना संबोधित करते. हे फायदे व्यापक वापरातही टिकले, तर Lyra 2.0 robotics development मधील एक लपलेला खर्च कमी करण्यात मदत करू शकते: शिकण्यासाठी पुरेशी जगं तयार करणे.

तीच तर खोल महत्त्वाची गोष्ट आहे. Robotics progress म्हणजे केवळ चांगले policy आणि मोठे model एवढेच नाही. ते चांगल्या environment विषयीही आहे. रोबोट फक्त त्याने पाहिलेल्या जगांतून शिकू शकतो, आणि ती जगं चांगल्या प्रकारे तयार करणे हे स्वतःच वाढत चाललेले AI problem बनत आहे.

हा लेख The Decoder च्या वार्तांकनावर आधारित आहे. मूळ लेख वाचा.

Originally published on the-decoder.com