De uma imagem a um mundo 3D navegável

Pesquisadores da Nvidia apresentaram a Lyra 2.0, um sistema projetado para gerar ambientes 3D grandes e coerentes a partir de uma única fotografia. A empresa diz que os cenários resultantes podem ser explorados em tempo real e exportados para plataformas de simulação como o Isaac Sim, onde podem ser usados para treinar robôs.

A proposta é ambiciosa, mas está bem alinhada com um problema central da IA moderna para robótica: treinar agentes em simulação é muito mais fácil, barato e seguro do que treiná-los exclusivamente no mundo físico, mas uma simulação útil ainda depende da construção de ambientes grandes, estáveis e realistas o bastante para fazer diferença. Se uma única imagem puder iniciar uma cena coerente que se estende por dezenas de metros, isso pode reduzir de forma material o custo de criação de conteúdo para simulação.

Segundo o relatório, a Lyra 2.0 pode gerar cenas com cerca de 90 metros de extensão. Mais importante do que o tamanho bruto, porém, é a afirmação de que o modelo resolve duas fraquezas comuns de métodos anteriores: esquecer o que já foi gerado e acumular pequenos erros visuais que, com o tempo, se transformam em distorções maiores.

Por que a geração 3D em longos trajetos é difícil

Sistemas de IA existentes para geração de cenas 3D costumam degradar à medida que a câmera virtual se afasta do ponto inicial. As cores derivam, a geometria muda e o ambiente perde consistência. Se a câmera depois retorna a uma área que já havia visto, o modelo pode efetivamente inventar aquele local novamente, em vez de preservar a continuidade com a vista anterior.

Para a robótica, essas falhas não são cosméticas. Um ambiente de simulação que se remodela sutilmente durante a exploração é uma base fraca para treinar sistemas incorporados que dependem de uma estrutura espacial estável. Navegação, manipulação e planejamento ficam menos confiáveis se o próprio mundo não for persistente.

É por isso que a coerência da cena importa mais do que a novidade. Um mundo de treinamento utilizável precisa de consistência suficiente para que um agente possa se mover por ele como se fosse um lugar, e não apenas uma sequência de imagens plausíveis.

Como a Lyra 2.0 tenta corrigir o problema

O relatório diz que a Lyra 2.0 armazena a geometria 3D de cada quadro gerado. Quando a câmera virtual retorna a uma área visitada anteriormente, o sistema recupera esses quadros anteriores e usa suas informações espaciais como material de referência. A síntese de imagem ainda é feita pelo modelo de vídeo, mas a geometria armazenada serve para preservar a orientação e ajudar a manter a continuidade.

Esse desenho ataca a primeira grande fraqueza dos sistemas anteriores: o esquecimento. Se regiões já vistas podem ser lembradas e reancoradas por meio da geometria armazenada, o ambiente gerado tem mais chance de permanecer coerente em trajetórias mais longas.

O segundo problema é o desvio, em que pequenos erros de geração se acumulam passo a passo. A resposta da Nvidia, segundo o relatório, é treinar o modelo contra suas próprias saídas defeituosas para que ele aprenda a reconhecer e corrigir a degradação, em vez de simplesmente herdá-la. É uma estratégia prática. Em vez de fingir que a geração será limpa, o processo de treinamento expõe o modelo ao ruído que ele provavelmente criará.

Reivindicações de benchmark e contexto competitivo

A Nvidia diz que a Lyra 2.0 superou seis abordagens concorrentes, incluindo GEN3C, Yume-1.5 e CaM, em testes de benchmark com dois conjuntos de dados. O relatório não traz todos os detalhes dessas avaliações, então a afirmação competitiva deve ser lida como um resumo, e não como uma comparação técnica completa. Ainda assim, o significado fica claro: a Nvidia está apresentando a Lyra 2.0 não como uma curiosidade de laboratório, mas como uma candidata de ponta em geração de cenas de longo alcance.

Esse enquadramento importa porque o campo é bastante concorrido. Muitos grupos trabalham com imagem para 3D, modelos de mundo em vídeo e sistemas generativos adequados à simulação. Para se destacar, um método precisa mostrar não apenas demos atraentes, mas também qualidade persistente da cena sob movimento.

Por que a robótica é o caso de uso imediato

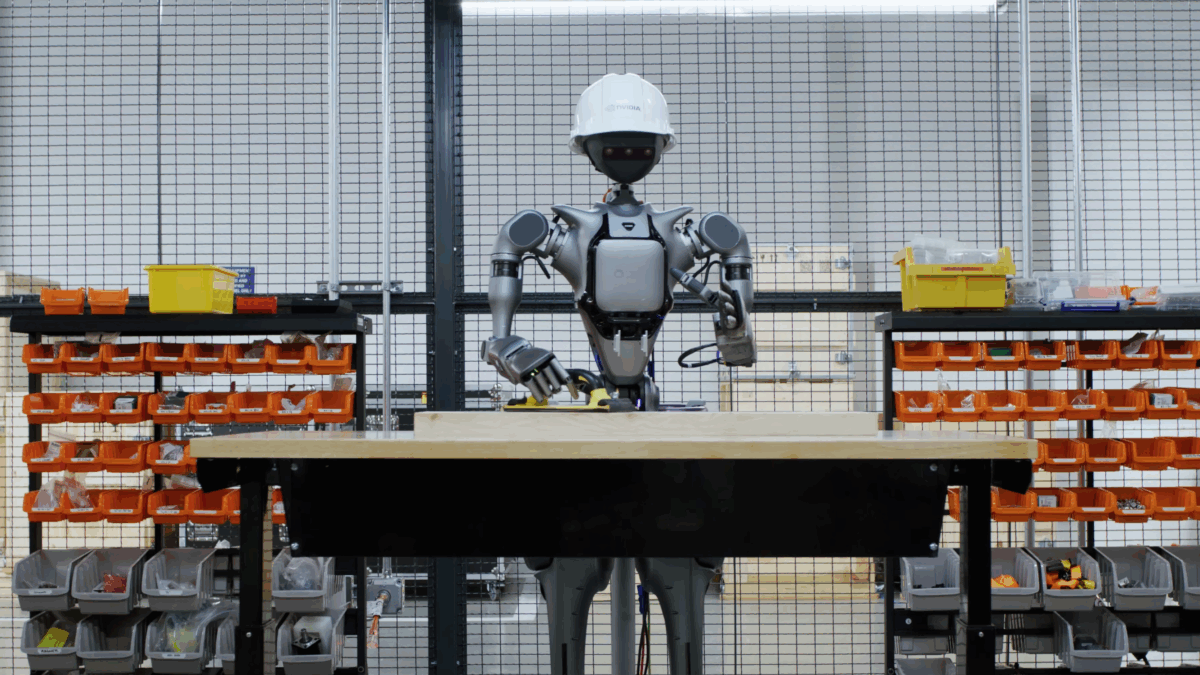

O caminho direto de exportação para motores físicos como o Isaac Sim é um dos detalhes mais importantes do relatório. Isso sugere que a Nvidia não está interessada apenas em geração de conteúdo para visualização ou passeios virtuais. O alvo é a IA incorporada.

O treinamento de robôs costuma sofrer com um gargalo de dados. A coleta no mundo real é cara, e construir ambientes simulados manualmente leva tempo. Um sistema capaz de gerar espaços 3D plausíveis e exploráveis a partir de uma única foto pode ajudar a ampliar os dados de treinamento mais rapidamente, especialmente para tarefas de navegação ou interação em que a diversidade do ambiente importa.

Na prática, isso poderia permitir que desenvolvedores começassem com referências visuais escassas e as expandissem rapidamente em cenas de simulação utilizáveis. O resultado não substituiria a validação no mundo real, mas poderia ampliar o pipeline de pré-treinamento e testes.

O que isso resolve e o que não resolve

A Lyra 2.0 enfrenta um obstáculo técnico real, mas não deve ser confundida com realismo físico completo. Gerar uma cena coerente é uma coisa. Gerar uma cena cuja geometria, materiais, dinâmica e affordances dos objetos sejam precisos o bastante para uma transferência robusta para robôs reais é outra.

Essa distinção importa porque a simulação só é valiosa na medida em que os comportamentos aprendidos nela sobrevivam ao contato com a realidade. Mesmo uma excelente coerência visual não garante automaticamente física útil ou interação correta com objetos. O relatório da Nvidia reconhece isso indiretamente ao enfatizar a exportação para motores físicos, o que sugere que a saída da Lyra faz parte de uma pilha de simulação mais ampla, e não de uma solução completa por si só.

Um passo em direção à geração escalável de mundos

Mesmo assim, o trabalho é notável porque move o campo em direção a uma forma mais escalável de construir mundos de treinamento para robôs. A combinação de coerência em trajetórias longas, recuperação explícita de geometria e treinamento sensível ao desvio ataca exatamente os problemas que limitaram sistemas anteriores. Se esses ganhos se mantiverem em uso mais amplo, a Lyra 2.0 pode ajudar a reduzir um dos custos ocultos do desenvolvimento em robótica: construir mundos suficientes para os robôs aprenderem.

Esse é o significado mais profundo. O progresso em robótica não depende apenas de políticas melhores e modelos maiores. Ele também depende de ambientes melhores. Um robô só pode aprender com os mundos que vê, e gerar bem esses mundos está se tornando um problema de IA cada vez mais importante por si só.

Este artigo é baseado na cobertura do The Decoder. Leia o artigo original.

Originally published on the-decoder.com