GPT-5.4 Thinking म्हणजे काय?

OpenAI ने आपले नवीनतम frontier reasoning मॉडेल, GPT-5.4 Thinking जारी केले आहे, एक तपशीलवार system card सह ज्या मॉडेलचे capabilities, safety evaluations आणि limitations दस्तऐवज करते. हा प्रकाशन OpenAI च्या AI systems विकसित करण्याच्या प्रयत्नात आणखी एक पाऊल चिन्हांकित करते जे complex, multi-step समस्या सोडवण्यात सक्षम आहेत extended reasoning chains माध्यमे final answers प्रदान करण्यापूर्वी.

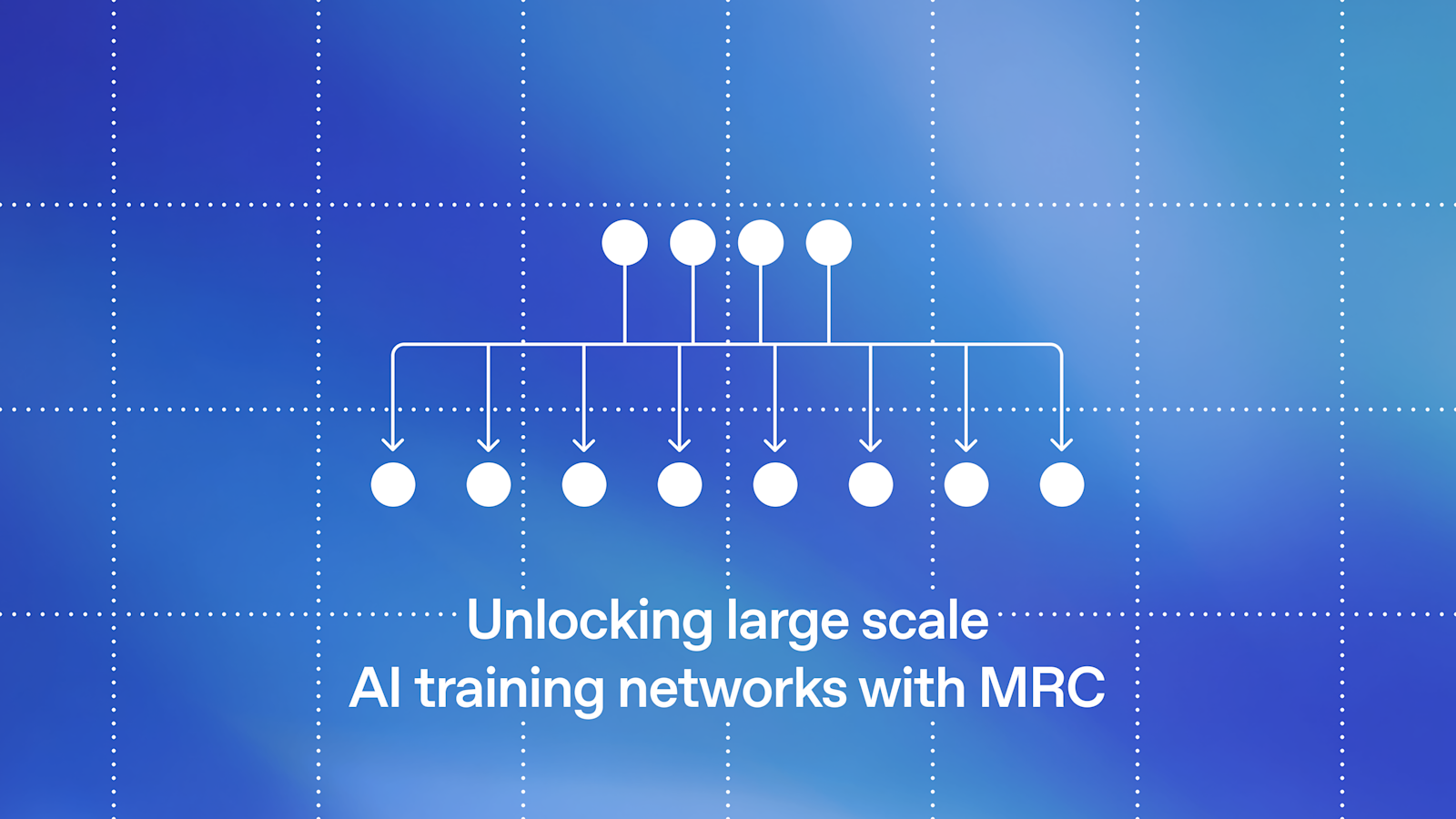

Standard language models च्या विपरीत जे deliberation शिवाय token-by-token responses निर्माण करतात, GPT-5.4 Thinking chain-of-thought reasoning वापरते — समस्या अंतर्गत काम करते output साठी प्रतिबद्ध होण्यापूर्वी. हा architecture मॉडेलला mathematical proofs, complex coding tasks, scientific reasoning, आणि nuanced logical analysis substantially greater accuracy सह पूर्वज्ञान systems च्या तुलनेत हाताळण्यात सक्षम करते.

System card, ज्या OpenAI सर्व frontier models साठी प्रकाशित करते, deployment च्या आधी AI चे मूल्यांकन कसे केले जाते याचे एक transparent view प्रदान करते. हे safety benchmarks, red-team results, potential misuse risks, आणि specific mitigations implemented समाविष्ट करते — researchers आणि enterprise customers ना नव्या मॉडेलसाठी appropriate use cases चे मूल्यांकन करण्यास आवश्यक माहिती प्रदान करते.

Safety Evaluations आणि Red-Teaming Results

GPT-5.4 Thinking साठी Safety testing OpenAI च्या Preparedness Framework चे अनुसरण करते, cybersecurity threats, biological आणि chemical weapons enablement, radiological risk, आणि autonomous resource acquisition पार मॉडेलचे मूल्यांकन करते. System card GPT-5.4 Thinking ला Medium overall risk category मध्ये ठेवते, याचा अर्थ असा की हे standard safety mitigations सह additional restrictions सक्रिय केल्याशिवाय deploy केले जाऊ शकते.

Red-team evaluations ने मॉडेलच्या jailbreaks, indirect prompt injection, आणि multi-step adversarial manipulation च्या विरूद्ध resistance चे परीक्षण केले. GPT-5.4 Thinking ने पूर्वज्ञान पीढीच्या तुलनेत अनेक attack vectors च्या विरूद्ध improved resistance प्रदर्शित केले, जरी हे highly sophisticated adversarial inputs च्या विरूद्ध अपूर्ण राहते — एक caveat जे training sophistication कितीही असो सर्व वर्तमान AI systems ला लागू होते.

Persuasion आणि manipulation capabilities च्या मूल्यांकनात आढळून आले की मॉडेलच्या safety training substantially reduces its willingness deceive किंवा coerce users साठी डिजाइन केलेले content तयार करण्यास. OpenAI ने agentic settings मध्ये behavior चे मूल्यांकन देखील केले, जेथे मॉडेल real-world consequences सह actions च्या sequences घेऊ शकते, आणि Medium classification threshold साठी acceptable safety parameters मध्ये performance आढळले.