1枚の画像から探索可能な3D世界へ

Nvidiaの研究者は、1枚の写真から大規模で整合性のある3D環境を生成するよう設計されたLyra 2.0を発表した。同社によれば、生成されたシーンはリアルタイムで探索でき、Isaac Simのようなシミュレーション基盤へエクスポートして、ロボット訓練に利用できる。

この構想は野心的だが、ロボティクス向け現代AIの中心的な課題とよく合致している。エージェントをシミュレーション内で訓練する方が、物理世界だけで訓練するよりもはるかに簡単で、安価で、安全だが、有用なシミュレーションは、十分に大きく、安定し、現実味のある環境を構築できるかに依存している。1枚の画像が数十メートルに広がる整合的なシーンの起点になり得るなら、シミュレーション用コンテンツ作成のコストを実質的に下げられる可能性がある。

報道によると、Lyra 2.0はおよそ90メートルに及ぶシーンを生成できる。だが、単純なサイズ以上に重要なのは、このモデルが従来手法の2つの典型的な弱点、つまり既に生成した内容を忘れてしまうことと、小さな視覚誤差が蓄積して大きな歪みに発展することに対処しているという点だ。

長距離の3D生成が難しい理由

既存の3Dシーン生成AIは、仮想カメラが出発点から遠ざかるほど品質が劣化しがちだ。色がずれ、幾何が変化し、環境の一貫性が失われる。後でカメラがすでに見た領域に戻ると、モデルはその場所を以前の視点との連続性を保つのではなく、事実上もう一度作り直してしまうことがある。

ロボティクスにとって、こうした失敗は単なる見た目の問題ではない。探索中に微妙に形を変えるシミュレーション環境は、安定した空間構造に依存する具身システムの訓練基盤として脆弱だ。世界そのものが持続しなければ、ナビゲーション、マニピュレーション、計画の信頼性は下がる。

だからこそ、シーンの新規性よりも整合性が重要になる。使える訓練世界には、エージェントが単なるもっともらしい画像列ではなく、場所としてそこを移動できるだけの一貫性が必要だ。

Lyra 2.0はどう問題を解決しようとしているのか

報道によれば、Lyra 2.0は生成した各フレームの3Dジオメトリを保存する。仮想カメラが以前訪れた領域に戻ると、システムは過去のフレームを取り出し、その空間情報を参照素材として利用する。画像合成自体はビデオモデルが担うが、保存されたジオメトリは向きや位置関係を維持し、連続性を保つ助けになるよう設計されている。

この設計は、先行システムの第一の大きな弱点である忘却を狙っている。以前見た領域を思い出し、保存されたジオメトリを通じて再度固定できれば、生成環境はより長い軌跡でも整合性を保ちやすくなる。

第二の問題はドリフトだ。小さな生成誤差が一歩ごとに積み上がっていく。報道によるとNvidiaの解決策は、モデル自身の欠陥のある出力に対して訓練し、劣化を単に引き継ぐのではなく、それを認識して修正することを学ばせるというものだ。これは実用的な戦略で、生成がきれいに進むと仮定するのではなく、起こりうるノイズに訓練段階で触れさせるやり方だ。

ベンチマークの主張と競争環境

Nvidiaは、Lyra 2.0が2つのデータセットを用いたベンチマークテストで、GEN3C、Yume-1.5、CaMを含む6つの競合手法を上回ったと述べている。報道には評価の詳細は示されていないため、この競争的な主張は完全な技術比較ではなく要約として読むべきだ。それでも意味は明確だ。NvidiaはLyra 2.0を研究室の珍品ではなく、長距離シーン生成における最先端候補として提示している。

この位置づけが重要なのは、この分野が非常に混み合っているからだ。多くのチームが画像から3Dへの変換、動画ベースの世界モデル、シミュレーション向け生成システムに取り組んでいる。際立つには、魅力的なデモを見せるだけでなく、移動中でもシーン品質を持続させる必要がある。

なぜロボティクスが最初の用途なのか

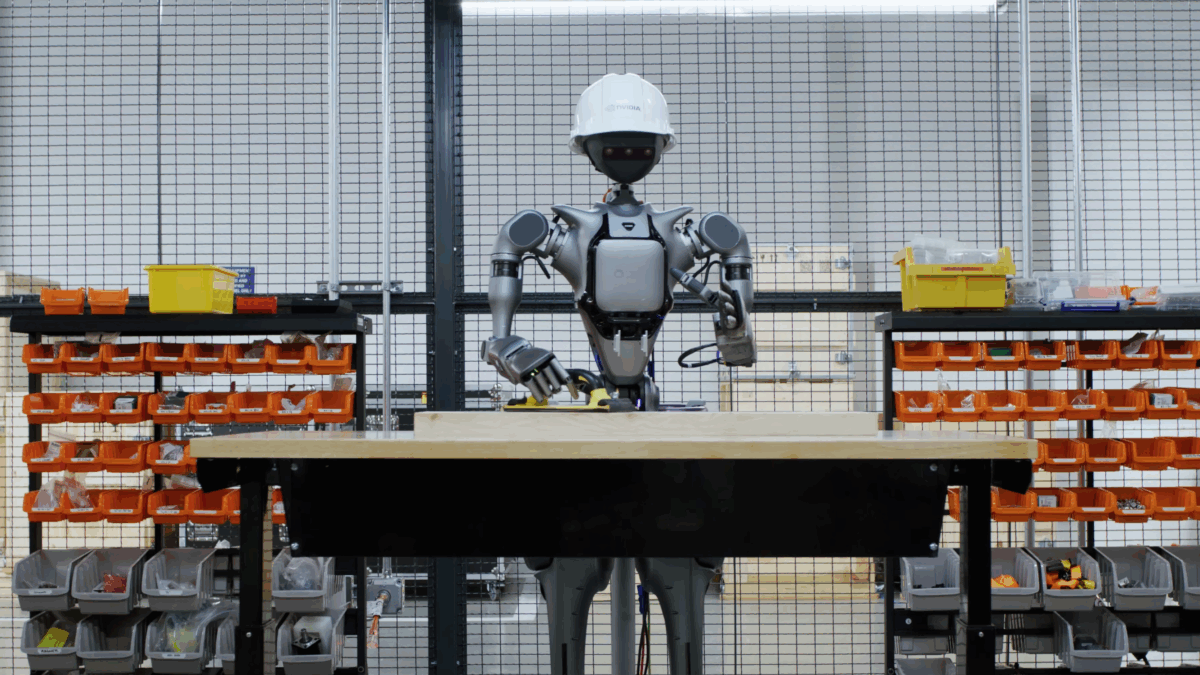

Isaac Simのような物理エンジンへ直接エクスポートできる点は、報道の中でも特に重要だ。これは、Nvidiaが単なる可視化や仮想ツアー向けコンテンツ生成に興味があるのではなく、具身体AIを狙っていることを示している。

ロボット訓練はしばしばデータ不足に悩まされる。現実世界での収集は高価であり、シミュレーション環境を手作業で構築するには時間がかかる。1枚の写真からもっともらしく探索可能な3D空間を生成できるシステムは、特に環境の多様性が重要なナビゲーションや相互作用のタスクで、訓練データの拡張を加速できる可能性がある。

実務的には、開発者が少ない視覚的参照から始め、それをすぐに使えるシミュレーションシーンへと拡張できるようになるかもしれない。もちろん現実世界での検証を置き換えるものではないが、事前訓練と検証のパイプラインを広げることはできる。

何を解決し、何を解決しないのか

Lyra 2.0は実際の技術的障壁を解決しようとしているが、完全な物理的リアリズムと混同すべきではない。整合的なシーンを生成することと、ジオメトリ、素材、動力学、物体のアフォーダンスが実ロボットへの堅牢な転移に十分な精度を持つシーンを生成することは別問題だ。

この違いは重要だ。シミュレーションの価値は、そこで学んだ行動が現実との接触に耐えられる範囲に限られるからだ。視覚的一貫性が非常に高くても、有用な物理法則や正しい物体相互作用が自動的に保証されるわけではない。Nvidiaの報道が物理エンジンへのエクスポートを強調しているのは、その点を間接的に認めているもので、Lyraの出力は単独の完全解ではなく、より大きなシミュレーション基盤の一部だと示唆している。

スケーラブルな世界生成への一歩

それでもこの取り組みが注目に値するのは、ロボット訓練世界をよりスケーラブルに構築する方向へ分野を押し進めているからだ。長距離の整合性、明示的なジオメトリの再利用、ドリフトを意識した訓練の組み合わせは、まさに従来システムを制約してきた課題に対処している。これらの改善がより広い利用でも維持されるなら、Lyra 2.0はロボティクス開発における隠れたコストの1つ、つまりロボットが学ぶための十分な世界を用意するコストを下げる助けになるかもしれない。

それがより深い意味だ。ロボティクスの進歩は、より良い方策やより大きなモデルだけでなく、より良い環境にもかかっている。ロボットは見た世界からしか学べず、その世界をうまく生成すること自体が、ますます重要なAI課題になっている。

この記事は The Decoder の報道に基づいています。元記事を読む。

Originally published on the-decoder.com