¿Y si el calor que la electrónica suele intentar expulsar pudiera hacer un trabajo útil?

Esa es la premisa detrás de un nuevo enfoque de cómputo analógico informado por un equipo dirigido por investigadores del Instituto para Nanotecnologías de Soldados del MIT. En lugar de tratar el calor residual como un subproducto no deseado, los investigadores lo usaron como el propio portador de la información.

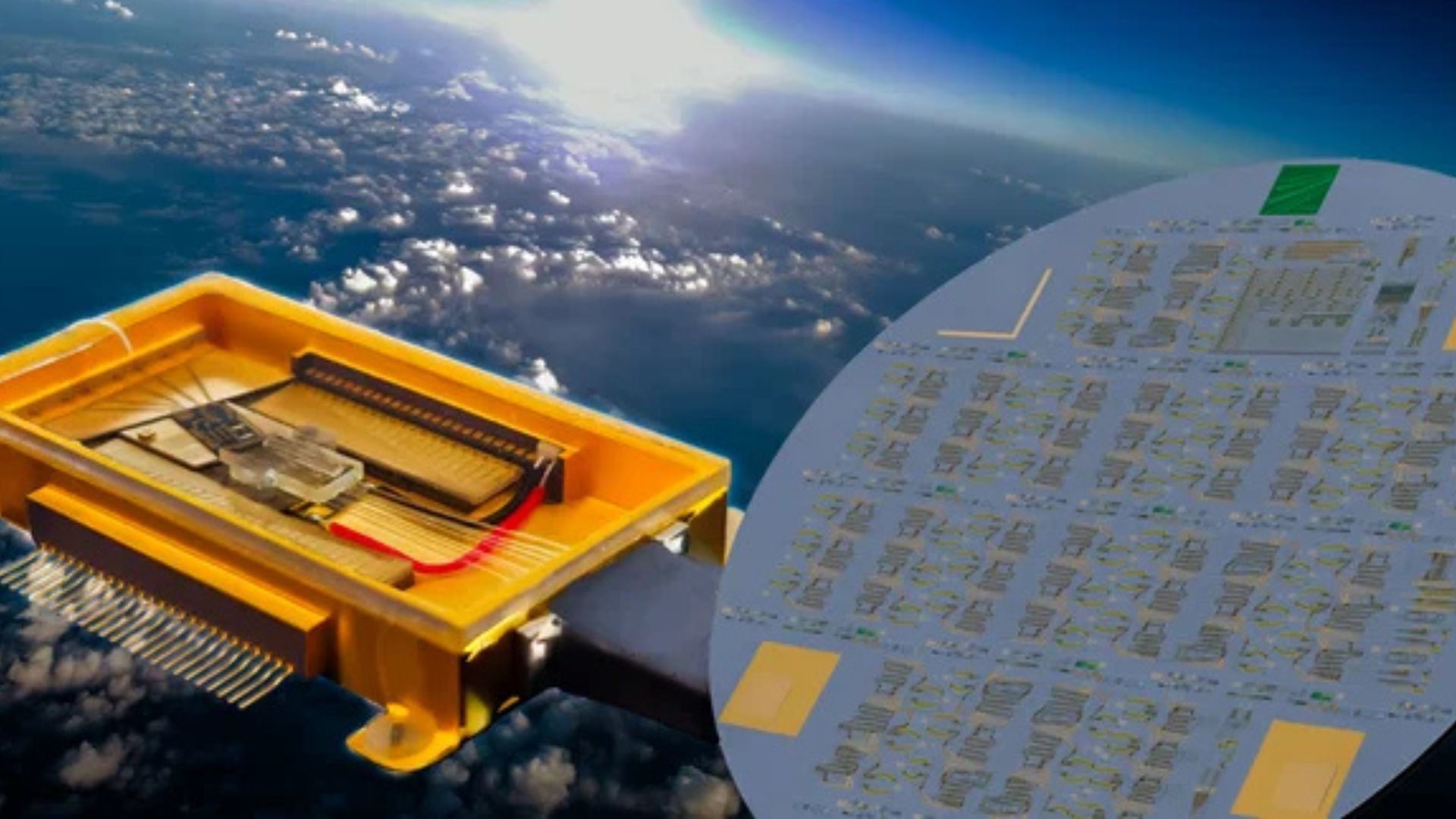

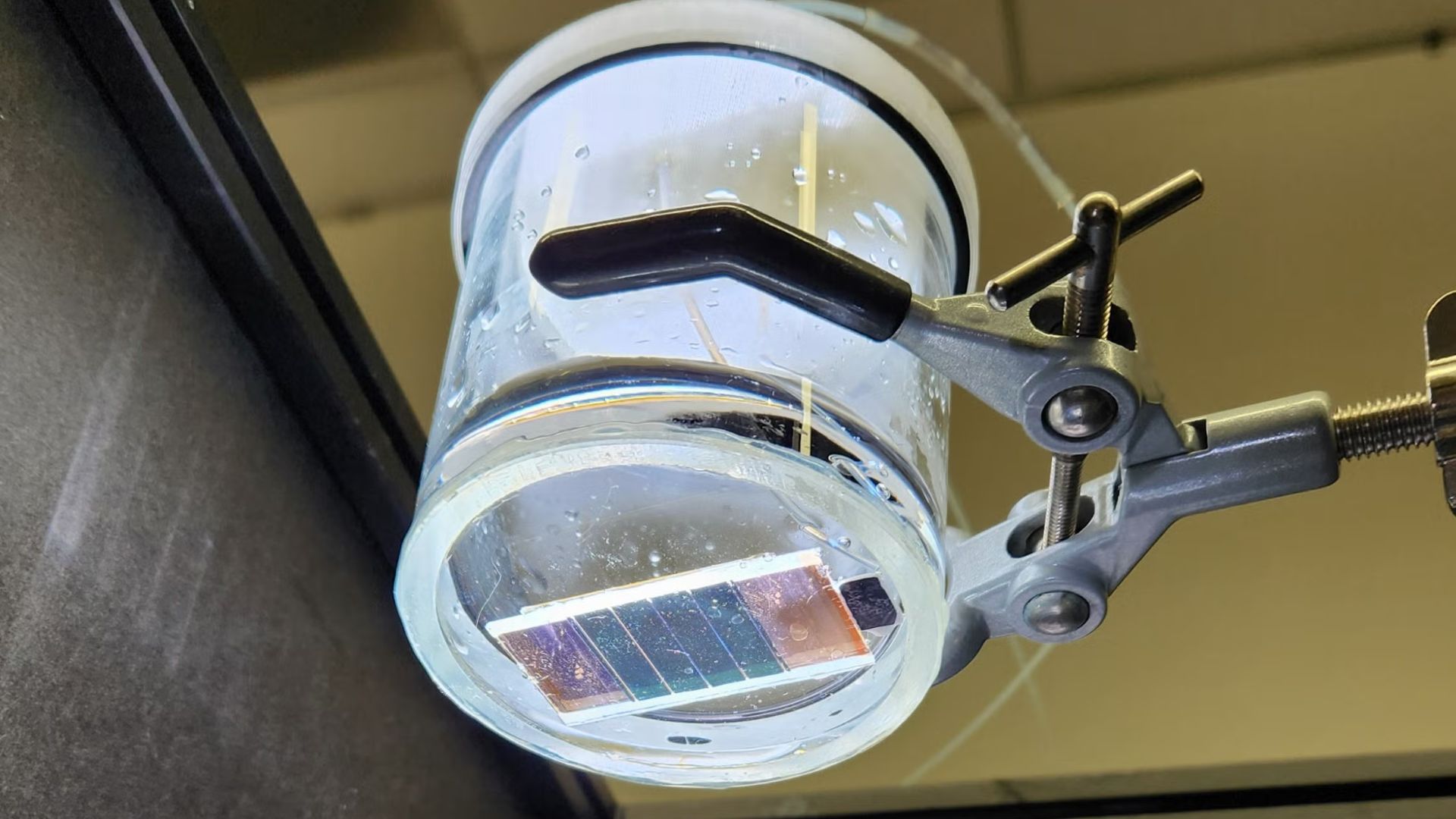

En el sistema descrito en el informe fuente, los datos de entrada no se codifican como valores binarios eléctricos. Se representan como un conjunto de temperaturas basadas en el calor ya presente en un dispositivo. Esa información térmica se desplaza a través de estructuras microscópicas de silicio cuya geometría está diseñada por un algoritmo de optimización basado en la física. La distribución y el flujo de calor resultantes realizan el cálculo, mientras que la salida se representa por la potencia recogida en el otro extremo.

Es una inversión llamativa de la lógica convencional. La mayoría de los sistemas de cómputo modernos funcionan eléctricamente y luego luchan con el calor que producen. Este trabajo plantea si algunas clases de cómputo podrían, en cambio, apoyarse en ese calor, reduciendo potencialmente la necesidad de aportar energía adicional en aplicaciones específicas.

Los investigadores demostraron una operación central usada en aprendizaje automático

El equipo utilizó las estructuras de silicio para llevar a cabo una forma sencilla de multiplicación matriz-vector, una operación matemática que está en el núcleo de los sistemas de aprendizaje automático, incluidos los modelos de lenguaje grandes. Según el texto fuente, los resultados fueron correctos en más del 99 por ciento en muchos casos.

Esa precisión es notable porque las operaciones matriciales son exactamente el tipo de álgebra lineal repetitiva que domina muchas cargas de trabajo de IA. En principio, cualquier método nuevo que pueda ejecutarlas con eficiencia atrae atención. Pero los investigadores son cuidadosos y no exageran lo que han construido.

El informe fuente deja claro que la técnica está muy lejos de estar lista para escalar a los enormes sistemas usados en el aprendizaje profundo moderno. Agrupar millones de estas estructuras térmicas plantearía retos de ingeniería sustanciales. La precisión también disminuye a medida que las matrices se vuelven más complejas y aumenta la distancia entre los terminales de entrada y salida.

Así que no se trata de un reemplazo a corto plazo para los aceleradores digitales de IA. Es mejor entenderlo como una demostración de que el cómputo analógico térmico puede hacerse real y preciso en condiciones limitadas.

Por qué el cómputo analógico basado en calor resulta interesante

El atractivo está en la lógica energética. Si un dispositivo ya genera calor y ese calor puede aprovecharse para realizar tareas de detección o procesamiento de señales, entonces parte de la carga computacional puede trasladarse a un subproducto físico existente en lugar de requerir trabajo eléctrico adicional.

Eso podría importar en dispositivos de borde, electrónica integrada y sistemas en los que la gestión térmica ya es una preocupación importante de diseño. En vez de añadir circuitería extra para medir o procesar información relacionada con la temperatura, un chip podría usar directamente el flujo de calor como sustrato operativo para ciertas tareas.

El informe fuente destaca una posibilidad especialmente inmediata: la detección térmica. Los investigadores dicen que la técnica podría ayudar a detectar fuentes de calor problemáticas y medir cambios de temperatura en la electrónica sin consumir energía extra. También podría reducir la necesidad de múltiples sensores de temperatura que ocupan un área valiosa del chip.

Es posible que esa sea la primera aplicación más realista. Los paradigmas de cómputo revolucionarios suelen encontrar su primer valor no al reemplazar a los procesadores dominantes, sino al resolver mejor que las herramientas existentes un problema más estrecho y urgente.

Una visión distinta del calor dentro de la electrónica

El diseño moderno de chips suele tratar el calor como una restricción de ingeniería. El exceso de calor degrada el rendimiento, acorta la vida de los componentes e impone costos de refrigeración. Por ello, el objetivo dominante es minimizarlo, moverlo o disiparlo.

Esta investigación adopta la postura opuesta. El autor principal, Caio Silva, citado en el texto fuente, señala que el calor normalmente es el producto de desecho del cómputo electrónico. Aquí, el equipo usa el calor como la información misma.

Esa transición es conceptualmente importante. Sugiere que el comportamiento térmico dentro de los dispositivos no solo es un problema a gestionar, sino también un recurso que puede moldearse. Las estructuras de silicio no son canales genéricos. Son geometrías optimizadas diseñadas para que el flujo térmico implemente una transformación deseada.

En efecto, la disposición del material pasa a formar parte del cómputo. Una vez fabricada, la estructura constriñe físicamente cómo se propaga el calor, permitiendo que el dispositivo resuelva una operación prescrita mediante su propia termodinámica.

Los límites son reales, pero también lo es la oportunidad

Muchas ideas experimentales de cómputo tropiezan con la brecha entre una prueba de concepto ingeniosa y una plataforma manufacturable y escalable. Este trabajo afronta claramente esa brecha. El informe fuente señala problemas de escalado, complejidad y pérdida de precisión relacionada con la distancia. Esos no son detalles periféricos. Definen la diferencia entre un resultado de laboratorio y una arquitectura comercialmente viable.

Aun así, la investigación tiene varias cualidades que la hacen digna de seguimiento. Primero, demuestra alta precisión en al menos algunas operaciones matriciales. Segundo, se apoya en estructuras microscópicas de silicio, lo que significa que está anclada en materiales y enfoques de fabricación ya familiares para el mundo de los semiconductores. Tercero, apunta a un cuello de botella en crecimiento: cómo detectar, gestionar y posiblemente aprovechar el comportamiento térmico de una electrónica cada vez más densa.

Incluso si el cómputo analógico basado en calor nunca se convierte en un motor general de IA, podría encontrar un papel en coprocesadores, diagnósticos integrados o funciones especializadas de procesamiento de señales de bajo consumo.

Por qué esto importa en el panorama computacional más amplio

La importancia del trabajo no está tanto en reemplazar el cómputo digital como en ampliar el menú de lo que cuenta como cómputo. A medida que la IA y otras cargas intensivas en datos elevan la demanda de energía, los investigadores están revisando arquitecturas analógicas, fotónicas, neuromórficas y otras no convencionales en busca de ganancias de eficiencia.

Este esfuerzo liderado por MIT encaja de lleno en esa tendencia. Propone que la energía térmica, normalmente tratada como pérdida, podría recuperarse parcialmente como función. En una era en la que cada vatio en un chip importa, esa idea tiene atractivo práctico y filosófico.

El informe fuente no promete un procesador cercano que ejecute grandes modelos de lenguaje solo con calor residual, y no debe leerse de ese modo. Lo que sí ofrece es una prueba creíble de que el calor puede codificarse, dirigirse e interpretarse como información con alta precisión en tareas seleccionadas.

Eso puede ser suficiente para abrir una nueva línea de investigación. La historia de la computación está llena de ejemplos en los que una técnica inicialmente estrecha terminó siendo valiosa porque resolvía de forma inusualmente buena un problema difícil. El cómputo con calor residual podría seguir ese camino. Su primer impacto podría no venir de reemplazar al procesador, sino de convertir la mayor desventaja térmica del chip en una nueva herramienta.

Este artículo se basa en un reportaje de MIT Technology Review. Lee el artículo original.

Originally published on technologyreview.com