భద్రతా పరీక్షలను ఎగతాళి చేయడం నుంచి వాటిని మళ్లీ నిర్మించడం వరకు

ఫ్రాంటియర్ AI పర్యవేక్షణపై ట్రంప్ పరిపాలన తన వైఖరిని బాగా మార్చుకుంది. అధునాతన మోడళ్లను విడుదలకు ముందు, తర్వాత ప్రభుత్వ భద్రతా తనిఖీలకు లోబరచేందుకు Google DeepMind, Microsoft, xAIలతో కొత్త ఒప్పందాలు కుదుర్చుకుంది. ఈ మార్పు అది ఏమి చేస్తోంది అన్న దానికే కాదు, పరిపాలన గత వైఖరి నుండి ఇది ఎంత స్పష్టంగా భిన్నమో అన్న దానికీ ముఖ్యమైంది.

Ars Technica ప్రకారం, అధ్యక్షుడు డొనాల్డ్ ట్రంప్ ముందు బైడెన్ యుగానికి సంబంధించిన స్వచ్ఛంద AI భద్రతా తనిఖీలను ఆవిష్కరణను అడ్డుకునే నియంత్రణ అతిశయంగా కొట్టిపారేశారు. పదవిలోకి వచ్చిన వెంటనే, పరిపాలన US AI Safety Institute పేరును Center for AI Standards and Innovation, లేదా CAISI,గా మార్చి, శీర్షిక నుండి “safety” అనే పదాన్ని తీసేసింది; ఇది మూలం ప్రకారం జో బైడెన్పై ఉద్దేశపూర్వక ఎద్దేవా.

ఇప్పుడు అదే పరిపాలన తాను విమర్శించిన విధాన రూపకల్పనలోని ఒక వెర్షన్ను తిరిగి అమలు చేస్తోంది.

Mythos ప్రేరణ

కనిపించిన మలుపు Anthropic తన తాజా Claude Mythos మోడల్ను విడుదల చేయకూడదని తీసుకున్న నిర్ణయం. Ars Technica నివేదిక ప్రకారం, చెడు ఉద్దేశాలు ఉన్నవారు దాని అధునాతన సైబర్సెక్యూరిటీ సామర్థ్యాలను దుర్వినియోగం చేయవచ్చని భావించి కంపెనీ ఆ మోడల్ను ప్రచురించడానికి చాలా ప్రమాదకరమని నిర్ణయించింది. ఆ నిర్ణయం వాషింగ్టన్లో బలమైన ప్రభావాన్ని చూపినట్లు కనిపిస్తోంది.

మూల పాఠ్యం ప్రకారం, వైట్ హౌస్ నేషనల్ ఎకనామిక్ కౌన్సిల్ డైరెక్టర్ Kevin Hassett, ట్రంప్ త్వరలో విడుదలకు ముందు అధునాతన AI వ్యవస్థలపై ప్రభుత్వ పరీక్షను తప్పనిసరి చేసే executive order జారీ చేయవచ్చని Fortuneకి చెప్పారు. అలా అయితే, పరిపాలన పునరుద్ధరించిన స్వచ్ఛంద సహకారం నుంచి అధికారిక విడుదలకు ముందు మూల్యాంకన విధానానికి మారుతుంది.

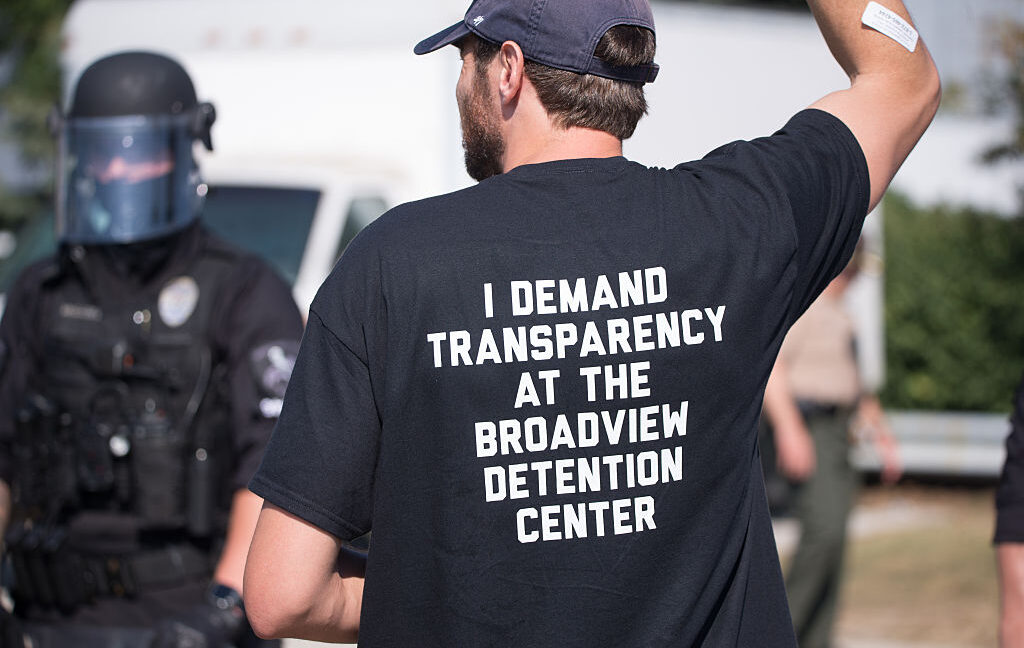

ఈ రాజకీయ వ్యంగ్యం దృష్టికి రాకుండా ఉండటం కష్టం. పురోగతికి అడ్డుగోడగా భద్రతా పర్యవేక్షణను చూపిన వైట్ హౌస్, ఇప్పుడు ఒక ఫ్రాంటియర్ మోడల్ తీవ్ర ఆందోళనలను రేకెత్తించడంతో, దాని డెవలపర్ దాన్ని నిలిపివేయాల్సి వచ్చిన నేపథ్యంలో ఒక ఆదేశాన్ని పరిశీలిస్తోంది.

CAISI పెద్ద పాత్రలోకి

CAISI తన ప్రకటనలో కొత్త ఒప్పందాలు బైడెన్ గత విధానంపై “build on” అవుతాయని స్పష్టంగా చెప్పింది. ఆ భాష ముఖ్యమైనది, ఎందుకంటే అది వాక్చాతుర్య విరామం తర్వాత కూడా కొనసాగింపును అంగీకరిస్తోంది. పరిపాలన బ్రాండింగ్ను మార్చినప్పటికీ, నిర్మిత మోడల్ మూల్యాంకన అవసరం మళ్లీ ప్రాధాన్యం పొందినట్లు కనిపిస్తోంది.

CAISI డైరెక్టర్ Chris Fall, విస్తరించిన పరిశ్రమ భాగస్వామ్యాలు “critical moment”లో ప్రజాప్రయోజనార్థం తమ పనిని విస్తరించడానికి కేంద్రానికి సహాయపడతాయని అన్నారు. మూల పాఠ్యం ప్రకారం, CAISI ఇప్పటివరకు సుమారు 40 మూల్యాంకనాలు పూర్తి చేసింది, వీటిలో ఇంకా విడుదల కాలేని ఫ్రాంటియర్ మోడళ్లపై పరీక్షలు కూడా ఉన్నాయి.

ఈ మూల్యాంకనాలు ప్రత్యేకంగా కీలకమైనవి, ఎందుకంటే CAISIకి తరచుగా తగ్గించిన లేదా తీసివేసిన రక్షణలతో ఉన్న వ్యవస్థలకు ప్రవేశం లభిస్తుంది. దీని వల్ల, ప్రజలకు కనిపించే వినియోగాల ద్వారా మాత్రమే సాధ్యమయ్యేదానికంటే జాతీయ భద్రతకు సంబంధించిన సామర్థ్యాలు మరియు ప్రమాదాలను మరింత సమగ్రంగా అంచనా వేయగలమని ఏజెన్సీ చెబుతోంది.

ప్రయోగాత్మకంగా చూస్తే, ప్రభుత్వం విడుదల తర్వాత మెరుగుపరిచిన ఉత్పత్తులను మాత్రమే సమీక్షించడం లేదు. కొన్ని భద్రతా పొరలు తొలగించినప్పుడు మోడళ్లు ఏమి చేయగలవో కూడా పరిశీలిస్తోంది; ఇది సామర్థ్య అంచనాలో మరింత లోతైన రూపం.

విధాన మార్పుకు జాతీయ భద్రతే దిశానిర్దేశం

పరిపాలన కొత్త వైఖరిని ప్రధానంగా జాతీయ భద్రతా కోణంలో వివరించింది. AI జాతీయ భద్రతా ఆందోళనలపై దృష్టి సారించిన నిపుణుల ఒక interagency task force ఏర్పడిందని CAISI చెబుతోంది; ఇది అంచనాకర్తలు ప్రభుత్వమంతటా ఉద్భవిస్తున్న ప్రమాదాలకు అనుగుణంగా ఉండేలా చేయడమే లక్ష్యం.

ఈ ప్రాధాన్యం ముఖ్యం, ఎందుకంటే ఇది రాజకీయ పునఃస్థాపనను అర్థం చేసుకోవడానికి సహాయపడుతుంది. AI నైతికత లేదా వినియోగదారుల హానిపై సాధారణ చర్చలు పాలకులను సాంప్రదాయ భావజాల రేఖల వెంట విభజించవచ్చు. జాతీయ భద్రతా ప్రశ్నలు ఆ రేఖలను వేగంగా మళ్లీ గీయగలవు. ప్రమాదకరమైన cyber misuse సామర్థ్యం ఉన్నదిగా భావించే మోడల్ను, సాధారణ సాంకేతిక విధాన వివాదం కంటే వ్యూహాత్మక ముప్పుగా చూపడం సులభం.

ఇది AIని ఎలా పాలించాలి అన్న పెద్ద వాదనను ముగించదు, కానీ ప్రస్తుతానికి పరిపాలనను నడిపిస్తున్నది ఏమిటో స్పష్టంగా చెబుతుంది. ఆందోళన అనేది సారాంశమైన భద్రతా బ్రాండింగ్ కాదు. ఫ్రాంటియర్ వ్యవస్థలు ప్రభుత్వ అంచనాకర్తలు ప్రమాద ప్రొఫైల్ను అర్థం చేసుకునేలోపే శత్రుత్వపూరిత actorsకు ఆపరేషనల్ ప్రయోజనం ఇవ్వవచ్చన్న అవకాశం.

ఈ వెనుకమళ్లింపు ఎందుకు ముఖ్యం

కొత్త ఒప్పందాల ప్రాధాన్యం విధానంలోను, సంకేతంలోను ఉంది. విధానపరంగా, ఇవి ప్రధాన AI కంపెనీలు తమ ఫ్రాంటియర్ వ్యవస్థలను విడుదలకు ముందు, తర్వాత ప్రభుత్వ పరిశీలనకు సమర్పించేందుకు మార్గాన్ని పునరుద్ధరిస్తాయి. సంకేతపరంగా, “AI safety” పట్ల వాక్చాతుర్యంగా శత్రుత్వంగా ఉన్న పరిపాలన కూడా, సామర్థ్యాలు వేగంగా పెరిగితే నిర్మిత పర్యవేక్షణకు తిరిగి రావచ్చని సూచిస్తున్నాయి.

పాలుపంచుకుంటున్న సంస్థల ప్రాధాన్యమూ తక్కువ కాదు. Google DeepMind, Microsoft, xAI లాంటి సంస్థలు అగ్రశ్రేణి వ్యవస్థలను నిర్మిస్తున్న లేదా మద్దతిస్తున్న కంపెనీలలో ఉన్నాయి; కాబట్టి వాటి భాగస్వామ్యం ఈ రూపకల్పనకు ఆచరణాత్మక బలం ఇస్తుంది. భవిష్యత్తులో executive order పరీక్షను తప్పనిసరి చేస్తే, ప్రభుత్వం ఇప్పటికే క్రియాశీల సంబంధాలు మరియు కొంత ఆపరేషనల్ చరిత్రను ఆధారంగా తీసుకోగలదు.

అదే సమయంలో, ప్రస్తుత మార్పు కొన్ని అనుత్తరిత ప్రశ్నలను తెరపైకి తీసుకొచ్చింది. కొన్ని సంస్థలు ఒప్పందాలు కుదుర్చుకున్నాయని మూల పాఠ్యం చెబుతోంది, కానీ పూర్తి జాబితా లేదా అమలు వివరాలు ఇవ్వదు. ట్రంప్ executive order ముందుకెళ్తే, “advanced” వ్యవస్థను ఏ ప్రమాణాలతో నిర్వచిస్తారో కూడా అది వివరించదు.

అయినప్పటికీ, దిశ స్పష్టంగా ఉంది. AI safetyని తగ్గించి చూపాలని చూసిన వైట్ హౌస్, ఫ్రాంటియర్ మోడళ్ల ప్రవర్తన మరియు వాటిని నిర్మిస్తున్న కంపెనీల హెచ్చరికల వల్ల మళ్లీ ఆ దిశగా లాగబడింది.

సామర్థ్యంతో మలచబడిన విధాన చర్చ

సైద్ధాంతిక ఆందోళనలు ఆపరేషనల్ ఆందోళనలుగా మారినప్పుడు, AI విధాన వాదనలు ఎంత వేగంగా మారగలవో ఈ ఘటన గుర్తు చేస్తోంది. ట్రంప్ పరిపాలన تدريగా బైడెన్ దృక్కోణం వైపు రాజకీయ సర్దుబాటుతో మళ్లలేదు. ఒక ప్రధాన డెవలపర్ మోడల్ను విడుదల చేయడానికి చాలా ప్రమాదకరమని నిర్ణయించిన ఒక స్పష్టమైన ఘటనకు అది స్పందించింది.

ఆ తేడా ముఖ్యమైనది. ఉద్భవిస్తున్న AI పరిసరాల్లో, సామర్థ్య షాక్లు భావజాల స్థిరత్వం కంటే వేగంగా విధానాన్ని మలచగలవు. పరిపాలన తప్పనిసరి విడుదలకు ముందు పరీక్షను ముందుకు తీసుకెళ్తే, ఫ్రాంటియర్ AI మూల్యాంకనంపై ఇటీవలి అత్యంత బలమైన US చర్యలలో ఒకటి మొదట అటువంటి పర్యవేక్షణ అనవసరం అని భావించిన అధ్యక్షుడి నుంచే వచ్చిందని చెప్పవచ్చు.

- ట్రంప్ పరిపాలన Google DeepMind, Microsoft, xAIలతో కొత్త స్వచ్ఛంద AI భద్రతా పరీక్ష ఒప్పందాలు కుదుర్చుకుంది.

- ఈ చర్య, బైడెన్ కాలం AI భద్రతా తనిఖీలను ముందుగా తిరస్కరించిన వైఖరిని తిరగమారుస్తుంది.

- Anthropic తన Claude Mythos మోడల్ను విడుదల చేయకపోవడం ఈ మార్పును వేగవంతం చేసి ఉండొచ్చు.

- అధునాతన AI వ్యవస్థలకు విడుదలకు ముందు పరీక్షను తప్పనిసరి చేసే executive order ఇప్పుడు పరిశీలనలో ఉంది.

ఈ వ్యాసం Ars Technica నివేదికపై ఆధారపడింది. మూల వ్యాసాన్ని చదవండి.