Android はより能動的な AI プラットフォームになりつつある

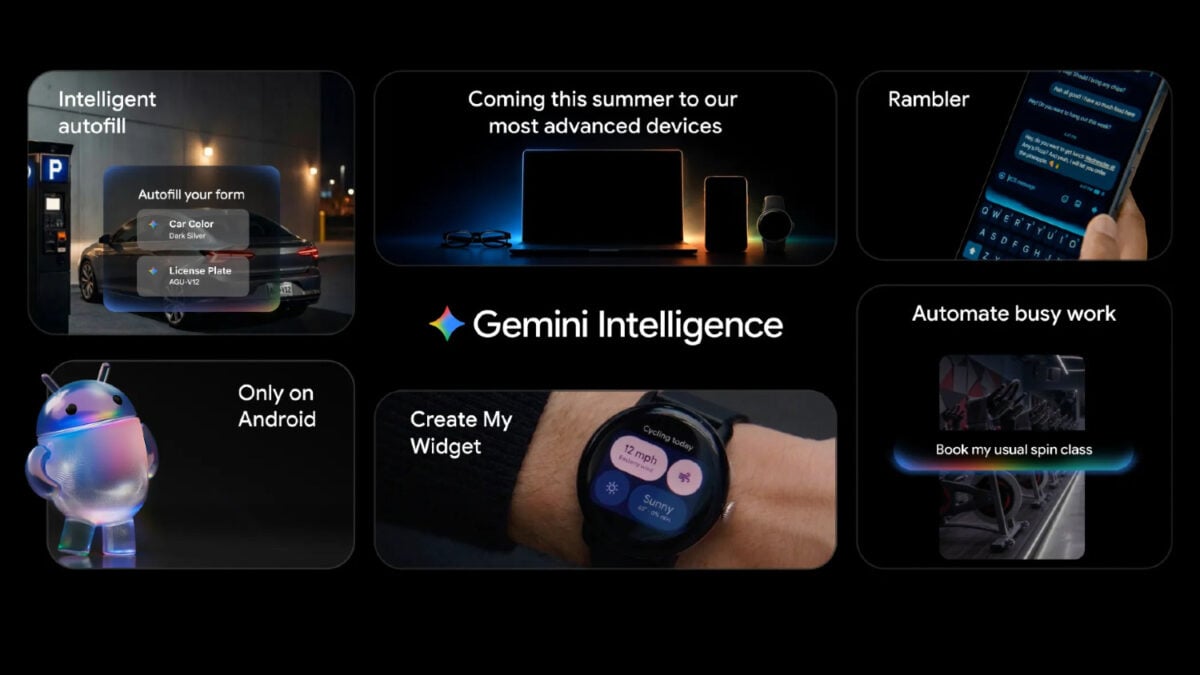

Google は Gemini を Android でより広く展開し、単独のチャットボットにとどまらず、OS 自体の中にさらに深く組み込もうとしている。Google I/O 開発者会議を前に、同社は Gemini Intelligence を発表した。これは、Gemini を日常のモバイル利用により直接的に組み込むことを目的とした、AI 搭載機能の مجموعهだ。

Google の狙いは明確だ。目的は単にプロンプトに答えることではなく、アプリやサービスをまたいでユーザーが先回りして作業を進められるようにすることだという。同社によれば、Gemini Intelligence はプレミアムなハードウェアとソフトウェアの組み合わせによって、Gemini の“最良の部分”を最先端デバイスにもたらす。

この表現が重要なのは、消費者向け AI におけるおなじみの潮流を示しているからだ。競争の焦点は「誰がチャットボットを持っているか」から「誰が AI を日常動作に埋め込めるか」へ移っている。Google の言い方では、Android はその変化の実験場になりつつある。

アシスタントから実行者へ

最も重要なのはタスク自動化だ。Google は Gemini Intelligence を、複数のアプリにまたがる作業を処理できるものとして説明しており、これは多くの大手プラットフォーム企業がここ数カ月示してきたエージェント型モデルへの一歩となる。

Google が挙げた例は派手さより実用性を重視している。システムは、スピニングクラスの最前列の自転車を確保するのを手伝ったり、Gmail の中から授業シラバスを見つけて必要な本をショッピングカートに入れたりできる。さらに、買い物リストの画像を撮って、対応する商品を Instacart のカートに入力することもできる。

これらの例は、スマートフォンにおける AI の最も説得力ある価値は会話ではなく利便性だと Google が賭けていることを示している。機能が安定して動けば、意図から行動へ移るまでのタップ数やアプリ切り替えの回数を減らせる。逆に不安定なら、日常の用事を不透明な自動化の失敗へと変えてしまう恐れがある。

いずれにせよ、戦略的な意図は明快だ。Google は Gemini を、ソフトウェアについて語る存在ではなく、その中で動く存在にしたいのだ。

Rambler と音声入力の次段階

もう一つの注目機能は Rambler だ。これは、フィラーや言い直しを含む自然な話し方に対応するよう設計された音声認識ツールである。ユーザーにきれいに発話することを求めるのではなく、Google によれば Rambler は話された内容の重要な部分を識別し、簡潔なメッセージに整えることができる。

一見すると小さな進化に見えるかもしれないが、音声インターフェースの現実的な弱点を解消するものだ。多くの人は、句読点を付けやすい整った文で話しているわけではない。彼らはその場で言い直し、同じ表現を繰り返し、要点にたどり着く前に話がそれる。そうした話し方をきれいに要約できるシステムは、メッセージ作成やメモ取りの場面で音声入力をより有用にするだろう。

Google はまた、Rambler が同じメッセージ内で異なる言語を切り替えられるとも述べている。この機能は、多言語コミュニケーションが実際にどう行われているかを反映しており、特にコードスイッチングが例外ではなく日常的な地域ではその傾向が強い。

同社はプライバシー面の説明も加え、Rambler が有効なときは明確に表示され、音声はリアルタイム文字起こしのためだけに使われ、保存も保管もされないとしている。

個人データ、オプトイン制御、ブラウザーへの拡張

Google は Gemini Intelligence を通じて、AI を活用した自動入力も拡張している。このシステムは、Personal Intelligence と呼ばれるオプトイン層を利用して、フォームやテキスト欄をユーザーの代わりに入力できる。これにより Gemini は YouTube の閲覧履歴や Google 検索履歴などにアクセスできる。

これは、おそらく展開の中で最も議論を呼ぶ部分の一つになるだろう。自動入力はユーザーの文脈を理解しているほど便利になる一方で、その深い文脈把握は、個人アシスタントがどこまで知るべきか、そしてユーザーがどこまで安心してデータを差し出せるかという予想可能な懸念も生む。Google の答えは、この機能が厳密にオプトインであることを強調することだ。

Gemini は Android 版 Chrome にもさらに深く入っていく。Google は、アシスタントがデスクトップ版に近い形でウェブ上のコンテンツを要約・比較できるようになり、予約のようなブラウザー आधारित tasks を自動化するオートブラウズ機能にもアクセスできるようになると説明している。

これにより、アプリからウェブへと同じ操作ロジックが拡張される。AI は、もともと手動操作のために作られたインターフェースとユーザーの間にある行動レイヤーとして位置づけられている。

段階的な展開とより広い意味

Google は、新機能が段階的に提供され、まずは最新の Samsung Galaxy と Google Pixel 端末から始まると述べている。また、Chrome 関連の一部機能は 6 月に提供予定だとしている。

この段階的な展開は、現在の AI 市場における重要な現実を示している。企業がソフトウェアの進化を普遍的な言葉で語っても、実際にはまずプレミアム端末向け機能として公開されることが多い。これは性能期待やハードウェア要件を抑えやすい一方で、次のスマートフォン AI の段階が当初はより限られたユーザーにしか提供されないことも意味する。

それでも、この発表は明確な方向転換を示している。Gemini はもはや Android の横に並ぶ任意のアシスタントとしてではなく、入力、閲覧、買い物、予定管理、アプリ間連携といったモバイルの中核的な行動に組み込まれつつある。

ユーザーがそれを受け入れるかどうかは、まだ解決していない二つの問いにかかっている。第一は信頼性だ。エージェント型の主張は、システムが正確かつ予測可能にタスクを完了できるときにのみ説得力を持つ。第二は信頼だ。こうしたシステムが高性能になるほど、個人の文脈へのアクセスに依存し、その見返りが本当に価値あるものかをユーザー自身が判断しなければならなくなる。

Google はこの両面を同時に前へ進めることを選んだ。だからこそ Gemini Intelligence は、モバイル AI が完成したことを証明するからではなく、プラットフォーム企業がいまや AI を OS の中に溶け込ませ、ユーザーに代わって行動させようとしていることを示すからこそ、注目すべき Android の変化の一つなのだ。

この記事は Gizmodo の報道に基づいています。元記事を読む。

Originally published on gizmodo.com