¿Qué es GPT-5.4 Thinking?

OpenAI ha lanzado su último modelo de razonamiento fronterizo, GPT-5.4 Thinking, junto con una tarjeta del sistema detallada que documenta las capacidades del modelo, evaluaciones de seguridad y limitaciones. El lanzamiento marca otro paso en el esfuerzo de OpenAI por desarrollar sistemas de AI capaces de abordar problemas complejos y de múltiples pasos a través de cadenas de razonamiento extendidas antes de entregar respuestas finales a los usuarios.

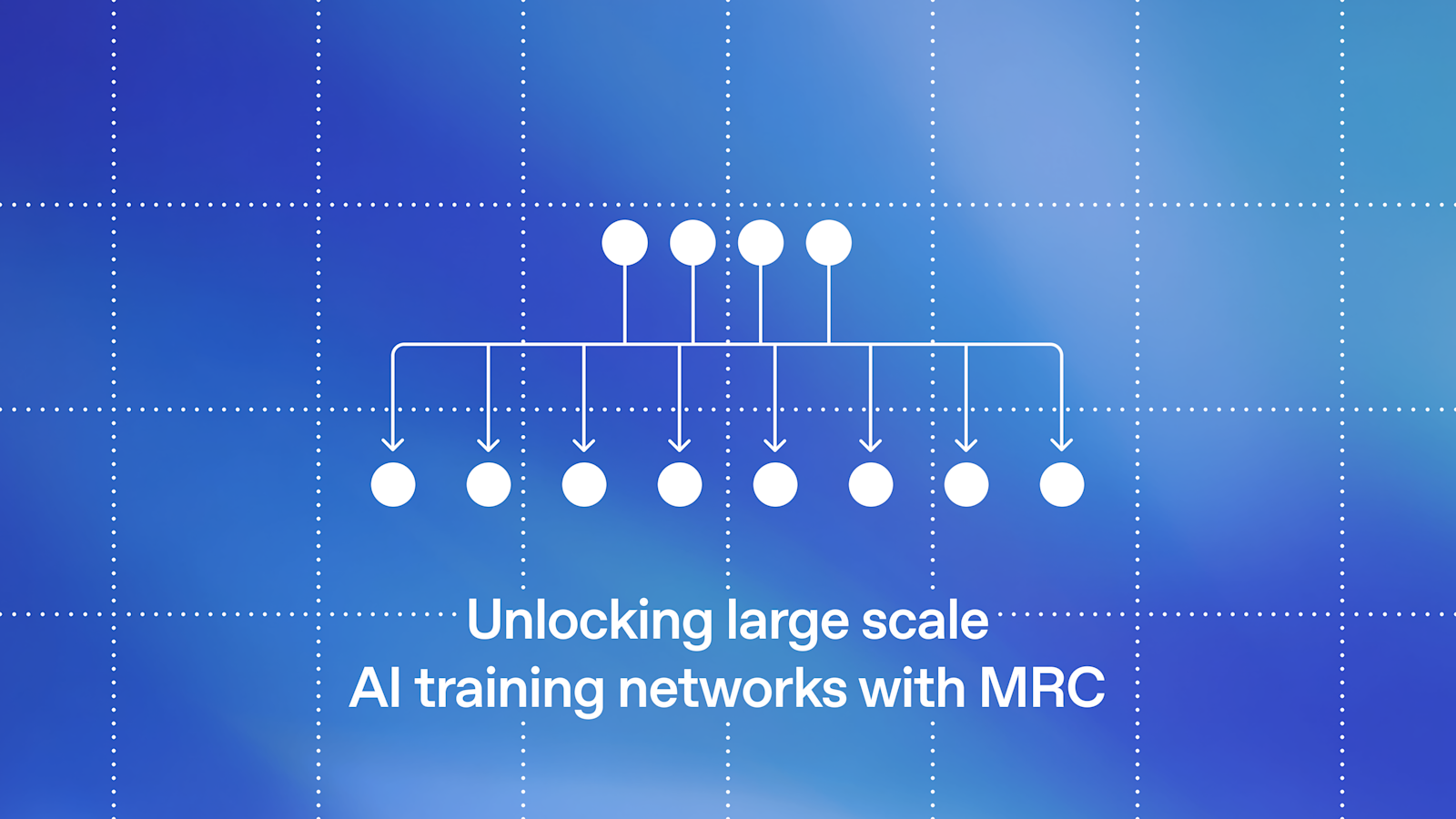

A diferencia de los modelos de lenguaje estándar que generan respuestas token-por-token sin deliberación, GPT-5.4 Thinking utiliza razonamiento de chain-of-thought — resolviendo problemas internamente antes de comprometerse con una salida. Esta arquitectura permite que el modelo maneje pruebas matemáticas, tareas de codificación complejas, razonamiento científico y análisis lógicos matizados con una precisión sustancialmente mayor que los sistemas anteriores.

La tarjeta del sistema, que OpenAI publica para todos sus modelos fronterizos, proporciona una vista transparente de cómo la empresa evalúa AI antes de la implementación. Cubre puntos de referencia de seguridad, resultados de red-team, riesgos potenciales de mal uso y mitigaciones específicas implementadas — proporcionando a investigadores y clientes empresariales la información que necesitan para evaluar casos de uso apropiados para el nuevo modelo.

Evaluaciones de Seguridad y Resultados de Red-Teaming

Las pruebas de seguridad para GPT-5.4 Thinking siguieron el Marco de Preparedness de OpenAI, evaluando el modelo en amenazas de ciberseguridad, habilitación de armas biológicas y químicas, riesgo radiológico y adquisición autónoma de recursos. La tarjeta del sistema coloca a GPT-5.4 Thinking en la categoría de riesgo general Medio, lo que significa que puede ser implementado con mitigaciones de seguridad estándar sin desencadenar restricciones adicionales.

Las evaluaciones de red-team probaron la resistencia del modelo a jailbreaks, inyección indirecta de prompts y manipulación adversarial de múltiples pasos. GPT-5.4 Thinking demostró una resistencia mejorada a muchos vectores de ataque en comparación con generaciones anteriores, aunque permanece imperfecto contra entradas adversariales altamente sofisticadas — una advertencia que se aplica a todos los sistemas AI actuales independientemente de la sofisticación del entrenamiento.

Las evaluaciones de capacidades de persuasión y manipulación encontraron que el entrenamiento de seguridad del modelo reduce sustancialmente su disposición a producir contenido diseñado para engañar o coaccionar a los usuarios. OpenAI también evaluó el comportamiento en configuraciones agentivas, donde el modelo podría tomar secuencias de acciones con consecuencias del mundo real, y encontró que el desempeño está dentro de parámetros de seguridad aceptables para el umbral de clasificación Medio.