একটি ছবি থেকে নেভিগেবল 3D জগৎ

এনভিডিয়া গবেষকরা Lyra 2.0 উন্মোচন করেছেন, এমন একটি সিস্টেম যা একক ফটোগ্রাফ থেকে বড়, সঙ্গতিপূর্ণ 3D পরিবেশ তৈরি করার জন্য নকশা করা হয়েছে। কোম্পানির দাবি, এসব দৃশ্য রিয়েল টাইমে অন্বেষণ করা যাবে এবং Isaac Sim-এর মতো সিমুলেশন প্ল্যাটফর্মে রপ্তানি করা যাবে, যেখানে এগুলো রোবট প্রশিক্ষণে ব্যবহার করা যেতে পারে।

এই দাবি উচ্চাকাঙ্ক্ষী, তবে রোবোটিক্সে আধুনিক এআই-এর একটি মূল সমস্যার সঙ্গে ভালোভাবে মিলে যায়: সিমুলেশনে এজেন্ট প্রশিক্ষণ বাস্তব দুনিয়ার তুলনায় অনেক সহজ, সস্তা, এবং নিরাপদ। কিন্তু কার্যকর সিমুলেশন এখনও এমন পরিবেশ তৈরির ওপর নির্ভর করে যা যথেষ্ট বড়, স্থিতিশীল, এবং বাস্তবসম্মত। একটি মাত্র ছবি যদি কয়েক দশ মিটার পর্যন্ত বিস্তৃত একটি সঙ্গতিপূর্ণ দৃশ্যের বীজ হতে পারে, তাহলে সিমুলেশন কনটেন্ট তৈরির খরচ উল্লেখযোগ্যভাবে কমে যেতে পারে।

প্রতিবেদন অনুযায়ী, Lyra 2.0 প্রায় 90 মিটার পর্যন্ত বিস্তৃত দৃশ্য তৈরি করতে পারে। কিন্তু কেবল আকারের চেয়ে আরও গুরুত্বপূর্ণ হলো মডেলটি আগের পদ্ধতিগুলোর দুটি সাধারণ দুর্বলতা ঠিক করতে পারে: এটি ইতিমধ্যে যা তৈরি করেছে তা ভুলে যায় না, এবং ছোটখাটো ভিজ্যুয়াল ত্রুটি জমে বড় বিকৃতিতে পরিণত হতে দেয় না।

দীর্ঘ-পথ 3D জেনারেশন কেন কঠিন

বর্তমান 3D scene generation AI সিস্টেমগুলো প্রায়ই বিকৃত হতে থাকে যখন virtual camera তার শুরুর জায়গা থেকে অনেক দূরে চলে যায়। রং সরে যায়, geometry বদলে যায়, এবং পরিবেশ তার সঙ্গতি হারায়। camera পরে আগে দেখা জায়গায় ফিরলে, model আগের ধারাবাহিকতা বজায় রাখার বদলে সেই জায়গা প্রায় নতুন করে কল্পনা করতে পারে।

রোবোটিক্সের জন্য, এসব ব্যর্থতা কেবল নান্দনিক নয়। অনুসন্ধানের সময় নিজেকে সামান্য বদলে ফেলা একটি simulation পরিবেশ embodied systems-এর প্রশিক্ষণের জন্য দুর্বল ভিত্তি, কারণ তারা স্থিতিশীল স্থানিক কাঠামোর ওপর নির্ভর করে। পৃথিবী নিজেই যদি স্থির না থাকে, তাহলে navigation, manipulation, এবং planning সবই কম নির্ভরযোগ্য হয়ে পড়ে।

এই কারণেই scene coherence novelty-এর চেয়ে গুরুত্বপূর্ণ। একটি কার্যকর প্রশিক্ষণ জগতে এতটুকু ধারাবাহিকতা থাকতে হবে, যাতে একটি agent সেটির ভেতর দিয়ে এমনভাবে চলতে পারে যেন এটি একটি স্থান, কেবল সম্ভাব্য ছবির প্রবাহ নয়।

Lyra 2.0 কীভাবে সমস্যাটি সমাধান করতে চায়

প্রতিবেদন অনুযায়ী, Lyra 2.0 প্রতিটি generated frame-এর জন্য 3D geometry সংরক্ষণ করে। virtual camera যখন আগে দেখা কোনো অঞ্চলে ফিরে আসে, সিস্টেম সেই পুরোনো frameগুলো পুনরুদ্ধার করে এবং তাদের spatial information-কে reference material হিসেবে ব্যবহার করে। image synthesis এখনও video model দ্বারা সম্পন্ন হয়, কিন্তু সংরক্ষিত geometry orientation বজায় রেখে ধারাবাহিকতা ধরে রাখতে সাহায্য করে।

এই নকশা প্রথম বড় দুর্বলতা, অর্থাৎ ভুলে যাওয়াকে, লক্ষ্য করে। আগের দেখা অঞ্চলগুলো যদি stored geometry-এর মাধ্যমে আবার মনে করা ও spatially re-ground করা যায়, তাহলে তৈরি পরিবেশ দীর্ঘ trajectory জুড়েও বেশি সঙ্গতিপূর্ণ থাকতে পারে।

দ্বিতীয় সমস্যা drift, যেখানে ছোট ছোট generation ত্রুটি ধাপে ধাপে জমতে থাকে। প্রতিবেদনে বলা হয়েছে, এনভিডিয়ার উত্তর হলো model-কে তার নিজের ত্রুটিপূর্ণ output-এর বিরুদ্ধে প্রশিক্ষণ দেওয়া, যাতে এটি degradation কেবল উত্তরাধিকারসূত্রে না নিয়ে তা শনাক্ত ও সংশোধন করতে শেখে। এটি একটি ব্যবহারিক কৌশল। generation নিখুঁত হবে ধরে নেওয়ার বদলে, training process model-কে সেই noise-এর মুখোমুখি করায় যা এটি সম্ভবত নিজেই তৈরি করবে।

Benchmark দাবি ও প্রতিযোগিতামূলক প্রেক্ষাপট

দুটি dataset-এ benchmark পরীক্ষায় GEN3C, Yume-1.5, এবং CaM-সহ ছয়টি প্রতিদ্বন্দ্বী পদ্ধতিকে Lyra 2.0 ছাড়িয়ে গেছে বলে এনভিডিয়া দাবি করছে। প্রতিবেদনে ওই মূল্যায়নের পূর্ণ বিবরণ নেই, তাই এই প্রতিযোগিতামূলক দাবিকে পূর্ণ প্রযুক্তিগত তুলনা নয়, বরং একটি সারাংশ হিসেবে পড়া উচিত। তবুও, গুরুত্ব স্পষ্ট: এনভিডিয়া Lyra 2.0-কে ল্যাবের কৌতূহল নয়, বরং long-range scene generation-এ একটি state-of-the-art প্রতিদ্বন্দ্বী হিসেবে উপস্থাপন করছে।

এটি গুরুত্বপূর্ণ, কারণ ক্ষেত্রটি খুবই ভিড়পূর্ণ। অনেক দল image-to-3D, video world models, এবং simulation-friendly generative systems নিয়ে কাজ করছে। আলাদা করে দাঁড়াতে হলে, একটি পদ্ধতিকে শুধু আকর্ষণীয় demo নয়, চলাচলের সময় স্থায়ী scene qualityও দেখাতে হবে।

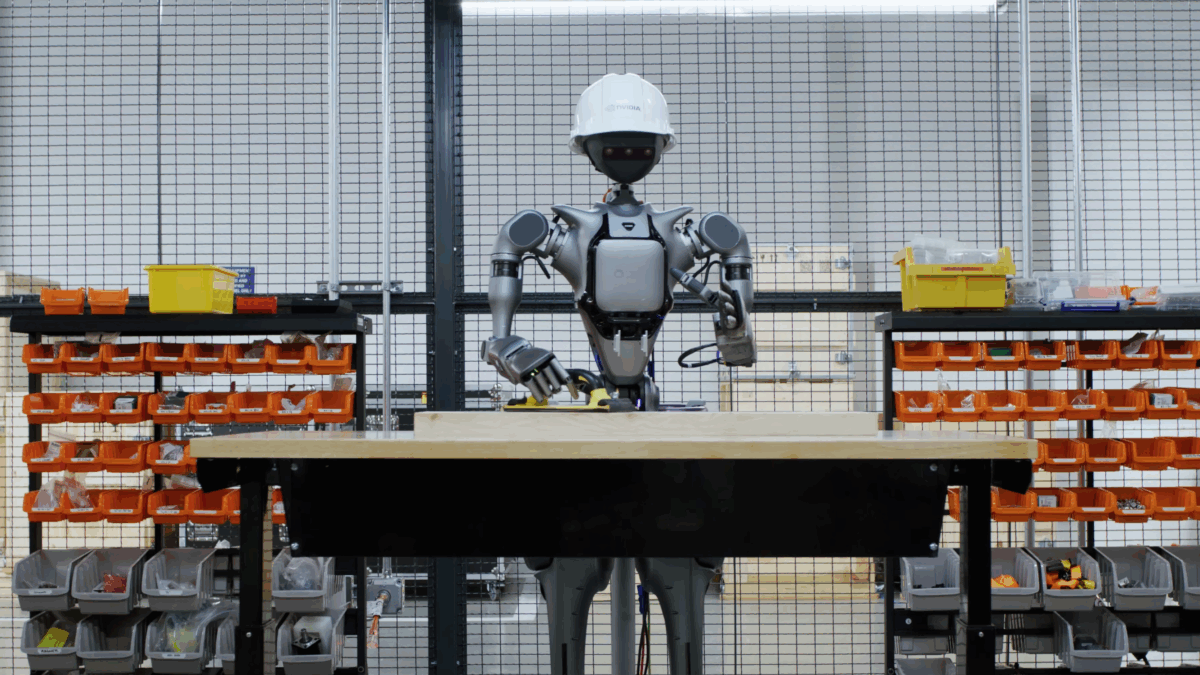

রোবোটিক্স কেন তাৎক্ষণিক ব্যবহারক্ষেত্র

Isaac Sim-এর মতো physics engine-এ সরাসরি export করার পথটি প্রতিবেদনের সবচেয়ে গুরুত্বপূর্ণ বিষয়গুলোর একটি। এটি ইঙ্গিত করে, এনভিডিয়া কেবল visualization বা virtual tours-এর জন্য content generation নিয়ে আগ্রহী নয়। লক্ষ্য embodied AI।

রোবট প্রশিক্ষণে প্রায়ই data bottleneck দেখা দেয়। বাস্তব দুনিয়া থেকে তথ্য সংগ্রহ ব্যয়বহুল, আর হাতে simulation পরিবেশ তৈরি করতে সময় লাগে। একটি সিস্টেম যা একটি ফটো থেকে plausible, অন্বেষণযোগ্য 3D স্থান তৈরি করতে পারে, তা training data দ্রুত স্কেল করতে সাহায্য করতে পারে, বিশেষ করে navigation বা interaction tasks-এ, যেখানে পরিবেশের বৈচিত্র্য গুরুত্বপূর্ণ।

ব্যবহারিকভাবে, এটি developers-কে sparse visual references দিয়ে শুরু করে দ্রুত ব্যবহারযোগ্য simulation scene-এ প্রসারিত করতে দেবে। এটি real-world validation-এর বিকল্প নয়, তবে pretraining ও testing pipeline-কে বিস্তৃত করবে।

এটি কী সমাধান করে, আর কী করে না

Lyra 2.0 একটি বাস্তব প্রযুক্তিগত বাধা সমাধান করছে, কিন্তু একে সম্পূর্ণ physical realism বলে ধরে নেওয়া উচিত নয়। সঙ্গতিপূর্ণ scene তৈরি করা এক জিনিস। এমন scene তৈরি করা, যার geometry, materials, dynamics, এবং object affordances robust transfer-এর জন্য যথেষ্ট সঠিক, আরেক জিনিস।

simulation কেবল তখনই কার্যকর, যখন সেখানে শেখা আচরণ বাস্তবতায় টিকে থাকে। চমৎকার visual coherenceও নিজে থেকে উপযোগী physics বা সঠিক object interaction নিশ্চিত করে না। এনভিডিয়ার প্রতিবেদন এটি পরোক্ষভাবে স্বীকার করে, কারণ এতে physics engine-এ export করার ওপর জোর দেওয়া হয়েছে, যা দেখায় Lyra-এর output বৃহত্তর simulation stack-এর একটি অংশ, সম্পূর্ণ সমাধান নয়।

স্কেলযোগ্য world generation-এর দিকে একটি পদক্ষেপ

তবুও, এই কাজটি গুরুত্বপূর্ণ, কারণ এটি ক্ষেত্রটিকে robot training world তৈরির আরও scalable পদ্ধতির দিকে এগিয়ে দেয়। long-path coherence, স্পষ্ট geometry recall, এবং drift-aware training-এর সমন্বয় ঠিক সেই সমস্যাগুলোকে লক্ষ্য করে, যেগুলো আগের সিস্টেমগুলিকে সীমিত করেছিল। এই সুবিধাগুলো যদি বিস্তৃত ব্যবহারে টিকে থাকে, তাহলে Lyra 2.0 রোবোটিক্স উন্নয়নের একটি লুকানো খরচ কমাতে সাহায্য করতে পারে: শেখার জন্য যথেষ্ট জগৎ তৈরি করা।

এইটাই গভীর গুরুত্ব। রোবোটিক্সের অগ্রগতি শুধু ভালো policy ও বড় model-এর কথা নয়। এটি ভালো environment-এরও কথা। একটি রোবট কেবল সেই জগতগুলো থেকেই শিখতে পারে যেগুলো সে দেখে, আর সেই জগতগুলো ভালোভাবে তৈরি করা নিজেই একটি ক্রমবর্ধমান AI সমস্যা হয়ে উঠছে।

এই নিবন্ধটি The Decoder-এর প্রতিবেদন ভিত্তিক। মূল নিবন্ধ পড়ুন.

Originally published on the-decoder.com