政府 AI 面临一组不同的问题

部署人工智能的竞赛往往默认的是私营部门的运行条件:持续的云连接、集中的基础设施、自由调动数据的广泛空间,以及对模型透明度有限的某种容忍度。根据 MIT Technology Review Insights 与 Elastic 联合发布的一份新报告,这些假设在政府环境中很快就会失效。

报告认为,公共部门组织面临一组独特的安全、治理和运营约束,这使得专门打造的小型语言模型,或 SLMs,比直接照搬标准的大模型路线更现实。重点并不是政府对 AI 不感兴趣,而是它们承受失误的空间更小、处理数据的灵活性更低,也更有理由要求对系统运行位置及其行为方式保持控制。

为什么小型模型正在获得关注

最明显的压力之一是数据安全。原文引用了一项 Capgemini 研究,发现全球 79% 的公共部门高管对 AI 的数据安全表示担忧。对于处理敏感记录、法律义务和关键任务系统的机构来说,这种担忧并不意外。在这类环境中,随意将信息跨网络传输或发送到外部服务可能根本不可行,或不可接受。

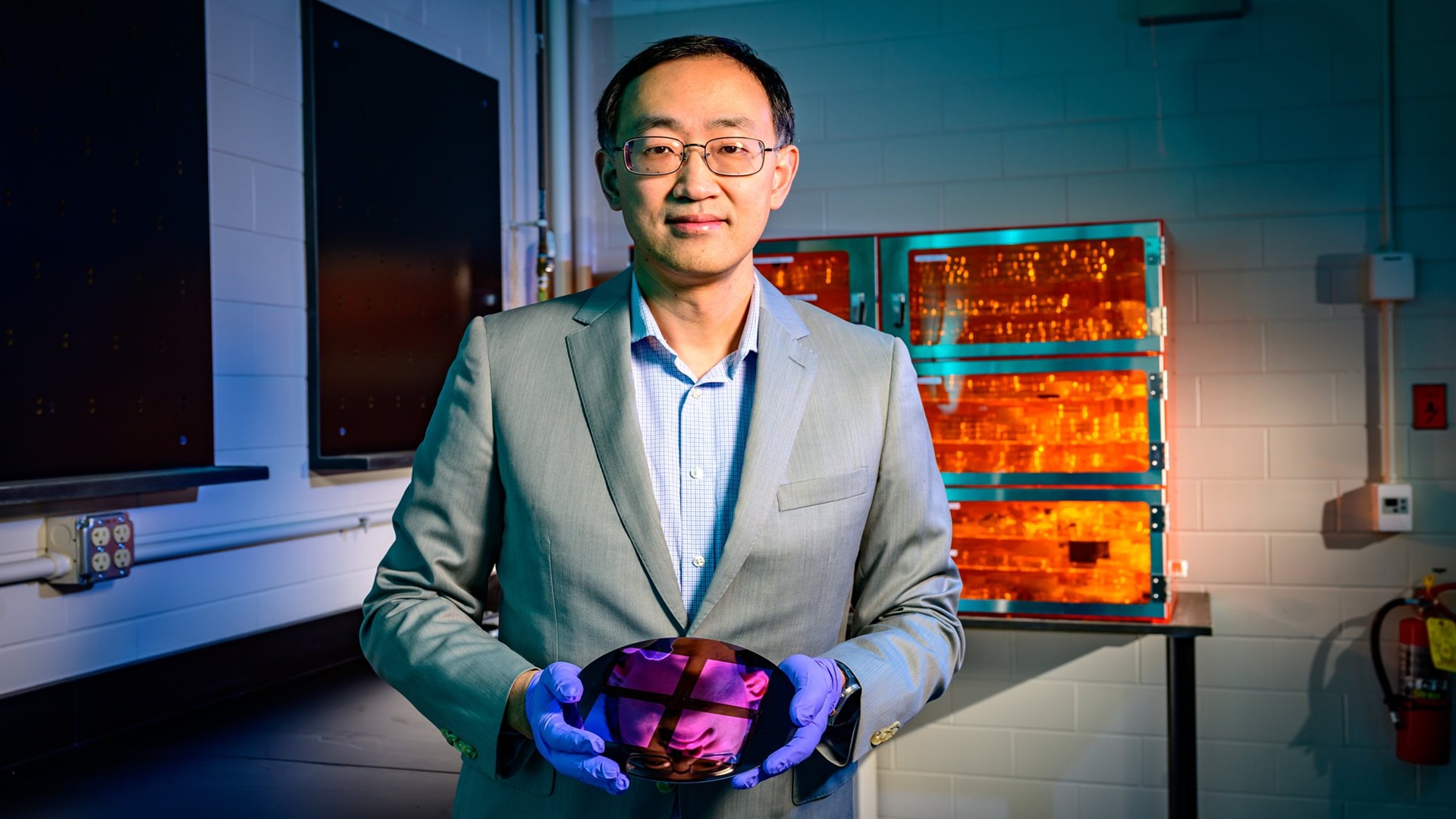

报告引用 Elastic AI 副总裁 Han Xiao 的话说,政府机构必须非常严格地限制发送到网络中的数据。这一约束改变了部署的计算方式。大型、依赖云端的系统或许功能强大,但如果它们需要机构无法接受的前提条件,就会在运营上变得难以信任。

小型语言模型之所以被视为答案,是因为它们可以受到更严格的控制、用途更聚焦,并且在受限环境中运行时可能更容易部署。吸引力不仅在于效率,更在于匹配度。一个围绕某项具体政府任务设计的小模型,可能比一个面向开放式用途的通用系统更容易治理。

运营挑战远比演示挑战更大

报告还强调了一个在 AI 讨论中常被忽略的观点:在真实机构中部署模型,与证明它在试点中有效,完全是两回事。政府机构需要的是能够在不同类型数据上可靠运行、能够在不发生运营中断的情况下扩展、并且即使在互联网连接受限、不稳定或不可用时也能继续工作的系统。

Xiao 在原文中认为,许多人低估了 AI 的运营挑战。这一观察在公共机构中尤其相关,因为业务连续性与原始能力同样重要。一个在现场条件下失效、无法验证,或依赖不可获得硬件的出色模型,并不是可行的公共部门解决方案。

基础设施约束同样重要。报告指出,政府组织可能难以获得用于训练和访问更复杂 AI 模型的 GPU。这不仅从政策层面,也从采购和算力层面,使更小、更有针对性的系统更具吸引力。

从实验走向落地

原文引用的 Elastic 调查发现,65% 的公共部门领导者难以持续、实时且大规模地使用数据。这一数据有助于解释为什么许多政府 AI 项目在试点阶段后停滞不前。问题不只是决定是否使用 AI,而是如何将其嵌入必须保持安全、可审计且具备韧性的工作流程中。

这正是 SLMs 论点变得更有说服力的地方。如果某个机构需要能够在受控环境中运行、与受限系统集成,并将数据保持在机构控制之下的模型,那么更窄化的系统可能比大型通用系统更有机会被真正落地。

这并不意味着越小就一定越好。它意味着优化目标不同。在许多政府场景中,最终胜出的系统可能是最易治理、最可靠的系统,而不是基准分数最高的系统。

关于企业 AI 的更广泛信号

这份报告对公共部门的关注,也指向了企业 AI 思维中的更大转变。对于高度监管或安全敏感的机构来说,前沿模型的讨论只是故事的一部分。另一部分是部署架构:模型运行在哪里、它可以访问哪些数据、如何验证决策,以及在理想条件消失时操作是否仍能继续。

政府机构代表了这些压力的极端案例,但并不是唯一案例。其他具有严格合规和高可用性要求的行业,很可能也会面临类似权衡。这使得公共部门成为观察更专业化 AI 技术栈这一更广泛趋势的一个有用试验场。

报告真正想说什么

核心主张与其说是规模本身,不如说是运营上的现实主义。如果公共机构被期望把 AI 从试验阶段推进到日常使用,就需要与其实际所处环境相匹配的系统。安全边界、有限连接、受限基础设施和严格治理,在政府部门里并不是边缘情况,而是基线条件。

在这样的背景下,专门打造的小型语言模型被呈现为一条务实的前进路径。它们或许不如更大系统那样引人注目,但报告的论点是,真正决定 AI 能否在公共部门变得可用的,将是实用性、可控性和连续性。

本文基于 MIT Technology Review 的报道。阅读原文。

Originally published on technologyreview.com