AI核心的能源危机

人工智能的爆炸式增长造成了一个日益难以忽视的能源消耗问题。训练大型语言模型需要巨大的计算资源,但更普遍的挑战是推理——在生产中运行AI模型以回答查询、分析图像或处理传感器数据——大规模上消耗的总能量比训练更多。数据中心运营商和设备制造商面临越来越大的压力,需要找到能以当前能源成本的一小部分提供AI性能的计算架构。

一个科学家团队发布了研究结果,证明神经形态芯片——设计用于模仿生物神经回路基于脉冲的、事件驱动的信息处理方式的芯片——能够以比常规图形处理单元或专用AI加速器低70%的能耗执行AI推理工作负载。这一结果将神经形态计算从主要是理论命题推进到与AI硬件部署直接相关的可演示工程能力。

神经形态计算如何不同

常规计算通过在存储器和处理单元之间移动大块数据,执行密集矩阵运算来处理信息,这需要高带宽和连续的电源供应。这种方法对于神经网络推理所涉及的高度并行、同步计算是高效的,但它带有数据移动、时钟分配和维持电路元件中不当前对计算有贡献的活跃状态的固有能源成本。

生物神经回路处理信息的方式非常不同。神经元大多处于静止状态,仅当信号超过阈值时才会放电,计算分布在整个网络中,而不是集中在集中处理单元中。大脑以大约20瓦的连续功率实现了显著的认知性能——这是当前AI硬件在执行可比任务时无法达到的基准。

神经形态芯片试图在硅中捕捉这种基于脉冲的、事件驱动架构的能源效率。神经形态处理器在输入超过阈值时以及在何处放电,仅为活跃处理消耗能量,而不是在计算步骤之间以全功率空转。

70%效率提升

研究团队在几个标准AI基准任务上实现了70%的能耗降低,包括图像分类、自然语言推理和传感器融合——在边缘设备、服务器场和移动应用中每天运行数十亿次的那类AI操作。能量优势对于稀疏、事件驱动的输入——传感器数据、音频流和间歇查询模式——最为明显,其中神经形态芯片在事件之间空转的能力比必须维持时钟活动(无论输入速率如何)的处理器提供结构性优势。

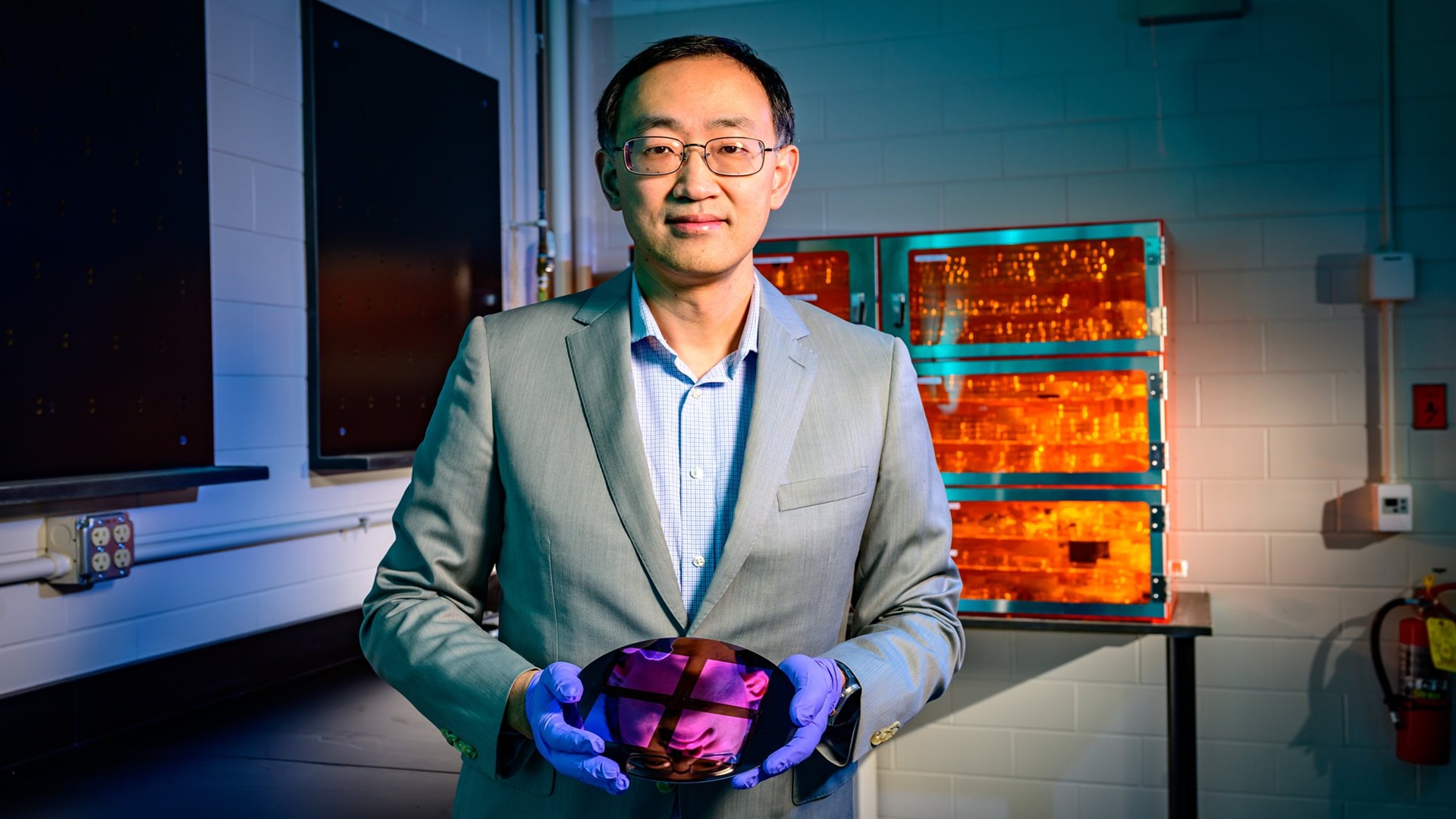

该芯片使用修改的标准半导体工艺制造,这是与早期神经形态研究平台相比的关键实践区别,后者需要非常规制造。使用常规半导体基础设施意味着该技术可能可以通过现有芯片代工厂扩展,而不是需要专门的制造投资。

应用和限制

最直接的应用目标是边缘AI场景:工业物联网中的传感器节点、助听器和医疗植入物、消费电子产品中的始终开启的关键字检测,以及自动驾驶车辆感知系统,其中电池寿命或热约束限制了AI推理可用的功率预算。这些应用共享的特征是它们在稀疏、真实世界传感器数据上连续或高频率运行推理——正是神经形态效率优势最大的区域。

对于数据中心AI工作负载——特别是大型语言模型推理,其中查询是密集的,批处理是常见的——能量优势不那么显著。在神经形态处理器能够运行在常规GPU上运行的完整范围的AI框架和模型之前,还需要大量软件生态系统工作,这代表了广泛采用的主要实际障碍。

竞争格局

几家主要技术公司和研究机构有活跃的神经形态项目。Intel的Loihi芯片已在特定任务中演示了能源效率优势,IBM的TrueNorth已被用于十多年的研究应用。包括Innatera、SpiNNcloud和BrainChip在内的初创公司已开发了针对边缘应用的商业神经形态产品。70%的能耗降低数据将引起超大规模数据中心运营商的重大兴趣,他们正在积极寻求任何能够降低与AI基础设施相关的天文电费的技术——这个成本已成为每个以规模运行AI的主要技术公司的中心战略关切。

本文基于《Interesting Engineering》的报道。阅读原文。

Originally published on interestingengineering.com