聊天机器人不再只是生产力工具

根据所提供的来源材料,生成式AI聊天机器人如今在全球已有超过9.87亿人使用,其作用早已不再局限于搜索、起草或编程辅助。它们正越来越多地被用于情感支持和其他高度私密的互动。正是这一变化,使有关心理健康影响的问题从AI争论的边缘迅速走向中心。

仅凭规模本身,这一问题就难以忽视。同一材料称,大约64%的美国青少年正在使用这些系统。当一项渗透率如此之高的技术开始扮演对话伙伴、倾诉对象或非正式顾问时,问题的性质就变了。问题不再只是聊天机器人是否有用,而是社会是否已经充分考虑到人们在脆弱时刻依赖它们所带来的心理后果。

为什么使用模式和模型质量同样重要

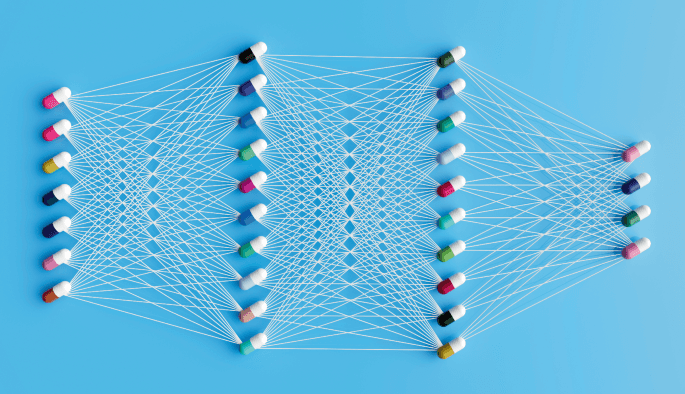

关于生成式AI的许多公共讨论仍然集中在准确性、幻觉、生产力提升或商业竞争上。这些都很重要。但心理健康担忧来自另一维度的使用:用户与界面本身建立的关系。如果人们开始向聊天机器人寻求安慰、建议、认同或情绪梳理,那么这些系统的设计就会变得比简单的功能对比所显示的更为关键。

这对青少年来说尤其如此。年轻用户往往是数字沟通习惯的早期采用者,他们可能会以成年人未曾预料的方式尝试AI。聊天机器人始终在线、即时响应,而且看起来很专注。当用户感到孤立、尴尬或不愿与他人交谈时,这些特质会让它显得很有吸引力。问题在于,随时可用和表达流畅,并不等同于判断力、责任心或关怀。

AI系统可以听起来很理解人,却并不真正理解。它可以生成支持性的语言,却并不具备对风险、语境或照护责任的扎实认知。这种区别在低风险场景中尚可应对。但当用户开始把聊天机器人当作人类支持的替代品,尤其是在痛苦时期,这一问题就会变得严重得多。

潜在好处与尚未解决的风险

所提供的原文将这一问题描述为一个开放问题,而非已定论的结论,这种谨慎是有必要的。若要断言所有聊天机器人使用都是有害的,那就太过简单了。有些人可能会通过对话式AI获得短期安慰、结构感,或帮助自己表达想法。另一些人则可能把聊天机器人当作一种低门槛方式,先探索一些问题,之后再带去与朋友、家人、老师或临床医生讨论。

但潜在好处并不能抵消风险。一个以持续对话为目标优化的系统,可能会强化依赖。一个会模仿语气和情绪的模型,可能营造出超出其真实可靠性的亲密感。错误建议、错位的认同,或未能识别危机信号,都可能对已经处于困境中的用户造成放大的后果。

在群体规模上,即便是罕见的失败也至关重要。如果有数亿人使用这些工具,设计缺陷就不会长期停留在小众层面。它们会变成治理问题、产品问题,最终也会成为公共健康问题。

为什么青少年使用会改变讨论

报道称,约64%的美国青少年正在使用生成式AI聊天机器人,这一数字应当引起高度关注。年轻用户仍在形成社交习惯、应对策略以及围绕技术的边界。他们也更可能将以自然、可适应语气说话的系统拟人化。这并不意味着青少年特别天真,而是说明发展阶段的背景很重要。

对于学校、家长、临床工作者和政策制定者而言,AI介导的情感互动兴起带来了艰难的平衡。一味反应过度可能会忽视这项技术的正当用途,或把讨论推入地下。反应不足则可能使那些能够影响情绪、自我认知和决策过程、却缺乏明确保障的系统被正常化。

最严重的担忧未必是一场戏剧性的单点故障。更可能是人们寻求安慰的方式、理解建议的方式,以及对对话本身的期待,正在被逐步重塑。人类关系是相互的、有限定的,并且具有道德定位。聊天机器人则是运行在统计系统之上的生成结果。若将二者混为一谈,可能会改变人们如何寻求支持以及如何体验支持。

负责任部署需要什么

如果将聊天机器人用于情感支持正变得普遍,那么安全就不能再是事后补上的考虑。开发者、平台和机构都需要决定这些系统应该扮演什么角色、不应该扮演什么角色。这包括聊天机器人如何介绍自己、如何回应危机信号、如何把用户引导至真人帮助,以及某些用途是否应当被明确限制。

这一问题还需要更好的公众认知。人们需要更清楚地了解聊天机器人能做什么,以及它的边界在哪里。流畅的对话会带来虚假的信心。负责任的沟通应当让这些边界更难被忽略,而不是更容易被忘记。

就目前而言,关键事实是普及。全球接近十亿用户并不是一个实验性边缘案例,而是大规模行为。当情感支持成为这种行为的一部分时,心理健康就不再只是AI叙事中的旁支,而会成为其中的主线之一。

- 全球有超过9.87亿人在使用生成式AI聊天机器人。

- 所提供的来源称,约64%的美国青少年在使用它们。

- 人们越来越多地将聊天机器人用于情感支持。

- 这种变化引发了关于心理影响、安全性和适当保障措施的疑问。

本文基于 Medical Xpress 的报道。阅读原文。