面向更大型AI集群的新网络层

OpenAI推出了Multipath Reliable Connection,简称MRC,这是一种为大规模AI训练系统设计的网络协议,在这类系统中,GPU之间的延迟可能拖慢整个任务。该公司表示,它与AMD、Broadcom、Intel、Microsoft和NVIDIA共同开发了这一协议,随后又通过Open Compute Project发布了该规范,以便其他运营方也能采用。

此举针对的是前沿模型开发中一个不那么显眼的瓶颈。训练过程依赖于在加速器之间传输海量数据,而一次传输延迟就可能让昂贵的硬件空转等待。OpenAI认为,随着集群规模扩大,拥塞、链路故障和路由问题会频繁到足以使网络设计本身成为决定训练速度和可靠性的核心因素。

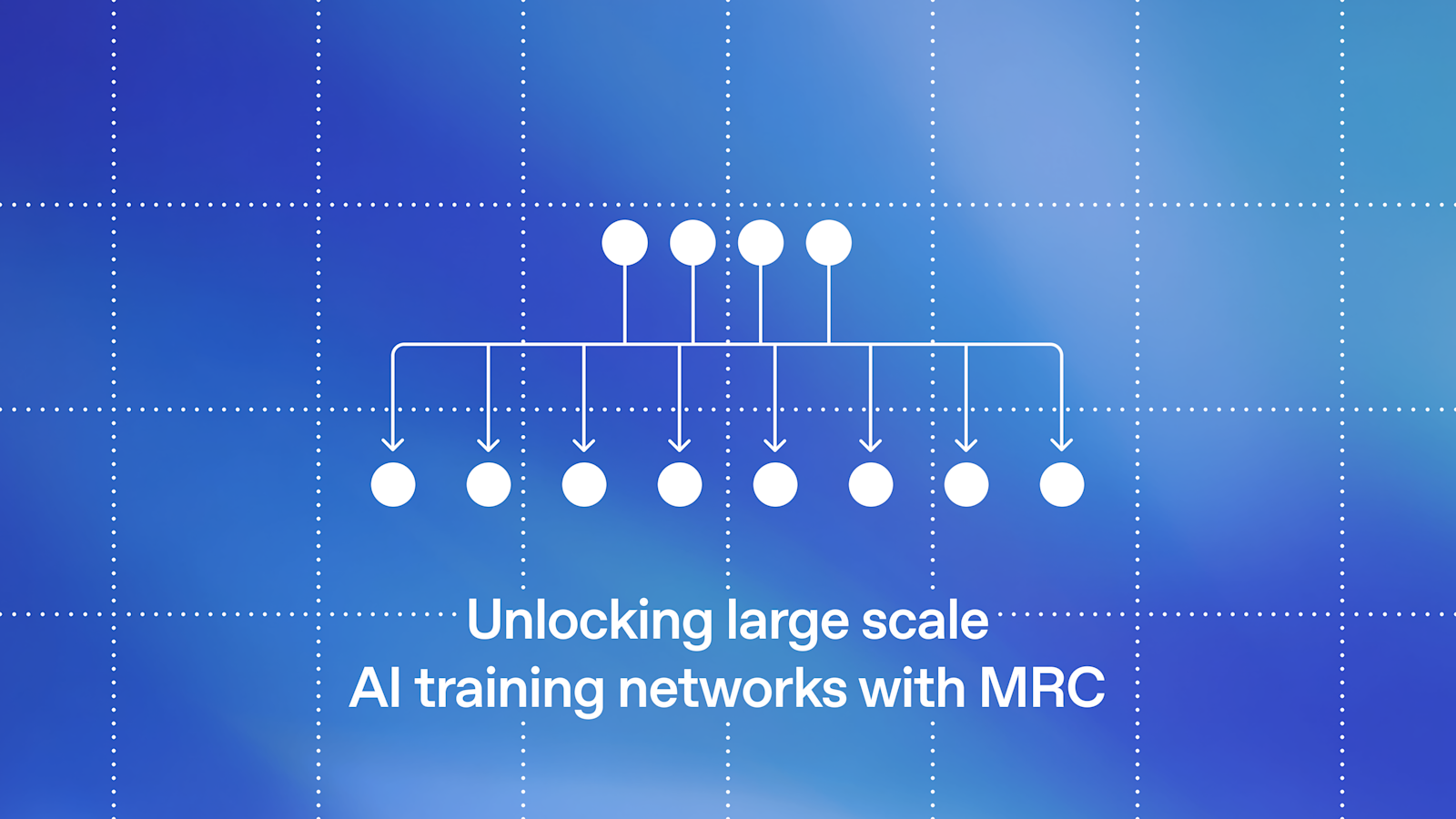

MRC要解决什么问题

在对该系统的说明中,OpenAI表示,该协议围绕三个思路构建:用于冗余的多平面高速网络、用于降低核心拥塞的自适应分组喷洒,以及用于规避故障的静态源路由。公司将这些选择描述为一种在提升韧性的同时减少复杂性的方式。

根本问题在于规模。现代训练步骤可能需要在整个超级计算机互连中进行数百万次数据传输。如果网络路径发生拥塞或某个设备故障,这种中断就会向外扩散,并让跨多个GPU的同步工作停滞。OpenAI表示,MRC旨在通过更有效地分配流量,并允许在不依赖更脆弱路由行为的情况下绕过故障,来防止这些问题扩散。

三个核心设计选择

- 多平面网络旨在提供冗余,同时比某些替代方案使用更少的组件和更少的电力。

- 自适应分组喷洒将流量分散到不同路径上,以减少网络核心中的热点。

- 静态源路由用于部署中绕过故障,并彻底避免某些类别的路由故障。

为什么这不只关乎一家公司

OpenAI将此次发布与其更广泛的算力战略以及Stargate规模基础设施的需求联系起来。该公司表示,在关键基础设施层采用共享标准,有助于AI系统在更广泛的合作伙伴生态中更高效地扩展。通过OCP发布该规范,也表明AI集群的网络设计正开始被视为一个共同的行业问题,而不是私有实现细节。

这很重要,因为模型训练的经济性不仅取决于芯片和电力,还取决于运营方能多有效地让集群保持繁忙。一个能够降低抖动并让故障更容易绕开的协议,可能提升大规模部署的利用率,进而影响新模型训练的速度,以及达到既定目标所需建设多少基础设施。

合作伙伴名单也凸显了这一问题已变得多么广泛。随着半导体供应商、云基础设施运营商和系统构建商都参与其中,此次发布表明,AI网络正在成为自身重要的竞争层。OpenAI选择开放规范而非纯粹专有方案,意味着其押注于互操作性和生态采用,如今比把这一层堆栈保持封闭更有价值。