可信度危机:为什么AI行业的警告正在失去影响力

一篇在社交媒体平台广泛流传的文章重新引发了人们对人工智能变革潜力的讨论。企业家Matt Shumer的帖子'Something Big Is Happening'获得了数千万次浏览,作者在当前AI发展与COVID-19疫情的早期警告信号之间作出类比。核心主张是:科技行业正在经历一个关键时刻,需要立即获得公众关注和理解。

然而,在这个最新警报的表面下,隐藏着一个更令人不安的模式。人工智能行业已经发展出一个可以被称为持续可信度问题的现象,其中关于存在威胁和迫在眉睫的破坏的重复警告变得如此普遍,以至于对观察者来说,区分真实关切与宣传信息变得越来越困难。

不断升级的预测模式

行业领导者和研究人员以显著的规律性对AI的发展轨迹做出了令人担忧的声明。从知名的AI安全倡导者到大型科技公司的高管,关于变革性变化、劳动力流离失所和前所未有的技术能力的警告已成为标准话题。每个新预测都以类似的紧迫性到来,并对即将发生的变化的程度提出了类似的声明。

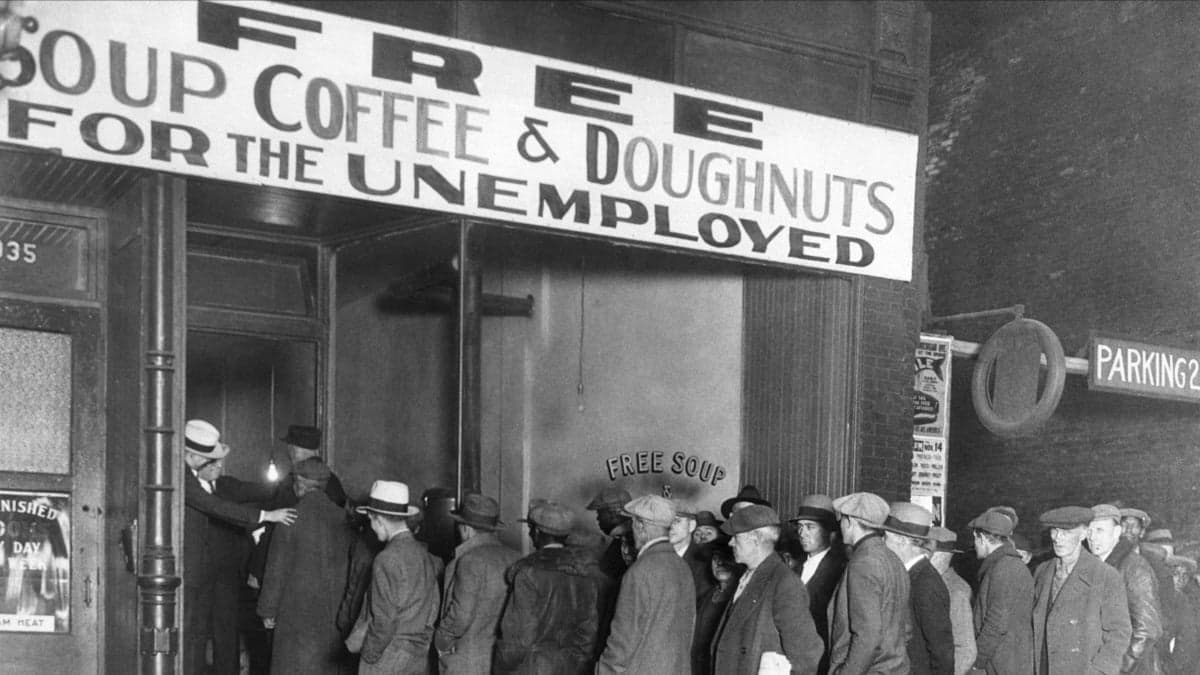

这些重复警告的累积效应带来了一个挑战:当多个可信的声音持续预测即将发生的破坏而没有相应的现实世界验证时,公众信任自然会消退。'狼来了'的动态开始起作用,其中警告的数量之多反讽地削弱了它们的说服力。

理解商业激励结构

批判性分析需要承认正在起作用的潜在经济激励。当企业家和公司领导者强调他们技术的革命性质时,他们同时推进了自己的商业利益。将人工智能描绘为可与农业革命或大流行级别破坏相媲美的改变世界的力量,有多个目的:它证明了大量资本投资的合理性,吸引了顶级人才,并将早期行动者定位为不可避免的变革中的关键参与者。

真正的技术进步与商业优势之间的这种一致性造成了内在的矛盾。即使关于AI开发的关切在科学上是有根据的,智力上是诚实的,它们也不可避免地带有战略营销的痕迹。区分真实警告和复杂的销售叙述成为了中心解释挑战。

能力问题:区分事实与夸大其词

Shumer的文章围绕关于当前AI能力的具体声明展开。论证基于可证实的例子:生成式AI模型据称能够以专家水平进行法律分析,更重要的是,能够在没有人类干预的情况下进行自主代码生成和改进。这些声明值得仔细审查。

大型语言模型的最近进步确实在专业领域取得了令人印象深刻的成果。编码辅助工具确实对初级程序员的就业模式产生了影响。当代AI系统处理复杂信息和生成上下文适当响应的能力已大幅扩展。这些发展代表了真正的技术进步。

然而,已证实的能力与病毒式传播文章中描述的变革性场景之间仍存在显著差距。当前系统在定义的参数范围内运行,需要大量的人类监督,在面对新情况时表现出脆弱性。从'在特定领域内留下深刻印象'到'从根本上重塑文明'的跨越仍然很大,在研究人员中也存在争议。

AGI和奇点框架

Shumer的论证隐含地依赖于人工通用智能和技术奇点等概念——假设的状态,其中AI系统在所有领域达到人类水平的推理,或进入指数能力增长的自我改进反馈循环。这些概念仍然是理论性的。虽然研究人员在AGI出现的时间表和概率进行辩论,但其实际实现仍然是推测性的。

围绕这些根本问题的不确定性值得承认。来自学术机构和科技公司的认真研究人员对AGI是否代表迫在眉睫的发展或遥远的前景真诚地存在分歧。当行业声音将推测性未来呈现为不可避免的结果时,这种合理的科学不确定性常常被掩盖。

评估真实与表面关切

对Shumer文章的病毒式传播回应表明了人们对AI相关警告的渴望,这跨越了意识形态和人口统计学的边界。来自政治谱各方的知名人士放大了这一信息,表明对技术破坏的真正关切超越了传统分歧。

然而,与此同时,出现了怀疑的声音,质疑预测的具体性和支持即将发生变革声明的潜在证据。这种两分的回应反映了更广泛的公众不确定性:存在合理的理由来仔细监测AI发展,但同样合理的理由来质疑当前警告是否反映了衡量的评估或战略沟通。

前进的道路:平衡评估

承认AI的真实能力和潜在影响不必要求接受每一个警告的表面价值。强大的技术治理、周密的劳动力市场规划和严肃的AI安全研究代表了谨慎的方法,无论变革性变化是在明年还是在更长的时间线上到来。

科技行业可以通过区分推测性可能性和已证实的能力、明确承认不确定性以及认识到商业利益如何塑造信息来加强其可信度。当参与者清楚地将当前系统确实能做的事情与它们在理想条件下理论上可能完成的事情分开时,公共话题受益。

人工智能几乎肯定会产生重大的社会变化。这些变化是逐步出现还是突然出现,它们是集中收益还是广泛分布,以及社会如何有效地适应破坏仍然是开放的问题。这些值得认真关注——这正是当来自关于即将发生变革的重复、无差别的警告引起警报疲劳时,变得更难集中的那种注意力。

本文基于Mashable的报道。阅读原始文章。