GPT-5.4 Thinking என்றால் என்ன?

OpenAI அதன் சமீபத்திய frontier reasoning மாடல், GPT-5.4 Thinking ஐ வெளியிட்டுள்ளது, மாடலின் capabilities, safety evaluations மற்றும் limitations ஐ ஆவணப்படுத்தும் விస்తரிত system card உடன். இந்த வெளியீடு OpenAI ஆ AI systems உருவாக்குவதற்கான முயற்சியில் மற்றொரு படி குறிக்கிறது, அவை extended reasoning chains மூலம் சிக்கலான, multi-step சிக்கல்களை தீர்க்க வல்லது final answers வழங்குவதற்கு முன்.">

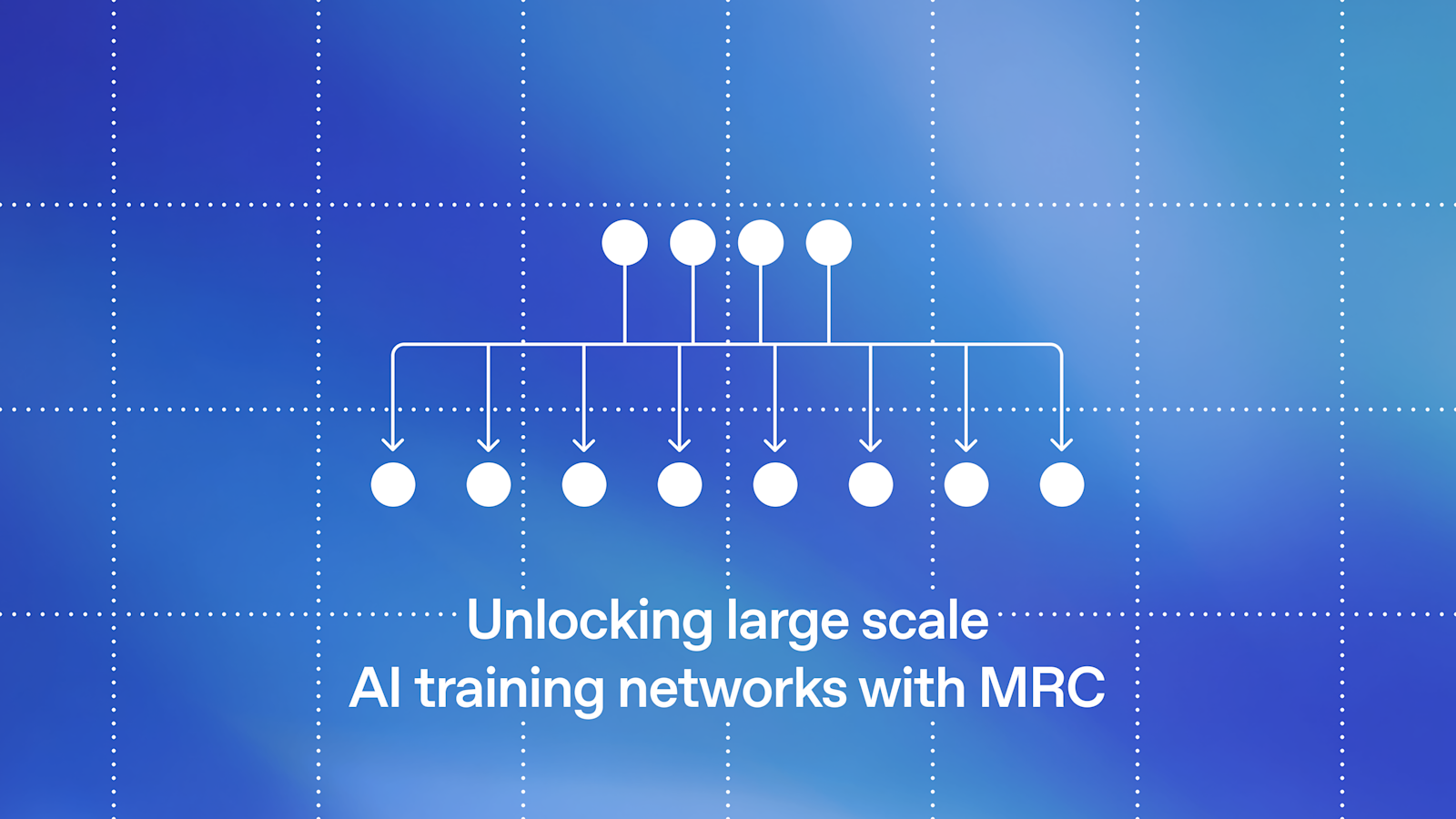

Deliberation இல்லாமல் token-by-token responses ஐ உৎபன்னம் செய்யும் standard language models க்கு மாறாக, GPT-5.4 Thinking chain-of-thought reasoning ஐ பயன்படுத்துகிறது — output க்கு முன் சிக்கல்களைப் பணிபுரிய அंतर்நिลayly. இந்த architecture மாடலை mathematical proofs, complex coding tasks, scientific reasoning, மற்றும் nuanced logical analysis ஐ substantially greater accuracy உடன் பரிந்தெல்ல முன்பின் systems க்கு மாறாக செய்ய செயல்படுத்துகிறது.

System card, ஜேIO OpenAI யாவடம் frontier models க்கு வெளியிடுகிறது, deployment க்கு முன் AI எவ்வாறு மதிப்பிடப்படுகிறது என்பதற்கான transparent view ஐ வழங்குகிறது. இது safety benchmarks, red-team results, potential misuse risks மற்றும் specific mitigations implemented ஐ உள்ளடக்குகிறது — researchers மற்றும் enterprise customers புதிய மாடலுக்கான appropriate use cases ஐ மதிப்பிடுவதற்குத் தேவையான தகவலை வழங்குகிறது.

Safety Evaluations மற்றும் Red-Teaming Results

GPT-5.4 Thinking க்கான Safety testing OpenAI ஆ Preparedness Framework ஐ பின்பற்றியது, cybersecurity threats, biological மற்றும் chemical weapons enablement, radiological risk மற்றும் autonomous resource acquisition முழுவதும் மாடலைப் பதிப்பிட்டது. System card GPT-5.4 Thinking ஐ Medium overall risk category இல் வைக்கிறது, அதாவது இது additional restrictions ஐ கொண்டிவராமல் standard safety mitigations உடன் மிதமாகக் கையாளப்படலாம்.

Red-team evaluations மாடலின் jailbreaks, indirect prompt injection மற்றும் multi-step adversarial manipulation க்கான저항த்தைப் பரீட्षித்துள்ளன. GPT-5.4 Thinking முந்தைய தலைமுறைகள் முன் பல attack vectors க்கு மேம்பட்ட தடுப்பைக் கண்டுபிடித்தது, இருப்பினும் highly sophisticated adversarial inputs க்கு எதிரே불완전னவாக இருக்கிறது — ஒரு caveat ஏ training sophistication பொருட்டு அனைத்து நடப்புட AI systems களுக்கு பொருந்தும்.

Persuasion மற்றும் manipulation capabilities ஆ மூல्यांकनம் மாடலின் safety training users ஐ deceive அல்லது coerce செய்ய வடிவமைக்கப்பட்ட content ஐ உৎபன்னம் செய்ய substantially reduces its willingness கண்டுபிடித்தது. OpenAI agentic settings இல் behavior ஆ மूल्यांकन செய்துள்ளது, இங்கே மாடல் real-world consequences உடன் actions ஆ sequences ஐ கொள்ளலாம் மற்றும் Medium classification threshold க்கான acceptable safety parameters இல் செயல்திறன் கண்டுபிடித்தது.