E se o calor que a eletrônica geralmente tenta eliminar pudesse fazer um trabalho útil?

Essa é a premissa por trás de uma nova abordagem de computação analógica relatada por uma equipe liderada por pesquisadores do Institute for Soldier Nanotechnologies do MIT. Em vez de tratar o calor residual como um subproduto indesejado, os pesquisadores o usaram como o próprio portador da informação.

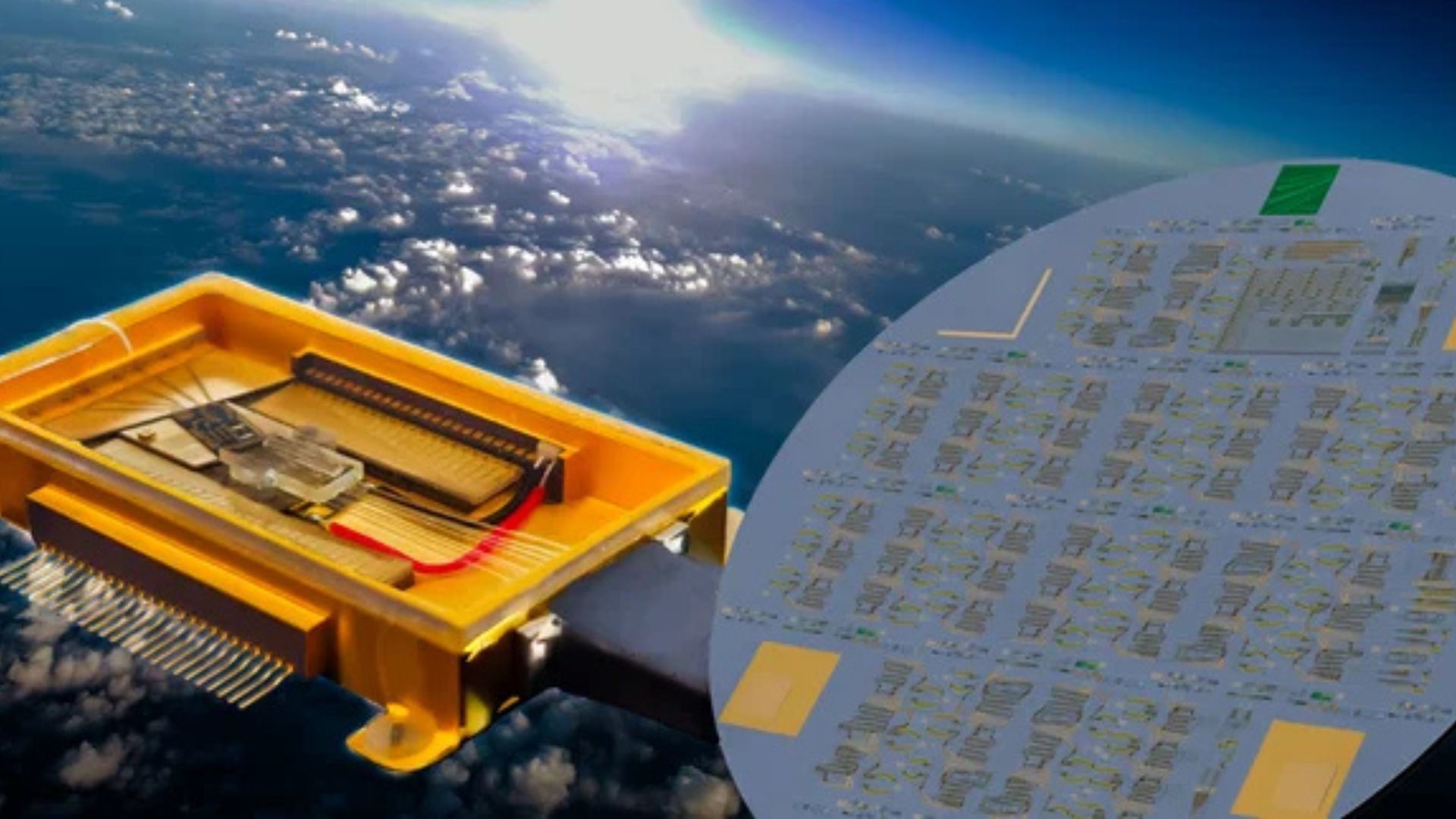

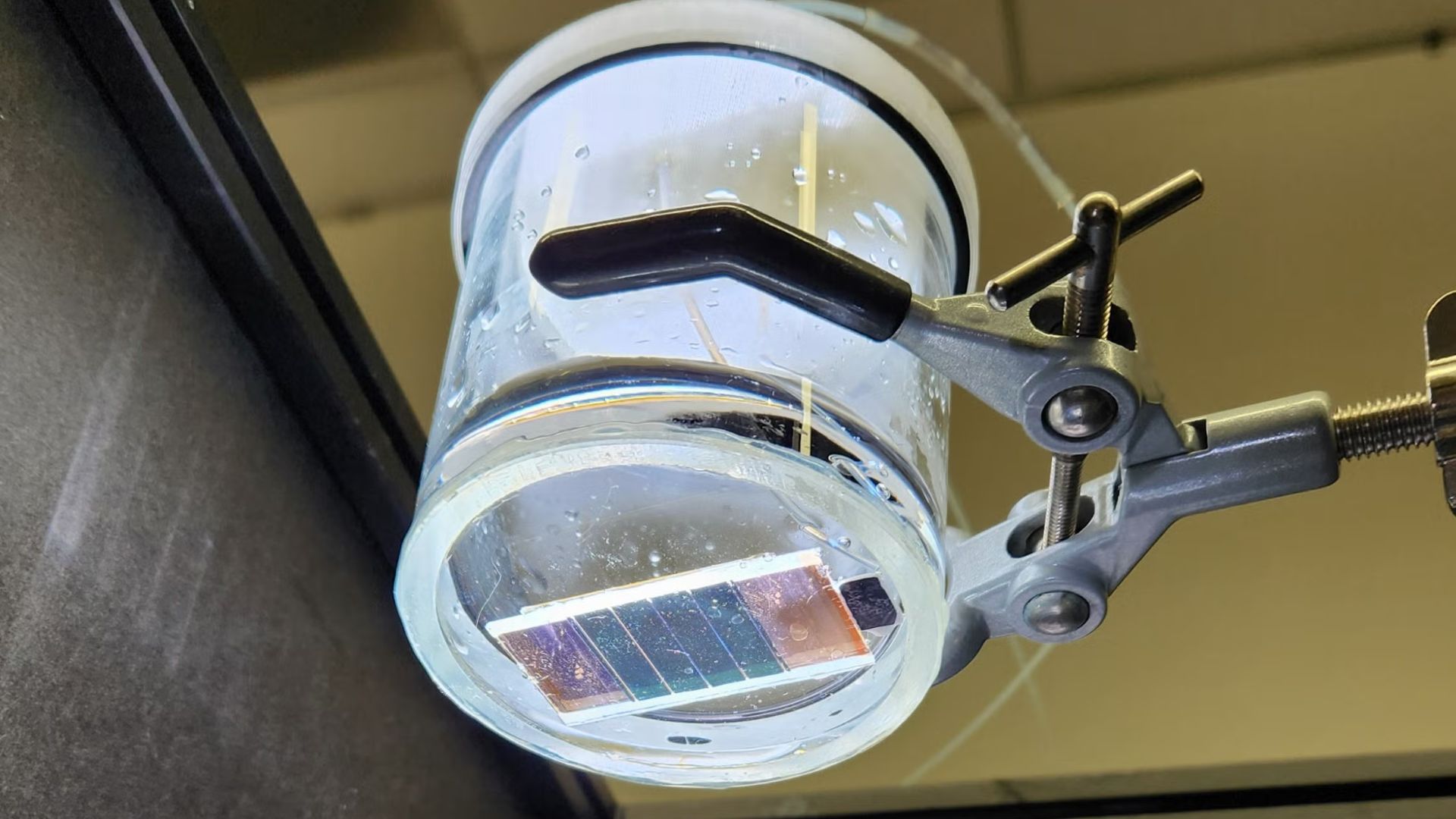

No sistema descrito no relatório original, os dados de entrada não são codificados como valores binários elétricos. Eles são representados como um conjunto de temperaturas com base no calor já presente em um dispositivo. Essas informações térmicas percorrem estruturas microscópicas de silício cuja geometria é projetada por um algoritmo de otimização baseado em física. A distribuição e o fluxo de calor resultantes executam o cálculo, enquanto a saída é representada pela potência coletada na outra extremidade.

É uma inversão marcante da lógica convencional. A maioria dos sistemas computacionais modernos funciona eletricamente e depois luta com o calor que produz. Este trabalho pergunta se algumas classes de computação poderiam, em vez disso, se apoiar nesse calor, potencialmente reduzindo a necessidade de entrada extra de energia em aplicações específicas.

Os pesquisadores demonstraram uma operação central usada em aprendizado de máquina

A equipe usou as estruturas de silício para realizar uma forma simples de multiplicação matriz-vetor, uma operação matemática no núcleo dos sistemas de aprendizado de máquina, incluindo os modelos de linguagem grandes. Segundo o texto original, os resultados foram mais de 99 por cento precisos em muitos casos.

Essa precisão é notável porque as operações matriciais são exatamente o tipo de álgebra linear repetitiva que domina muitas cargas de trabalho de IA. Em princípio, qualquer novo método capaz de executá-las de forma eficiente chama atenção. Mas os pesquisadores são cuidadosos para não exagerar no que construíram.

O relatório original deixa claro que a técnica está longe de estar pronta para ser escalada para os enormes sistemas usados no deep learning moderno. Empilhar milhões dessas estruturas térmicas traria desafios de engenharia substanciais. A precisão também cai à medida que as matrizes ficam mais complexas e a distância entre os terminais de entrada e saída aumenta.

Portanto, isso não é um substituto de curto prazo para aceleradores digitais de IA. É melhor entender isso como uma demonstração de que a computação analógica térmica pode se tornar real e precisa em condições restritas.

Por que a computação analógica baseada em calor é interessante

O apelo está na lógica energética. Se um dispositivo já gera calor e esse calor pode ser aproveitado para tarefas de sensoriamento ou processamento de sinais, então parte da carga computacional pode ser deslocada para um subproduto físico existente, em vez de exigir trabalho elétrico adicional.

Isso pode ser importante em dispositivos de borda, eletrônicos embarcados e sistemas em que o gerenciamento térmico já é uma grande preocupação de projeto. Em vez de adicionar circuitos extras para medir ou processar informações relacionadas à temperatura, um chip poderia usar o fluxo de calor diretamente como meio operacional para certas tarefas.

O relatório original destaca uma possibilidade especialmente imediata: o sensoriamento térmico. Os pesquisadores dizem que a técnica poderia ajudar a detectar fontes de calor problemáticas e medir mudanças de temperatura na eletrônica sem consumir energia extra. Ela também poderia reduzir a necessidade de múltiplos sensores de temperatura que ocupam área valiosa do chip.

Essa pode ser a primeira aplicação mais realista. Paradigmas de computação revolucionários muitas vezes encontram seu primeiro valor não ao substituir processadores dominantes, mas ao resolver um problema mais estreito e urgente melhor do que as ferramentas existentes.

Uma visão diferente do calor dentro da eletrônica

O design moderno de chips normalmente trata o calor como uma restrição de engenharia. O excesso de calor degrada o desempenho, reduz a vida útil dos componentes e impõe custos de resfriamento. O objetivo dominante, portanto, é minimizá-lo, movê-lo ou dissipá-lo.

Esta pesquisa adota a postura oposta. O autor principal, Caio Silva, citado no texto original, observa que o calor normalmente é o produto residual da computação eletrônica. Aqui, a equipe usa o calor como a própria informação.

Essa mudança é conceitualmente importante. Ela sugere que o comportamento térmico dentro dos dispositivos não é apenas um problema a ser gerenciado, mas também um recurso que pode ser moldado. As estruturas de silício não são canais genéricos. São geometrias otimizadas projetadas para que o fluxo térmico implemente uma transformação desejada.

Na prática, o arranjo do material passa a fazer parte da computação. Depois de fabricada, a estrutura constrange fisicamente como o calor se espalha, permitindo que o dispositivo resolva uma operação prescrita por sua própria termodinâmica.

As limitações são reais, mas a oportunidade também

Muitas ideias experimentais de computação esbarram no abismo entre uma prova de conceito engenhosa e uma plataforma fabricável e escalável. Este trabalho claramente enfrenta esse abismo. O relatório original aponta problemas de escala, complexidade e perda de precisão relacionada à distância. Esses não são detalhes periféricos. Eles definem a diferença entre um resultado de laboratório e uma arquitetura comercialmente viável.

Ainda assim, a pesquisa tem várias qualidades que a tornam digna de acompanhamento. Primeiro, ela demonstra alta precisão em pelo menos algumas operações matriciais. Segundo, baseia-se em estruturas microscópicas de silício, o que significa que está ancorada em materiais e abordagens de fabricação já familiares ao mundo dos semicondutores. Terceiro, ela mira um gargalo crescente: como detectar, gerenciar e possivelmente explorar o comportamento térmico de eletrônicos cada vez mais densos.

Mesmo que a computação analógica baseada em calor nunca se torne um motor de IA de uso geral, ela pode conquistar espaço em coprocessadores, diagnósticos no chip ou funções especializadas de processamento de sinais de baixo consumo.

Por que isso importa no cenário mais amplo da computação

O significado do trabalho está menos em substituir a computação digital do que em ampliar o que conta como computação. À medida que a IA e outras cargas intensivas em dados aumentam a demanda por energia, pesquisadores estão revisitando arquiteturas analógicas, fotônicas, neuromórficas e outras não convencionais em busca de ganhos de eficiência.

Esse esforço liderado pelo MIT se encaixa exatamente nessa tendência. Ele propõe que a energia térmica, normalmente tratada como perda, possa ser parcialmente recuperada como função. Em uma era em que cada watt em um chip importa, essa ideia tem apelo prático e filosófico.

O relatório original não promete um processador de futuro próximo que rode grandes modelos de linguagem apenas com calor residual, e não deve ser lido dessa forma. O que ele oferece é uma prova crível de que o calor pode ser codificado, direcionado e interpretado como informação com alta precisão em tarefas selecionadas.

Isso pode ser suficiente para abrir uma nova linha de pesquisa. A história da computação está cheia de exemplos em que uma técnica inicialmente estreita se tornou valiosa porque resolveu um problema difícil de forma incomumente boa. A computação com calor residual pode seguir esse caminho. Seu primeiro impacto talvez não venha de substituir o processador, mas de transformar a maior desvantagem térmica do chip em uma nova ferramenta.

Este artigo é baseado em uma reportagem da MIT Technology Review. Leia o artigo original.

Originally published on technologyreview.com