O Android está se tornando uma plataforma de IA mais ativa

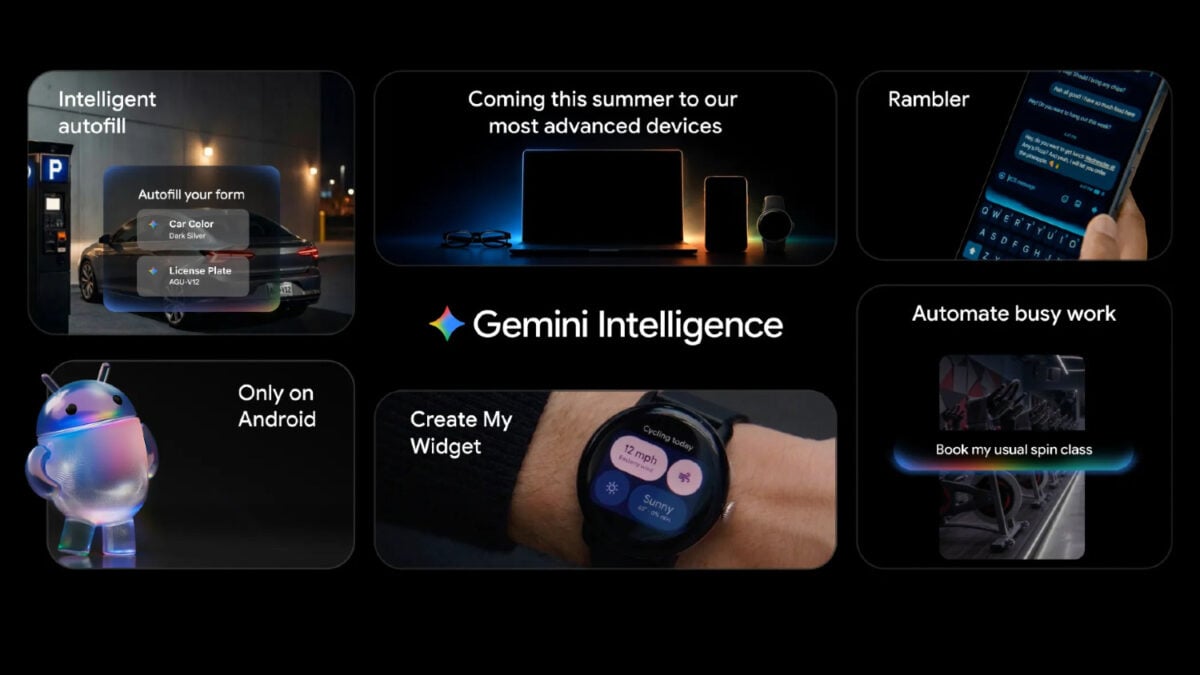

O Google está preparando uma expansão mais ampla do Gemini no Android, indo além de um chatbot independente e se aprofundando no próprio sistema operacional. Antes de sua conferência para desenvolvedores Google I/O, a empresa anunciou o Gemini Intelligence, uma suíte de recursos com IA projetada para trazer o Gemini de forma mais direta ao uso móvel do dia a dia.

A proposta do Google é explícita: o objetivo não é apenas responder a comandos, mas ajudar os usuários a realizar tarefas de forma proativa entre aplicativos e serviços. A empresa diz que o Gemini Intelligence levará o que chama de melhor do Gemini aos seus dispositivos mais avançados por meio de uma combinação de hardware e software premium.

Essa linguagem importa porque aponta para uma tendência familiar na IA de consumo. A competição está mudando de quem tem um chatbot para quem consegue incorporar IA a ações rotineiras. O Android, na visão do Google, está se tornando um campo de testes para essa mudança.

De assistente a operador

O conjunto de recursos mais relevante é a automação de tarefas. O Google descreveu o Gemini Intelligence como capaz de lidar com atividades que atravessam vários aplicativos, um passo em direção ao modelo agêntico que muitas grandes empresas de plataforma vêm sinalizando há meses.

Os exemplos escolhidos pelo Google são práticos em vez de chamativos. O sistema poderia ajudar usuários a conseguir uma bicicleta na primeira fila de uma aula de spinning, encontrar um plano de curso dentro do Gmail e depois colocar os livros necessários em um carrinho de compras. Também pode tirar uma foto de uma lista de compras e preencher um carrinho da Instacart com os itens correspondentes.

Esses exemplos sugerem que o Google está apostando que a conveniência, e não a conversa, será o argumento mais convincente para a IA em telefones. Se o recurso funcionar de maneira confiável, ele reduz o número de toques e trocas de app necessários para passar da intenção à ação. Se funcionar de forma inconsistente, corre o risco de transformar tarefas comuns em falhas opacas de automação.

O ponto estratégico fica claro de qualquer forma. O Google quer que o Gemini atue dentro do software, e não apenas fale sobre ele.

Rambler e a próxima fase da entrada por voz

Outro recurso destacado é o Rambler, uma ferramenta de fala para texto projetada para levar em conta padrões naturais da fala, incluindo muletas verbais e repetições. Em vez de exigir que os usuários ditem de forma limpa, o Google diz que o Rambler consegue identificar as partes importantes do que foi dito e moldá-las em uma mensagem concisa.

Pode parecer incremental, mas isso aborda uma fraqueza real das interfaces de voz. Muitas pessoas não falam em frases organizadas e prontas para pontuação. Elas se corrigem em tempo real, repetem expressões e divagam antes de chegar ao ponto. Um sistema capaz de sintetizar com clareza esse tipo de fala pode tornar a entrada por voz mais útil em contextos de mensagens e anotações.

O Google também afirma que o Rambler pode alternar entre diferentes idiomas dentro da mesma mensagem. Esse recurso reflete como a comunicação multilíngue funciona na prática, especialmente em regiões onde a alternância de código é algo comum, e não excepcional.

A empresa também acrescentou um sinal de privacidade, dizendo que o Rambler indica claramente quando está ativado e que o áudio é usado apenas para transcrição em tempo real, sem ser armazenado ou salvo.

Dados pessoais, controles de opt-in e alcance do navegador

O Google também está expandindo o preenchimento automático com IA por meio do Gemini Intelligence. O sistema pode preencher formulários e campos de texto em nome do usuário com base no Personal Intelligence, uma camada de opt-in que dá ao Gemini acesso a informações como histórico do YouTube e registros de pesquisa do Google.

Isso provavelmente se tornará uma das partes mais contestadas do lançamento. Por um lado, o preenchimento automático se torna mais útil quando conhece o contexto do usuário. Por outro, essa mesma profundidade contextual levanta preocupações previsíveis sobre quanto um assistente pessoal deve saber e com que conforto os usuários entregarão esses dados. A resposta do Google é enfatizar que o recurso é estritamente opcional.

O Gemini também está avançando mais profundamente no Chrome para Android. O Google diz que o assistente poderá resumir e comparar conteúdos na web, de forma semelhante às experiências de desktop, e ganhará acesso a uma capacidade de navegação automática que pode automatizar tarefas baseadas no navegador, como marcar uma consulta.

Isso estende a mesma lógica operacional dos apps para a web: a IA está sendo posicionada como uma camada de ação entre os usuários e interfaces que foram originalmente construídas para navegação manual.

Uma implementação em fases com implicações mais amplas

O Google diz que os novos recursos chegarão em ondas, começando pelos mais recentes telefones Samsung Galaxy e Google Pixel. A empresa também informou que alguns recursos relacionados ao Chrome são esperados para junho.

O lançamento em fases reforça uma realidade importante no mercado atual de IA. Mesmo quando as empresas descrevem avanços de software em termos universais, muitas vezes os lançam primeiro como recursos para dispositivos premium. Isso pode ajudar a controlar expectativas de desempenho e demandas de hardware, mas também significa que a próxima fase da IA em smartphones pode estar disponível inicialmente para um grupo mais restrito de usuários.

Ainda assim, o anúncio marca uma mudança clara de direção. O Gemini não está mais sendo apresentado principalmente como um assistente opcional ao lado do Android. Ele está sendo incorporado aos comportamentos centrais do celular: digitar, navegar, comprar, agendar e coordenar ações entre aplicativos.

Se os usuários vão abraçar isso depende de duas questões ainda em aberto. A primeira é a confiabilidade. Alegações agênticas só são convincentes quando o sistema consegue concluir tarefas com precisão e de forma previsível. A segunda é a confiança. Quanto mais capazes esses sistemas se tornam, mais dependem de acesso ao contexto pessoal, e mais os usuários precisam decidir se a troca vale a pena.

O Google escolheu avançar nas duas frentes ao mesmo tempo. Isso torna o Gemini Intelligence uma das mudanças mais importantes no Android para acompanhar, não porque prove que a IA móvel está pronta, mas porque mostra o quão agressivamente as empresas de plataforma agora querem que a IA desapareça dentro do sistema operacional e comece a agir em nome do usuário.

Este artigo é baseado na cobertura do Gizmodo. Leia o artigo original.

Originally published on gizmodo.com