Adobe fait passer l’IA de la génération à l’orchestration

La dernière initiative d’Adobe en matière d’IA consiste moins à créer un énième générateur d’images qu’à transformer sa suite de logiciels créatifs en un système de production piloté par des instructions. L’entreprise affirme que son nouvel assistant Firefly AI fonctionnera dans Photoshop, Premiere, Lightroom, Illustrator et d’autres applications, permettant aux utilisateurs de décrire un résultat et de laisser le logiciel exécuter la série d’étapes nécessaires pour y parvenir.

Cette approche est importante, car Adobe vise un goulot d’étranglement différent de celui de la plupart des outils d’IA générative autonomes. Le problème n’est pas seulement de produire des éléments bruts. Il s’agit aussi de naviguer dans des logiciels professionnels complexes pour réaliser des retouches, des changements de format et des transitions de flux de travail qui exigent normalement de l’expérience avec plusieurs menus, outils et types de fichiers. Adobe soutient que les utilisateurs devraient pouvoir partir du résultat souhaité plutôt que de la procédure nécessaire pour l’obtenir.

Dans la vision d’Adobe, la complexité elle-même est devenue un obstacle. Des applications comme Photoshop sont puissantes précisément parce qu’elles offrent de nombreux chemins et contrôles, mais cette profondeur peut intimider les utilisateurs moins expérimentés ou simplement faire perdre du temps aux professionnels soumis à des délais serrés. Une couche qui traduit l’intention en action permet à Adobe de rendre ces outils plus accessibles sans renoncer à leurs capacités existantes.

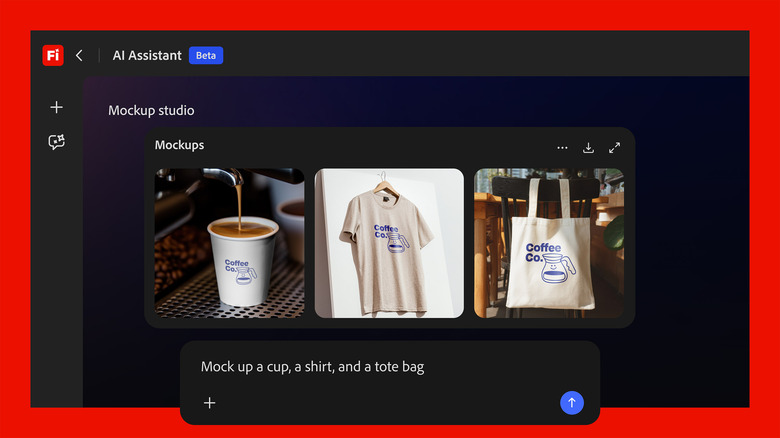

Ce que Firefly AI Assistant est censé faire

Selon le matériau source, Firefly AI Assistant fonctionne un peu comme un système d’IA conversationnelle, mais avec les applications créatives d’Adobe en arrière-plan. L’utilisateur fournit une invite décrivant le résultat souhaité, et l’assistant peut exécuter ce qu’Adobe appelle des flux de travail complexes en plusieurs étapes dans son écosystème d’applications.

Adobe indique que l’utilisateur reste impliqué pendant le processus, au lieu de confier entièrement la tâche à l’outil. Le langage de l’entreprise souligne que les créateurs peuvent intervenir à tout moment pour guider la direction, ajuster les résultats et préserver leur auteurialité. C’est une distinction importante pour Adobe, dont le modèle repose sur des utilisateurs professionnels qui ne veulent pas sacrifier la précision, la possibilité de modification ni le contrôle au nom de la rapidité.

L’entreprise affirme également que l’assistant conserve les formats de fichiers natifs d’Adobe, rendant le travail final toujours modifiable. Cela peut sembler technique, mais c’est un véritable point de concurrence. L’une des faiblesses de nombreux outils créatifs centrés sur l’IA est qu’ils produisent des résultats utiles tout en perturbant le fichier de travail sous-jacent. Adobe cherche à positionner Firefly non comme un remplacement des logiciels créatifs, mais comme une interface plus rapide vers les outils que les créateurs utilisent déjà.

Creative Skills et décisions sensibles au contexte

Adobe introduit aussi ce qu’elle appelle Creative Skills, qui transforment des flux de travail en plusieurs étapes en actions pilotables par invite. Dans l’exemple cité par la source, un utilisateur pourrait commencer avec une compétence « social media assets », puis demander au système de recadrer des éléments ou d’utiliser Generative Extend pour adapter les formats à des plateformes comme Instagram ou Facebook.

Cela montre le type de travail qu’Adobe estime que l’IA peut absorber efficacement : non pas l’ensemble du processus créatif, mais les parties répétitives ou techniquement fastidieuses situées entre une idée et un livrable. Redimensionner, étendre, reformater et coordonner des éléments entre plusieurs canaux sont précisément les tâches qui consomment du temps sans nécessairement ajouter de valeur créative.

La source décrit aussi des décisions sensibles au contexte au sein d’un projet. Dans un exemple, Adobe imagine une photo de produit placée dans une forêt, où l’assistant pourrait proposer un simple contrôle pour augmenter ou réduire le feuillage environnant. L’enjeu n’est pas seulement la génération. Il s’agit de traduire une direction visuelle de haut niveau en éléments d’interface utilisables dans un flux de travail professionnel.

Pourquoi Adobe agit maintenant

Le calendrier d’Adobe reflète une pression plus large sur les éditeurs de logiciels établis. Les outils d’IA générative ont permis aux utilisateurs d’obtenir rapidement des résultats sans apprendre les suites créatives traditionnelles, ce qui soulève la question de savoir si le « logiciel » lui-même est en train d’être réduit à des interfaces de type conversationnel. La réponse d’Adobe consiste à soutenir que son avantage réside dans la profondeur, la précision et l’interopérabilité de ses outils professionnels.

Firefly AI Assistant est donc à la fois une fonctionnalité produit et une stratégie défensive. Il doit rendre les logiciels d’Adobe plus faciles à utiliser tout en renforçant la valeur des applications sous-jacentes. Plutôt que de concéder que l’IA conversationnelle se placera au-dessus de modèles génériques et fera paraître les outils créatifs hérités lourds, Adobe veut proposer son propre assistant, fondé sur son propre écosystème.

L’entreprise affirme également que l’assistant apprendra le style d’un utilisateur au fil du temps. Si cette promesse se concrétise, Adobe pourrait renforcer les coûts de changement en rendant le logiciel à la fois plus personnalisé et plus performant. Pour les professionnels et les équipes dotés de flux de travail établis, cela pourrait être plus convaincant que des nouveautés ponctuelles en matière d’IA.

Les flux d’équipe comptent aussi

L’annonce ne se limite pas à la création en solo. Adobe affirme que l’assistant peut aider à organiser et à partager le travail entre membres d’une équipe via Frame.io, en reliant création, relecture et collaboration. C’est important, car le travail créatif en entreprise échoue souvent non pas dans la génération des ressources, mais dans les transferts, les validations et le contrôle des versions.

Si Adobe parvient à utiliser l’IA pour réduire ces frictions, son avantage dépassera la simple parité fonctionnelle avec les concurrents de génération d’images. Il commencera à englober l’ensemble de l’environnement de production, de l’idéation à la retouche, puis à la relecture et à la livraison. C’est un espace plus défendable que le marché autonome du prompt vers l’image.

Et ensuite ?

Adobe indique que Firefly AI Assistant arrivera en bêta publique dans les prochaines semaines. Cela laisse ouvertes les questions les plus importantes : fiabilité de l’orchestration inter-applications, transparence du système sur les modifications qu’il effectue et capacité à gérer les cas limites professionnels. Ce sont ces détails qui détermineront si l’outil devient une véritable couche de productivité ou seulement une démonstration d’intention.

Reste que l’annonce est significative, car elle capture la direction que prend l’IA créative. La prochaine compétition ne portera pas seulement sur la génération de contenus. Elle concernera la coordination des actions logicielles, la compression des flux de travail et la possibilité d’amener plus vite un utilisateur de l’idée au livrable final, sans l’obliger à renoncer à la modifiabilité ni au contrôle. Le nouvel assistant d’Adobe est une première tentative pour définir cette couche selon ses propres termes.

Cet article est basé sur un reportage d’Engadget. Lire l’article original.

Originally published on engadget.com