D’une image à un monde 3D navigable

Des chercheurs de Nvidia ont présenté Lyra 2.0, un système conçu pour générer de vastes environnements 3D cohérents à partir d’une seule photographie. L’entreprise indique que les scènes obtenues peuvent être explorées en temps réel et exportées vers des plateformes de simulation comme Isaac Sim, où elles peuvent servir à entraîner des robots.

L’ambition est élevée, mais elle répond très bien à un problème central de l’IA moderne pour la robotique : entraîner des agents en simulation est bien plus simple, moins coûteux et plus sûr que de les entraîner exclusivement dans le monde physique, mais une simulation utile dépend toujours de la création d’environnements assez vastes, stables et réalistes pour compter vraiment. Si une seule image peut amorcer une scène cohérente qui s’étend sur des dizaines de mètres, cela pourrait réduire de manière concrète le coût de production de contenu de simulation.

Selon le rapport, Lyra 2.0 peut générer des scènes d’environ 90 mètres. Plus important que la taille brute, toutefois, est l’affirmation selon laquelle le modèle corrige deux faiblesses courantes des méthodes précédentes : l’oubli de ce qu’il a déjà généré et l’accumulation de petits défauts visuels qui finissent par provoquer de plus grandes distorsions.

Pourquoi la génération 3D sur longue distance est difficile

Les systèmes d’IA existants pour la génération de scènes 3D se dégradent souvent à mesure que la caméra virtuelle s’éloigne de son point de départ. Les couleurs dérivent, la géométrie change et l’environnement perd en cohérence. Si la caméra revient ensuite vers une zone déjà observée, le modèle peut pratiquement réinventer cet endroit au lieu de conserver la continuité avec la vue précédente.

Pour la robotique, ces échecs ne sont pas seulement esthétiques. Un environnement de simulation qui se remodèle subtilement pendant l’exploration constitue une base fragile pour entraîner des systèmes incarnés qui dépendent d’une structure spatiale stable. La navigation, la manipulation et la planification deviennent moins fiables si le monde lui-même n’est pas persistant.

C’est pourquoi la cohérence de la scène compte davantage que la nouveauté. Un monde d’entraînement exploitable doit offrir suffisamment de continuité pour qu’un agent puisse s’y déplacer comme dans un lieu, et non comme dans un simple flux d’images plausibles.

Comment Lyra 2.0 tente de résoudre le problème

Le rapport indique que Lyra 2.0 stocke la géométrie 3D de chaque image générée. Lorsque la caméra virtuelle revient vers une zone déjà visitée, le système récupère ces images précédentes et utilise leurs informations spatiales comme référence. La synthèse d’images reste assurée par le modèle vidéo, mais la géométrie stockée doit préserver l’orientation et aider à maintenir la continuité.

Cette conception cible la première grande faiblesse des systèmes antérieurs : l’oubli. Si les régions déjà vues peuvent être rappelées et réancrées grâce à la géométrie stockée, l’environnement généré a plus de chances de rester cohérent sur des trajectoires plus longues.

Le second problème est la dérive, lorsque de petites erreurs de génération s’accumulent étape après étape. La réponse de Nvidia, selon le rapport, consiste à entraîner le modèle sur ses propres sorties imparfaites afin qu’il apprenne à reconnaître et corriger la dégradation plutôt que de simplement l’hériter. C’est une stratégie pragmatique. Plutôt que de prétendre que la génération sera propre, l’entraînement expose le modèle au bruit qu’il est susceptible de créer.

Résultats de benchmark et positionnement concurrentiel

Nvidia affirme que Lyra 2.0 a surpassé six approches concurrentes, dont GEN3C, Yume-1.5 et CaM, lors de tests de benchmark sur deux jeux de données. Le rapport ne fournit pas l’ensemble des détails de ces évaluations, il faut donc lire cette affirmation comme un résumé et non comme une comparaison technique exhaustive. Même ainsi, l’enjeu est clair : Nvidia présente Lyra 2.0 non comme une curiosité de laboratoire, mais comme un prétendant de premier plan dans la génération de scènes à longue portée.

Ce cadrage importe, car le domaine est très encombré. De nombreux groupes travaillent sur l’image vers 3D, les modèles du monde en vidéo et les systèmes génératifs adaptés à la simulation. Pour se distinguer, une méthode doit montrer non seulement des démonstrations attrayantes, mais aussi une qualité de scène persistante en mouvement.

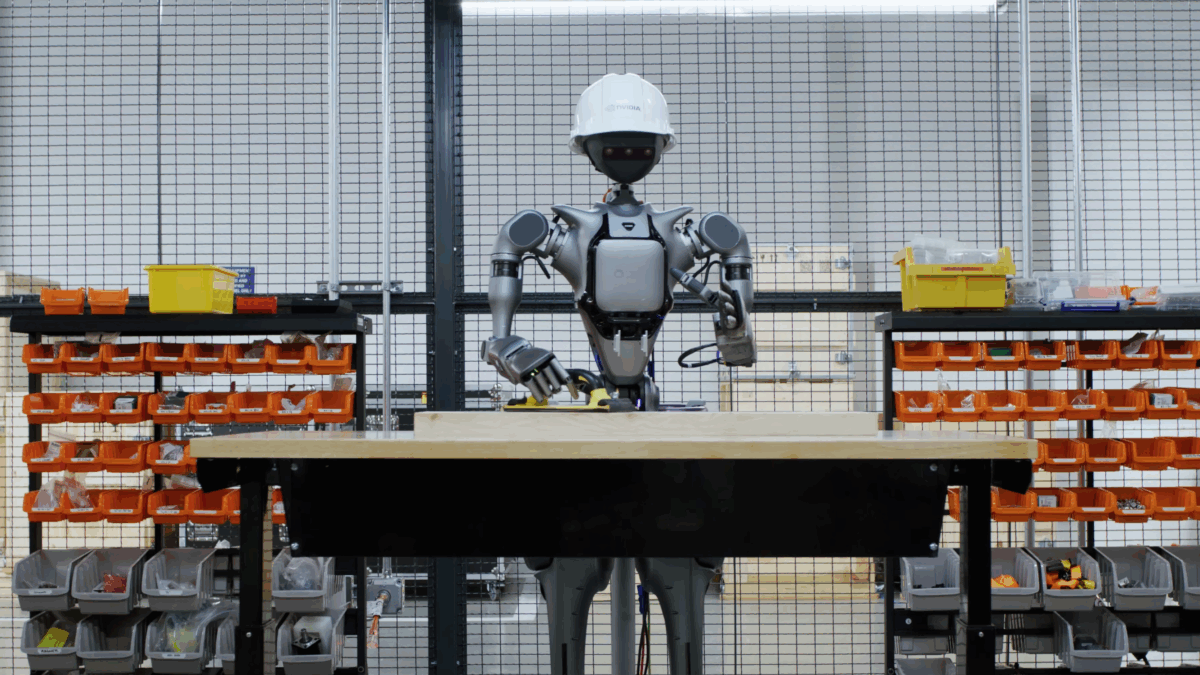

Pourquoi la robotique est le cas d’usage immédiat

Le chemin d’export direct vers des moteurs physiques comme Isaac Sim est l’un des détails les plus importants du rapport. Il suggère que Nvidia ne s’intéresse pas seulement à la génération de contenu pour la visualisation ou les visites virtuelles. La cible est l’IA incarnée.

L’entraînement des robots souffre souvent d’un goulot d’étranglement en matière de données. La collecte dans le monde réel est coûteuse, et construire des environnements simulés à la main prend du temps. Un système capable de générer des espaces 3D plausibles et explorables à partir d’une seule photo pourrait aider à faire évoluer les données d’entraînement plus rapidement, en particulier pour les tâches de navigation ou d’interaction où la diversité de l’environnement compte.

En pratique, cela pourrait permettre aux développeurs de partir de quelques références visuelles et de les étendre rapidement en scènes de simulation exploitables. Le résultat ne remplacerait pas la validation dans le monde réel, mais il pourrait élargir le pipeline de pré-entraînement et de test.

Ce que cela résout, et ce que cela ne résout pas

Lyra 2.0 s’attaque à un obstacle technique réel, mais il ne faut pas le confondre avec un réalisme physique complet. Générer une scène cohérente est une chose. Générer une scène dont la géométrie, les matériaux, la dynamique et les affordances des objets sont assez exacts pour un transfert robuste vers de vrais robots en est une autre.

Cette distinction compte, car la simulation n’est utile que dans la mesure où les comportements appris y survivent au contact de la réalité. Même une excellente cohérence visuelle ne garantit pas automatiquement une physique utile ni une interaction correcte avec les objets. Le rapport de Nvidia le reconnaît indirectement en mettant l’accent sur l’export vers des moteurs physiques, ce qui suggère que la sortie de Lyra fait partie d’une pile de simulation plus large plutôt qu’une solution complète à elle seule.

Un pas vers une génération de mondes à grande échelle

Le travail reste notable, car il rapproche le secteur d’une manière plus évolutive de construire des mondes d’entraînement pour les robots. La combinaison de la cohérence sur longue trajectoire, de la récupération explicite de géométrie et d’un entraînement sensible à la dérive cible précisément les problèmes qui ont limité les systèmes précédents. Si ces gains se confirment dans des usages plus larges, Lyra 2.0 pourrait aider à réduire l’un des coûts cachés du développement robotique : construire suffisamment de mondes pour que les robots puissent apprendre.

C’est là le sens le plus profond. Le progrès en robotique ne dépend pas seulement de meilleures politiques et de modèles plus grands. Il dépend aussi de meilleurs environnements. Un robot ne peut apprendre qu’à partir des mondes qu’il voit, et bien générer ces mondes devient à part entière un problème d’IA de plus en plus important.

Cet article s’appuie sur un reportage de The Decoder. Lire l’article original.

Originally published on the-decoder.com