Android se está convirtiendo en una plataforma de IA más activa

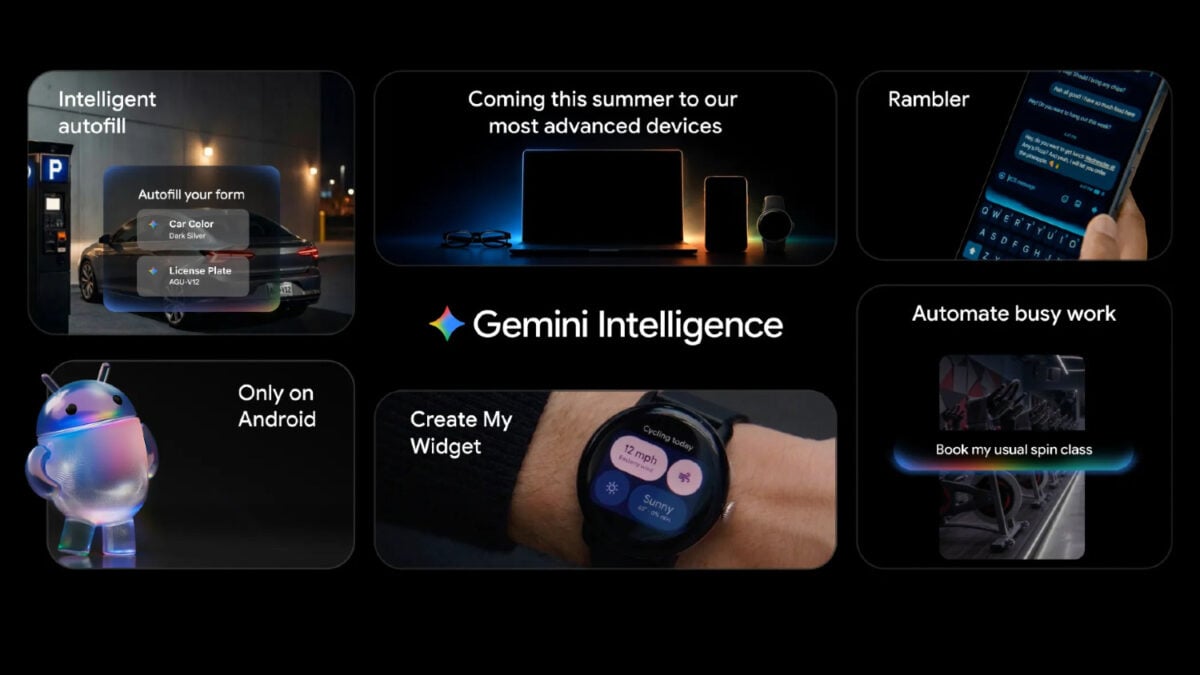

Google se prepara para una expansión mayor de Gemini en Android, alejándose de un chatbot independiente y llevándolo más dentro del propio sistema operativo. Antes de su conferencia para desarrolladores Google I/O, la compañía anunció Gemini Intelligence, una suite de funciones impulsadas por IA diseñadas para integrar Gemini de forma más directa en el uso móvil diario.

El enfoque de Google es explícito: el objetivo no es solo responder a instrucciones, sino ayudar a los usuarios a hacer cosas de manera proactiva en aplicaciones y servicios. La empresa afirma que Gemini Intelligence llevará lo que llama lo mejor de Gemini a sus dispositivos más avanzados mediante una combinación de hardware y software premium.

Ese lenguaje importa porque señala una tendencia conocida en la IA de consumo. La competencia se está desplazando de quién tiene un chatbot a quién puede integrar la IA en las acciones rutinarias. Android, según Google, se está convirtiendo en un terreno de prueba para ese cambio.

De asistente a operador

La funcionalidad más relevante es la automatización de tareas. Google describió Gemini Intelligence como capaz de gestionar actividades que abarcan varias aplicaciones, un paso hacia el modelo agéntico que muchas grandes empresas de plataformas vienen insinuando desde hace meses.

Los ejemplos que eligió Google son prácticos más que llamativos. El sistema podría ayudar a los usuarios a conseguir una bicicleta en primera fila para una clase de spinning, encontrar un programa de estudios dentro de Gmail y luego añadir los libros necesarios a un carrito de compras. También puede tomar una imagen de una lista de compras y llenar un carrito de Instacart con los artículos correspondientes.

Esos ejemplos sugieren que Google apuesta a que la comodidad, y no la conversación, será el argumento de consumo más convincente para la IA en los teléfonos. Si la función funciona de forma fiable, reduce el número de toques y cambios de aplicación necesarios para pasar de la intención a la acción. Si funciona de manera inconsistente, corre el riesgo de convertir recados ordinarios en fallos opacos de automatización.

El punto estratégico queda claro en cualquier caso. Google quiere que Gemini actúe dentro del software, no solo que hable sobre él.

Rambler y la siguiente fase de la entrada por voz

Otra función destacada es Rambler, una herramienta de voz a texto diseñada para tener en cuenta los patrones naturales del habla, incluidas las muletillas y las repeticiones. En lugar de exigir que los usuarios dicten de manera impecable, Google dice que Rambler puede identificar las partes importantes de lo dicho y convertirlas en un mensaje conciso.

Puede sonar incremental, pero aborda una debilidad real de las interfaces de voz. Muchas personas no hablan en frases limpias y listas para la puntuación. Se corrigen en tiempo real, repiten expresiones y divagan antes de llegar al punto. Un sistema capaz de destilar con claridad ese tipo de discurso podría hacer más útil la entrada por voz en contextos de mensajería y toma de notas.

Google también afirma que Rambler puede cambiar entre distintos idiomas dentro del mismo mensaje. Esa función refleja cómo funciona en la práctica la comunicación multilingüe, especialmente en regiones donde el cambio de código es algo habitual y no excepcional.

La compañía añadió además una señal de privacidad, al decir que Rambler indica claramente cuándo está activado y que el audio se usa solo para transcripción en tiempo real y no se almacena ni se guarda.

Datos personales, controles de opt-in y alcance del navegador

Google también está ampliando el autocompletado impulsado por IA mediante Gemini Intelligence. El sistema puede completar formularios y campos de texto en nombre del usuario a partir de Personal Intelligence, una capa de opt-in que da a Gemini acceso a información como el historial de YouTube y los registros de búsqueda de Google.

Es probable que esta sea una de las partes más discutidas del despliegue. Por un lado, el autocompletado resulta más útil cuando conoce el contexto del usuario. Por otro, esa misma profundidad contextual plantea preocupaciones previsibles sobre cuánto debería saber un asistente personal y con qué comodidad los usuarios entregarán esos datos. La respuesta de Google es insistir en que la función es estrictamente opt-in.

Gemini también avanza más en Chrome para Android. Google afirma que el asistente podrá resumir y comparar contenido en la web, de forma similar a las experiencias de escritorio, y que obtendrá acceso a una capacidad de navegación automática que puede automatizar tareas basadas en el navegador, como reservar una cita.

Eso extiende la misma lógica operativa desde las aplicaciones hasta la web: la IA se está posicionando como una capa de acción entre los usuarios y las interfaces que originalmente se construyeron para la navegación manual.

Un despliegue por fases con implicaciones más amplias

Google dice que las nuevas funciones llegarán en oleadas, empezando por los últimos teléfonos Samsung Galaxy y Google Pixel. También señaló que algunas capacidades relacionadas con Chrome se esperan en junio.

El despliegue por fases subraya una realidad importante en el mercado actual de IA. Incluso cuando las empresas describen los avances de software en términos universales, a menudo los lanzan primero como funciones para dispositivos premium. Eso puede ayudar a controlar las expectativas de rendimiento y las exigencias de hardware, pero también significa que la siguiente fase de la IA en los smartphones podría estar disponible inicialmente para una porción más reducida de usuarios.

Aun así, el anuncio marca un cambio claro de dirección. Gemini ya no se presenta principalmente como un asistente opcional junto a Android. Está siendo integrado en comportamientos móviles centrales: escribir, navegar, comprar, programar y coordinar entre aplicaciones.

Que los usuarios adopten eso depende de dos preguntas aún sin resolver. La primera es la fiabilidad. Las afirmaciones agénticas solo resultan convincentes cuando el sistema puede completar tareas de forma precisa y predecible. La segunda es la confianza. Cuanto más capaces se vuelven estos sistemas, más dependen del acceso al contexto personal, y más tienen que decidir los usuarios si el intercambio vale la pena.

Google ha optado por avanzar en ambos frentes a la vez. Eso convierte a Gemini Intelligence en uno de los cambios de Android más importantes a observar, no porque demuestre que la IA móvil está terminada, sino porque muestra con qué agresividad quieren ahora las empresas de plataformas que la IA desaparezca dentro del sistema operativo y empiece a actuar en nombre del usuario.

Este artículo se basa en la cobertura de Gizmodo. Leer el artículo original.

Originally published on gizmodo.com