La crisis de credibilidad: Por qué las advertencias de la industria de AI están perdiendo su impacto

Un ensayo viral que circula en las plataformas de redes sociales ha reavivado conversaciones sobre el potencial transformador de la inteligencia artificial. El post del empresario Matt Shumer, "Something Big Is Happening", ha acumulado decenas de millones de visualizaciones, con el autor estableciendo paralelismos entre los desarrollos actuales de AI y los primeros signos de advertencia de la pandemia de COVID-19. La afirmación central: el sector tecnológico está experimentando un momento crucial que exige atención y comprensión pública inmediata.

Sin embargo, bajo la superficie de esta última alarma hay un patrón más preocupante. La industria de inteligencia artificial ha desarrollado lo que podría caracterizarse como un problema de credibilidad persistente, donde las advertencias repetidas sobre amenazas existenciales e interrupciones inminentes se han vuelto tan comunes que distinguir las preocupaciones genuinas de la mensajería comercial se ha vuelto cada vez más difícil para los observadores.

Un patrón de predicciones escalonadas

Los líderes de la industria e investigadores han emitido pronunciamientos sombríos sobre la trayectoria de AI con una regularidad notable. Desde prominentes defensores de la seguridad de AI hasta ejecutivos de grandes empresas de tecnología, las advertencias sobre cambios transformadores, desplazamiento laboral y capacidades tecnológicas sin precedentes se han convertido en discurso estándar. Cada nueva predicción llega con una urgencia similar y afirmaciones comparables sobre la magnitud de los cambios inminentes.

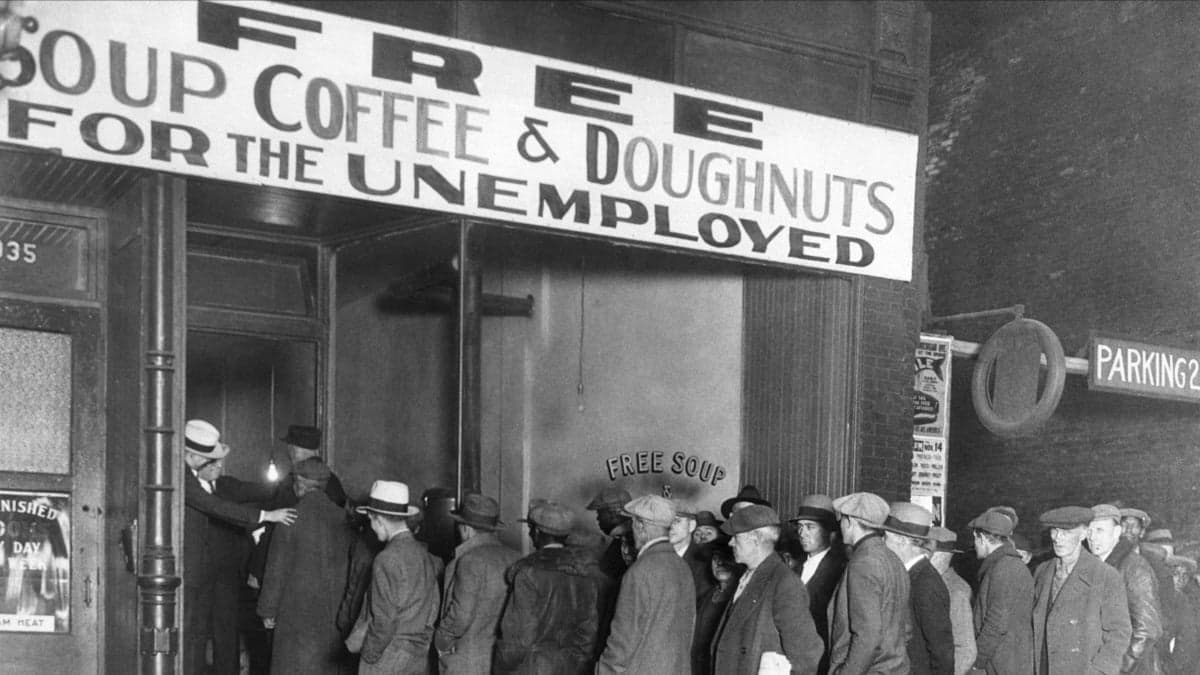

El efecto acumulativo de estas advertencias repetidas presenta un desafío: cuando múltiples voces creíbles predicen consistentemente una interrupción inminente sin verificación correspondiente en el mundo real, la confianza pública se erosiona naturalmente. La dinámica del "niño que gritó lobo" se vuelve operativa, donde el puro volumen de advertencias paradójicamente disminuye su poder persuasivo.

Comprendiendo la estructura de incentivos comerciales

El análisis crítico requiere reconocer los incentivos económicos subyacentes en juego. Cuando los empresarios y líderes de compañías enfatizan la naturaleza revolucionaria de su tecnología, simultáneamente avanzan sus intereses comerciales. Enmarcar la inteligencia artificial como una fuerza que altera el mundo, comparable a revoluciones agrícolas o interrupciones a nivel de pandemia, sirve múltiples propósitos: justifica inversión de capital sustancial, atrae talento superior y posiciona a los primeros usuarios como participantes esenciales en una transformación inevitable.

Esta alineación entre el avance tecnológico genuino y la ventaja comercial crea una tensión inherente. Incluso cuando las preocupaciones sobre el desarrollo de AI están fundamentadas científicamente y son intelectualmente honestas, inevitablemente llevan las huellas de la comercialización estratégica. Distinguir entre advertencias auténticas y narrativas de ventas sofisticadas se convierte en el desafío interpretativo central.

La cuestión de capacidades: separar hecho de hipérbole

El ensayo de Shumer se centra en afirmaciones específicas sobre las capacidades actuales de AI. El argumento se basa en ejemplos demostrables: modelos de AI generativa que supuestamente realizan análisis legal a niveles de expertos, y más significativamente, generación y refinamiento autónomo de código sin intervención humana. Estas afirmaciones justifican un examen cuidadoso.

Los avances recientes en modelos de lenguaje grande ciertamente han producido resultados impresionantes en dominios especializados. Las herramientas de asistencia de codificación han impactado demostrablemente los patrones de empleo para programadores de nivel inicial. La capacidad de los sistemas contemporáneos de AI para procesar información compleja y generar respuestas contextualmente apropiadas se ha expandido sustancialmente. Estos desarrollos representan un progreso tecnológico genuino.

Sin embargo, existen brechas significativas entre las capacidades demostradas y los escenarios transformadores descritos en ensayos virales. Los sistemas actuales operan dentro de parámetros definidos, requieren supervisión humana sustancial y muestran fragilidad cuando se enfrentan con situaciones novedosas. El salto de "impresionantemente capaz dentro de dominios específicos" a "fundamentalmente remodelar la civilización" sigue siendo sustancial y controvertido entre investigadores.

El marco de AGI y singularidad

El argumento de Shumer depende implícitamente de conceptos como inteligencia artificial general y singularidad tecnológica—estados hipotéticos donde los sistemas de AI logran razonamiento a nivel humano en todos los dominios o entran en bucles de retroalimentación de automejoría con crecimiento de capacidad exponencial. Estos conceptos siguen siendo teóricos. Si bien los investigadores debaten la cronología y probabilidad de la aparición de AGI, su logro real sigue siendo especulativo.

La incertidumbre que rodea estas preguntas fundamentales merece reconocimiento. Los investigadores serios en instituciones académicas y compañías de tecnología genuinamente no están de acuerdo sobre si AGI representa un desarrollo inminente o una perspectiva distante. Esta incertidumbre científica legítima a menudo se oscurece cuando las voces de la industria presentan futuros especulativos como resultados inevitables.

Evaluando preocupación genuina versus performativa

La respuesta viral al ensayo de Shumer demostró el apetito por advertencias relacionadas con AI en los límites ideológicos y demográficos. Figuras de alto perfil en todo el espectro político amplificaron el mensaje, sugiriendo que la preocupación genuina sobre la interrupción tecnológica trasciende las divisiones tradicionales.

Sin embargo, simultáneamente, voces escépticas surgieron cuestionando tanto la especificidad de las predicciones como la evidencia subyacente que respalda las afirmaciones de transformación inminente. Esta respuesta bifurcada refleja una incertidumbre pública más amplia: existen razones legítimas para monitorear el desarrollo de AI cuidadosamente, pero también existen razones igualmente legítimas para cuestionar si las advertencias actuales reflejan una evaluación medida o comunicación estratégica.

El camino a seguir: evaluación equilibrada

Reconocer las capacidades genuinas de AI y los impactos potenciales no requiere necesariamente aceptar cada advertencia al pie de la letra. Gobernanza tecnológica robusta, planificación reflexiva del mercado laboral e investigación seria sobre la seguridad de AI representan enfoques prudentes independientemente de si el cambio transformador llega el próximo año o en un cronograma más largo.

El sector tecnológico fortalecería su credibilidad al distinguir entre posibilidades especulativas y capacidades demostradas, reconociendo la incertidumbre explícitamente, y reconociendo cómo los intereses comerciales moldean la mensajería. El discurso público se beneficia cuando los participantes separan claramente lo que los sistemas actuales demostrablemente hacen de lo que podrían lograr teóricamente bajo condiciones idealizadas.

La inteligencia artificial casi con certeza producirá cambios societal significativos. Ya sea que esos cambios surjan gradualmente o precipitadamente, si concentran beneficios o los distribuyen ampliamente, y qué tan efectivamente las sociedades se adapten a la interrupción siguen siendo preguntas abiertas. Estos merecen atención seria—precisamente el tipo de atención que se vuelve más difícil de reunir cuando la fatiga de alarma se establece por advertencias repetidas e indiferenciadas sobre la transformación inminente.

Este artículo se basa en reportajes de Mashable. Lea el artículo original.