Was wäre, wenn die Wärme, die Elektronik normalerweise loswerden will, nützliche Arbeit leisten könnte?

Das ist die Grundidee hinter einem neuen Ansatz für analoges Rechnen, den ein Team unter Leitung von Forschenden des MIT Institute for Soldier Nanotechnologies vorgestellt hat. Statt Abwärme als unerwünschtes Nebenprodukt zu behandeln, nutzten die Forschenden sie als eigentlichen Informationsträger.

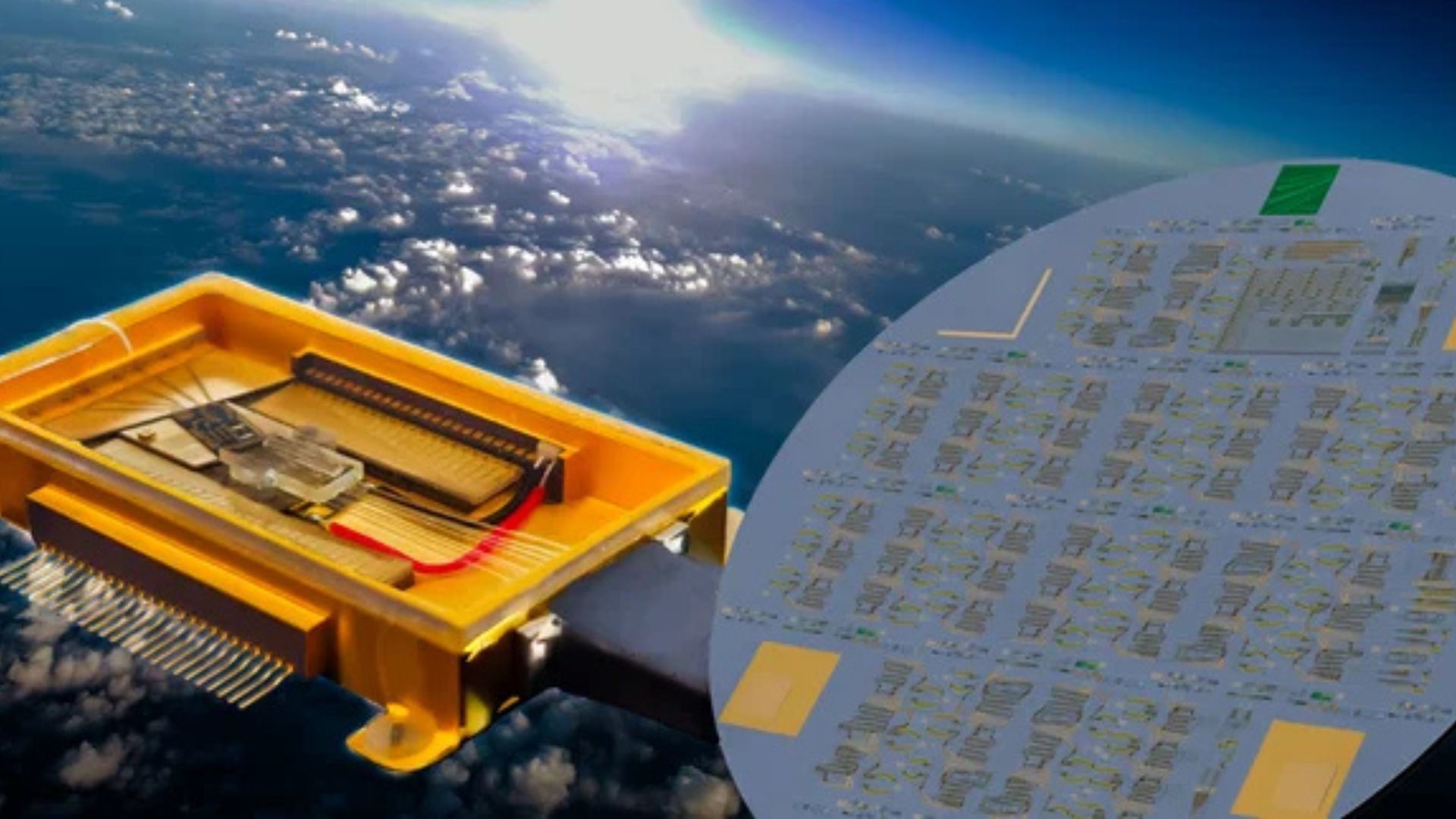

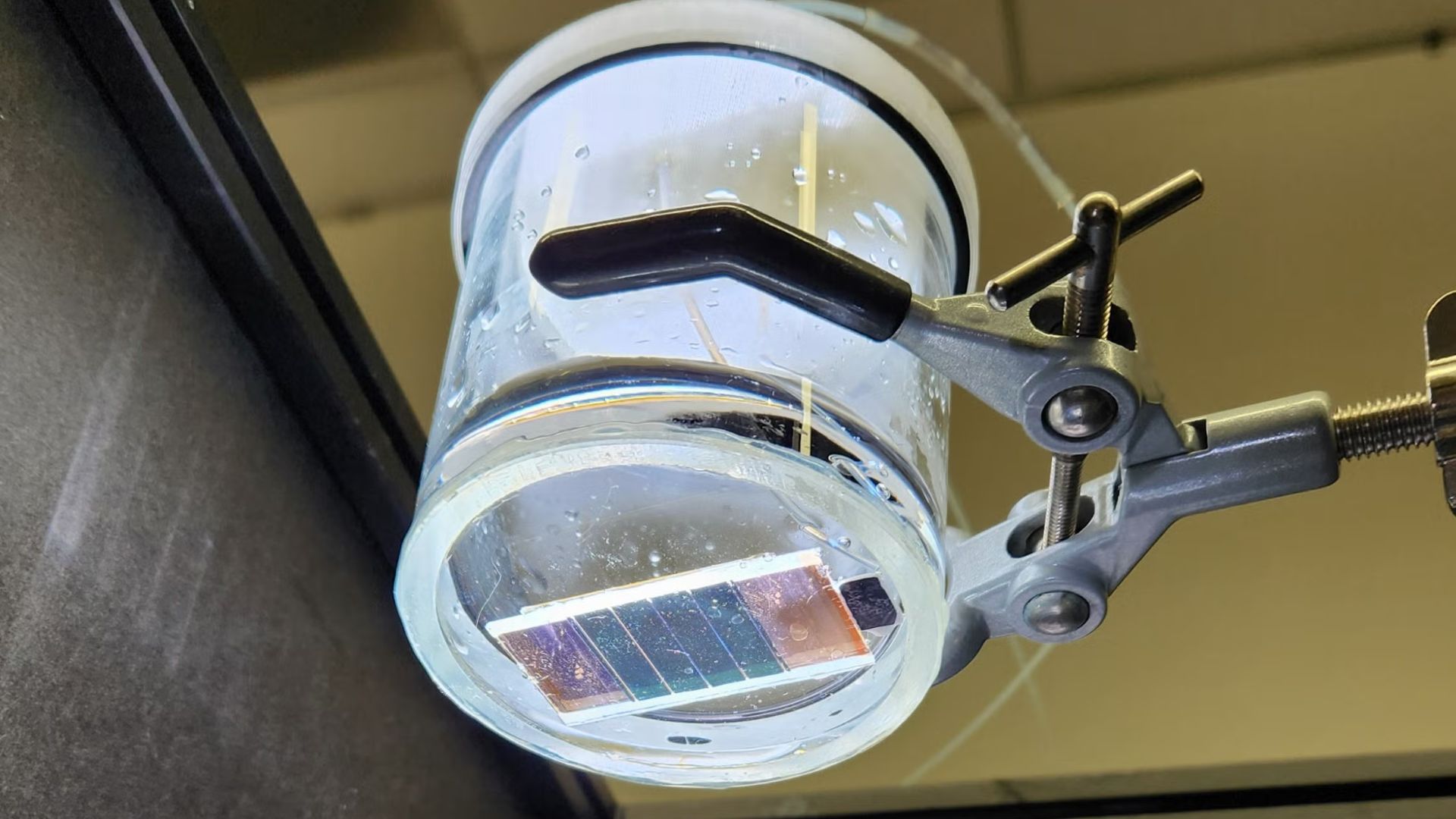

In dem im Ausgangsbericht beschriebenen System werden Eingangsdaten nicht als elektrische Binärwerte codiert. Sie werden als eine Menge von Temperaturen dargestellt, die auf der im Gerät bereits vorhandenen Wärme basieren. Diese thermische Information bewegt sich durch mikroskopische Siliziumstrukturen, deren Geometrie von einem physikbasierten Optimierungsalgorithmus entworfen wurde. Die daraus entstehende Verteilung und der Fluss der Wärme führen die Berechnung aus, während die Ausgabe durch die am anderen Ende gesammelte Leistung dargestellt wird.

Das ist eine bemerkenswerte Umkehr der herkömmlichen Logik. Die meisten modernen Computersysteme arbeiten elektrisch und kämpfen dann mit der Wärme, die sie erzeugen. Diese Arbeit fragt, ob einige Arten von Berechnungen stattdessen auf dieser Wärme aufbauen könnten, um in bestimmten Anwendungen möglicherweise den Bedarf an zusätzlicher Energie zu senken.

Die Forschenden demonstrierten eine zentrale Operation aus dem maschinellen Lernen

Das Team nutzte die Siliziumstrukturen, um eine einfache Form der Matrix-Vektor-Multiplikation auszuführen, eine mathematische Operation, die im Kern von Systemen des maschinellen Lernens steht, einschließlich großer Sprachmodelle. Laut dem Ausgangstext waren die Ergebnisse in vielen Fällen zu mehr als 99 Prozent korrekt.

Diese Genauigkeit ist bemerkenswert, weil Matrixoperationen genau die Art von wiederholter linearer Algebra sind, die viele KI-Workloads dominiert. Grundsätzlich zieht jede neue Methode, die sie effizient ausführen kann, Aufmerksamkeit auf sich. Doch die Forschenden übertreiben nicht, was sie gebaut haben.

Der Ausgangsbericht macht deutlich, dass die Technik noch weit davon entfernt ist, auf die riesigen Systeme skaliert zu werden, die im modernen Deep Learning verwendet werden. Das Zusammenfügen von Millionen solcher thermischen Strukturen würde erhebliche technische Herausforderungen mit sich bringen. Auch die Genauigkeit nimmt ab, wenn die Matrizen komplexer werden und der Abstand zwischen Ein- und Ausgangsanschlüssen wächst.

Es handelt sich also nicht um einen kurzfristigen Ersatz für digitale KI-Beschleuniger. Besser verstanden werden sollte dies als ein Nachweis, dass thermisches analoges Rechnen unter begrenzten Bedingungen real und präzise sein kann.

Warum analoges Rechnen auf Basis von Wärme überhaupt interessant ist

Der Reiz liegt in der Energielogik. Wenn ein Gerät ohnehin Wärme erzeugt und wenn diese Wärme für Sensorik- oder Signalverarbeitungsaufgaben genutzt werden kann, dann kann ein Teil der Rechenlast auf ein vorhandenes physikalisches Nebenprodukt verlagert werden, statt zusätzliche elektrische Arbeit zu erfordern.

Das könnte bei Edge-Geräten, eingebetteter Elektronik und Systemen wichtig sein, bei denen das Wärmemanagement ohnehin eine zentrale Konstruktionsfrage ist. Statt zusätzliche Schaltungen zur Messung oder Verarbeitung temperaturbezogener Informationen einzubauen, könnte ein Chip den Wärmefluss direkt als Betriebsgrundlage für bestimmte Aufgaben nutzen.

Der Ausgangsbericht hebt eine besonders naheliegende Möglichkeit hervor: die Wärmesensorik. Die Forschenden sagen, die Technik könne helfen, problematische Wärmequellen zu erkennen und Temperaturänderungen in Elektronik zu messen, ohne zusätzliche Energie zu verbrauchen. Außerdem könnte sie die Zahl mehrerer Temperatursensoren reduzieren, die wertvolle Chipfläche belegen.

Das dürfte die realistischere erste Anwendung sein. Revolutionäre Rechenparadigmen finden ihren frühen Wert oft nicht darin, Mainstream-Prozessoren zu ersetzen, sondern darin, ein engeres und dringlicheres Problem besser zu lösen als bestehende Werkzeuge.

Ein anderer Blick auf Wärme in der Elektronik

Modernes Chipdesign behandelt Wärme gewöhnlich als technische Einschränkung. Zu viel Wärme verschlechtert die Leistung, verkürzt die Lebensdauer von Komponenten und verursacht Kühlkosten. Das dominierende Ziel ist daher, sie zu minimieren, abzutransportieren oder zu dissipieren.

Diese Forschung nimmt die gegenteilige Position ein. Der Hauptautor Caio Silva, der im Ausgangstext zitiert wird, weist darauf hin, dass Wärme normalerweise das Abfallprodukt elektronischer Berechnung ist. Hier verwendet das Team Wärme als Information selbst.

Dieser Wechsel ist konzeptionell wichtig. Er legt nahe, dass thermisches Verhalten in Geräten nicht nur ein Problem zur Verwaltung ist, sondern auch eine Ressource, die sich formen lässt. Die Siliziumstrukturen sind keine generischen Kanäle. Sie sind optimierte Geometrien, die so entworfen wurden, dass der thermische Fluss eine gewünschte Transformation implementiert.

Im Effekt wird die Materialanordnung Teil der Berechnung. Sobald die Struktur gefertigt ist, begrenzt sie physisch, wie sich Wärme ausbreitet, und ermöglicht es dem Gerät, eine vorgegebene Operation über seine eigene Thermodynamik zu lösen.

Die Grenzen sind real, aber auch die Chance

Viele experimentelle Rechenideen scheitern an der Lücke zwischen einem cleveren Konzeptnachweis und einer herstellbaren, skalierbaren Plattform. Diese Arbeit steht klar vor genau dieser Lücke. Der Ausgangsbericht nennt Probleme bei Skalierung, Komplexität und distanzbedingtem Genauigkeitsverlust. Das sind keine Randdetails. Sie definieren den Unterschied zwischen einem Laborergebnis und einer kommerziell tragfähigen Architektur.

Dennoch hat die Forschung mehrere Eigenschaften, die sie beobachtenswert machen. Erstens zeigt sie in לפחות einigen Matrixoperationen hohe Genauigkeit. Zweitens beruht sie auf mikroskopischen Siliziumstrukturen und ist damit in Materialien und Fertigungsansätzen verankert, die der Halbleiterwelt bereits vertraut sind. Drittens zielt sie auf einen wachsenden Engpass: wie sich das thermische Verhalten immer dichterer Elektronik erfassen, steuern und möglicherweise ausnutzen lässt.

Selbst wenn thermisches analoges Rechnen nie zu einer universellen KI-Engine wird, könnte es eine Rolle in Coprozessoren, On-Chip-Diagnosen oder spezialisierten energiearmen Signalverarbeitungsfunktionen übernehmen.

Warum das im größeren Computerumfeld zählt

Die Bedeutung der Arbeit liegt weniger darin, digitales Rechnen zu ersetzen, als darin, den Begriff von Berechnung zu erweitern. Während KI und andere datenintensive Workloads den Energiebedarf erhöhen, untersuchen Forschende erneut analoge, photonische, neuromorphe und andere unkonventionelle Architekturen auf mögliche Effizienzgewinne.

Diese von MIT geleitete Arbeit passt genau in diesen Trend. Sie schlägt vor, dass thermische Energie, die gewöhnlich als Verlust gilt, teilweise als Funktion zurückgewonnen werden könnte. In einer Zeit, in der jedes Watt auf einem Chip zählt, hat diese Idee praktischen wie philosophischen Reiz.

Der Ausgangsbericht verspricht keinen baldigen Prozessor, der riesige Sprachmodelle allein mit Abwärme betreibt, und er sollte auch nicht so gelesen werden. Was er jedoch bietet, ist ein glaubwürdiger Beleg dafür, dass Wärme in ausgewählten Aufgaben mit hoher Genauigkeit als Information codiert, gelenkt und interpretiert werden kann.

Das könnte ausreichen, um eine neue Forschungsrichtung zu eröffnen. Die Computergeschichte ist voller Beispiele, in denen eine zunächst enge Technik wertvoll wurde, weil sie ein schwieriges Problem ungewöhnlich gut löste. Abwärme-Computing könnte diesen Weg gehen. Seine erste Wirkung könnte nicht darin bestehen, den Prozessor zu ersetzen, sondern die heißeste Schwachstelle des Chips in ein neues Werkzeug zu verwandeln.

Dieser Artikel basiert auf einer Reportage von MIT Technology Review. Den Originalartikel lesen.

Originally published on technologyreview.com