Wahrnehmung als Sicherheit, nicht nur als Leistung

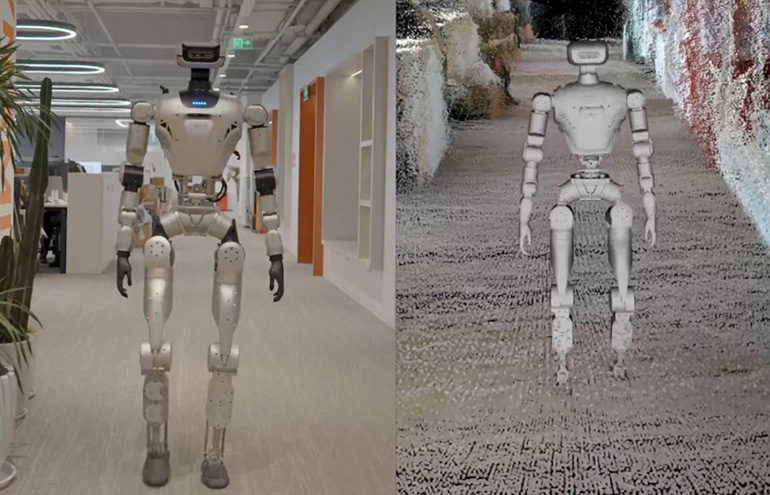

Da Humanoidroboter von Forschungsumgebungen zu kommerzieller und industrieller Nutzung übergehen, werden die technischen Rahmenwerke für ihre Wahrnehmung und Navigation der Welt genauso wichtig wie ihre physischen Fähigkeiten. Auf der NVIDIA GTC 2026 demonstrierte RealSense die Humanoidroboter-Navigation mit LimX Dynamics und zeigte eine Wahrnehmungsarchitektur, die Sicherheit als primäre Designbeschränkung und nicht als Nachgedanken behandelt.

Nadav Orbach, CEO von RealSense, stellte die Herausforderung direkt dar: Humanoide operieren in drei Dimensionen, neben Menschen, in sich ständig verändernden Umgebungen. Wenn Roboter sicher neben Menschen arbeiten sollen, trägt die Wahrnehmung Verantwortung jenseits roher Sensoren. Sie muss als visueller Kortex des Roboters fungieren und ermöglicht genaue Lokalisierung, Kollisionsvermeidung, Geländeverständnis und stabile, vorhersehbare Bewegung in unstrukturierten Umgebungen.

Die technische Grundlage: CuVSLAM und Tiefensensoren

Die RealSense-Demonstration nutzte Tiefenkameras und NVIDIAs CuVSLAM – eine GPU-beschleunigte Visual-Simultaneous-Localization-and-Mapping-Bibliothek – um Echtzeit-3D-Kartierung und Lokalisierung auf der LimX-Humanoidplattform zu ermöglichen. SLAM ist eine grundlegende Fähigkeit für autonome Navigation: Sie ermöglicht es einem Roboter, eine Karte seiner Umgebung zu erstellen und gleichzeitig seine eigene Position innerhalb dieser Karte zu verfolgen, ohne sich auf externe Infrastruktur wie GPS oder vorinstallierte Leuchtfeuer zu verlassen.

Tiefenkameras liefern die Entfernungsdaten, die benötigt werden, um genaue 3D-Darstellungen der Umgebung zu konstruieren und Hindernisse in verschiedenen Entfernungen und Höhen zu erkennen. Für einen bipedalen Humanoidroboter, der Gelände navigiert, das für Menschen ausgelegt ist – einschließlich Treppen, Rampen, enger Gänge und unordentlicher Böden – ist genaues 3D-Geländeverständnis essentiell für sichere Fortbewegung. Ein Roboter, der nur 2D sieht oder begrenzte Tiefenwahrnehmung hat, wird eher Hindernisse falsch einschätzen und fallen oder mit Menschen und Objekten kollidieren.

NVIDIAs CuVSLAM läuft auf den Jetson-Kantencomputing-Modulen des Unternehmens, die zunehmend in Robotikplattformen integriert werden, um die Rechenkraft für Echtzeit-Bildverarbeitung bereitzustellen. Durch die Beschleunigung von SLAM auf GPU-Hardware kann CuVSLAM Tiefendaten in einer Rate verarbeiten, die schnell genug für dynamische Umgebungen ist, in denen sich die Positionen von Menschen und Hindernissen kontinuierlich ändern.

Das Sicherheitsgebot in der Mensch-Roboter-Zusammenarbeit

Der Fokus auf Sicherheit in RealSenses GTC-Präsentation spiegelt eine breitere Verschiebung wider, wie die Robotikbranche die Bereitstellung leistungsstarker mobiler Roboter in gemeinsamen menschlichen Räumen angeht. Industrieroboter haben sich historisch in Käfigumgebungen bewegt, um Mensch-Roboter-Kollisionen zu verhindern. Kollaborative Roboter führten kraftbegrenzte Arme ein, die näher bei Menschen operieren können. Humanoidroboter stellen den nächsten Schritt dar: Plattformen, die frei durch menschliche Umgebungen navigieren können und möglicherweise direkt mit Menschen interagieren.

Dies schafft ein anderes Sicherheitsregime. Ein Humanoidroboter, der sich durch ein Lagerhaus, eine Fabrikhalle oder eine Einzelhandelsumgebung bewegt, muss sich mit unvorhersehbaren menschlichen Bewegungen, unterschiedlicher Beleuchtung, reflektierenden Oberflächen, die Tiefensensoren verwirren, und Gelände befassen, das sich unerwartet verschieben kann. Stürze sind besonders gefährlich – ein Humanoidroboter von bedeutungsvoller Größe kann eine Person verletzen, auf die er fällt.

Die LimX-Plattform in der RealSense-Demonstration scheint diese Szenarien durch redundante Wahrnehmung zu adressieren – mit mehreren Kameramodalitäten und GPU-beschleunigter Verarbeitung, um ein zuverlässiges Umgebungsmodell auch unter Bedingungen zu erhalten, die ein weniger leistungsstarkes System besiegen könnte.

Der GTC-Kontext: NVIDIAs Robotik-Vorstoß

Die NVIDIA GTC 2026 hat einen ungewöhnlich dichten Cluster von Robotik-Ankündigungen gezeigt, was Jensen Huangs erklärte Verpflichtung widerspiegelt, Robotik zu einer wichtigen Geschäftssäule neben Datencenter-KI zu machen. NVIDIAs Jetson-Plattform und Isaac-Robotik-Stack positionieren das Unternehmen als dominanten Compute-Anbieter für autonome Systeme – eine Rolle analog zu der, die GPUs nun in KI-Training und -Inferenz spielen.

Die RealSense-LimX-Demonstration ist ein Beispiel, wie Nvidia ein Ökosystem von Robotikfirmen in die Lage versetzt, leistungsstarke Systeme auf seiner Hardware- und Software-Stack zu bauen. Durch die Bereitstellung von CuVSLAM als vorgebaute Bibliothek, die für Nvidia-Hardware optimiert ist, reduziert das Unternehmen die Entwicklungslast auf Robotikfirmen und standardisiert die Rechenschicht – eine Strategie, die auf dem KI-Datencenter-Markt gut funktioniert hat.

Die breitere Implikation ist, dass die Humanoidroboter-Navigation ein Reifeniveau erreicht, bei dem die kommerzielle Bereitstellung in eingeschränkten Industrieumgebungen machbar wird, wobei sicherheitsorientierte Wahrnehmungsarchitekturen wie der RealSense-Ansatz die ermöglichende Infrastruktur bieten. Die Frage ist nicht mehr, ob Roboter menschliche Räume navigieren können, sondern ob sie dies zuverlässig und sicher genug tun können, um ohne ständige menschliche Überwachung zu operieren.

Dieser Artikel basiert auf Berichten von The Robot Report. Lesen Sie den Originalartikel.

Originally published on therobotreport.com