Was ist GPT-5.4 Thinking?

OpenAI hat sein neuestes Frontier-Reasoning-Modell, GPT-5.4 Thinking, zusammen mit einer detaillierten System Card veröffentlicht, die die Fähigkeiten, Sicherheitsbewertungen und Einschränkungen des Modells dokumentiert. Die Veröffentlichung markiert einen weiteren Schritt in OpenAIs Bemühungen, KI-Systeme zu entwickeln, die in der Lage sind, komplexe, mehrstufige Probleme durch erweiterte Reasoning-Ketten zu lösen, bevor sie den Nutzern endgültige Antworten liefern.

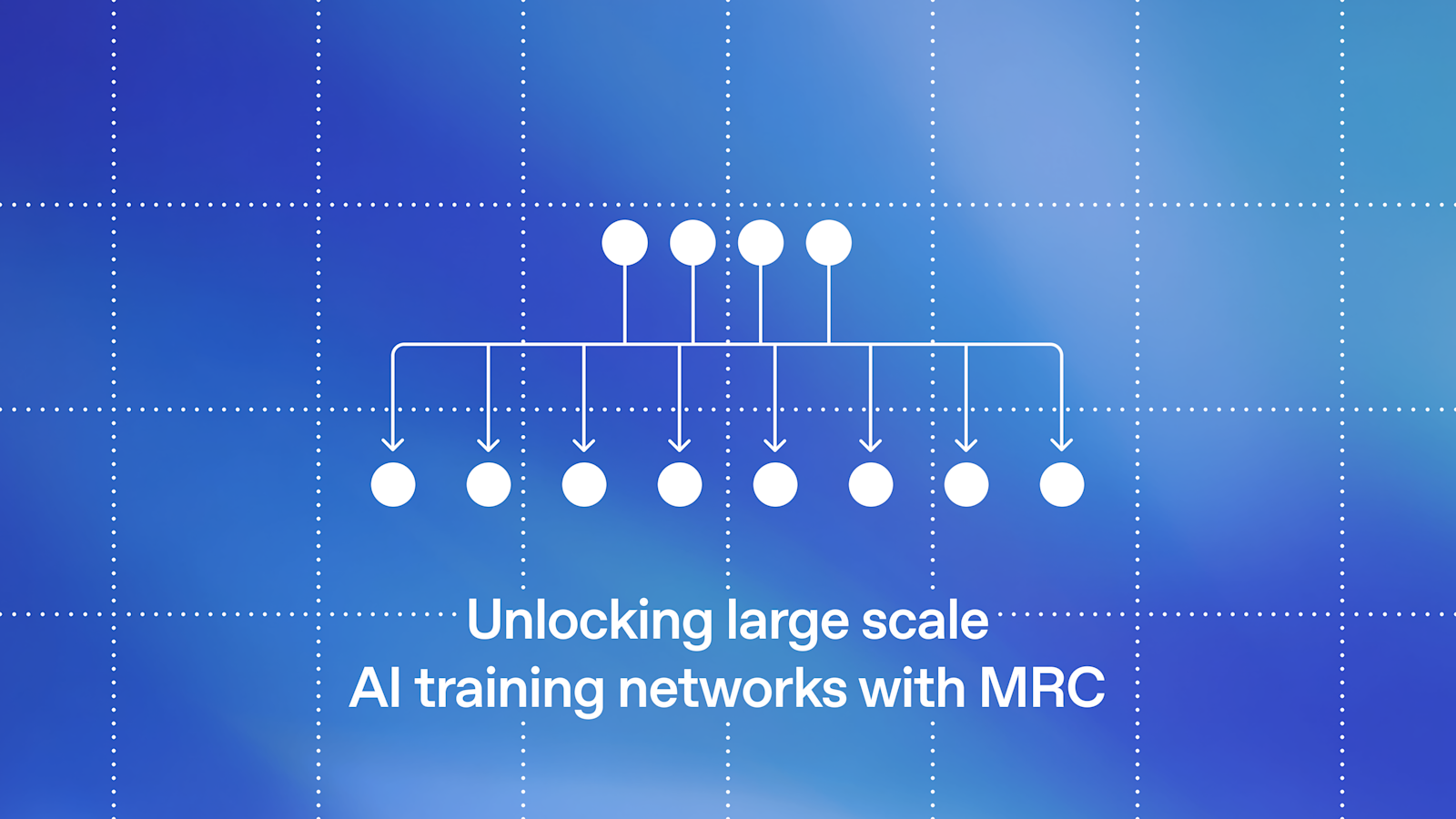

Im Gegensatz zu Standard-Sprachmodellen, die Antworten Token-für-Token ohne Überlegung generieren, nutzt GPT-5.4 Thinking Chain-of-Thought-Reasoning — es arbeitet Probleme intern durch, bevor es sich auf eine Ausgabe festlegt. Diese Architektur ermöglicht es dem Modell, mathematische Beweise, komplexe Codierungsaufgaben, wissenschaftliches Reasoning und nuancierte logische Analysen mit deutlich höherer Genauigkeit als frühere Systeme zu bearbeiten.

Die System Card, die OpenAI für alle Frontier-Modelle veröffentlicht, bietet einen transparenten Überblick darüber, wie das Unternehmen KI vor dem Deployment bewertet. Sie deckt Sicherheits-Benchmarks, Red-Team-Ergebnisse, potenzielle Missbrauchsrisiken und die spezifischen implementierten Maßnahmen ab — und gibt Forschern und Enterprise-Kunden die Informationen, die sie benötigen, um geeignete Anwendungsfälle für das neue Modell zu bewerten.

Sicherheitsbewertungen und Red-Teaming-Ergebnisse

Die Sicherheitstests für GPT-5.4 Thinking folgten OpenAIs Preparedness Framework und bewerteten das Modell in den Bereichen Cybersecurity-Bedrohungen, Ermöglichung biologischer und chemischer Waffen, radiologisches Risiko und autonome Ressourcenbeschaffung. Die System Card ordnet GPT-5.4 Thinking in die Kategorie Medium Gesamtrisiko ein, was bedeutet, dass es mit Standard-Sicherheitsmaßnahmen deployed werden kann, ohne zusätzliche Beschränkungen auszulösen.

Red-Team-Bewertungen testeten die Widerstandsfähigkeit des Modells gegen Jailbreaks, indirekte Prompt-Injektionen und mehrstufige adversariale Manipulationen. GPT-5.4 Thinking zeigte verbesserte Widerstandsfähigkeit gegen viele Angriffsvektoren im Vergleich zu früheren Generationen, obwohl es gegen hochsophistizierte adversariale Eingaben nicht perfekt ist — ein Vorbehalt, der auf alle aktuellen KI-Systeme unabhängig von Trainings-Raffinesse zutrifft.

Bewertungen der Überzeugung und Manipulationsfähigkeiten zeigten, dass das Sicherheitstraining des Modells seine Bereitschaft, Inhalte zu erzeugen, die Nutzer täuschen oder zwingen sollen, erheblich verringert. OpenAI bewertete auch das Verhalten in agentic-Einstellungen, in denen das Modell Sequenzen von Aktionen mit realen Konsequenzen durchführen könnte, und fand die Leistung innerhalb akzeptabler Sicherheitsparameter für den Medium-Klassifizierungsschwellenwert.