Von einem Bild zu einer navigierbaren 3D-Welt

Nvidia-Forscher haben Lyra 2.0 vorgestellt, ein System, das große, kohärente 3D-Umgebungen aus einem einzigen Foto erzeugen soll. Das Unternehmen sagt, die resultierenden Szenen ließen sich in Echtzeit erkunden und in Simulationsplattformen wie Isaac Sim exportieren, wo sie für das Training von Robotern genutzt werden können.

Der Ansatz ist ambitioniert, passt aber sehr gut zu einem zentralen Problem moderner KI für Robotik: Agenten in der Simulation zu trainieren ist deutlich einfacher, günstiger und sicherer als sie ausschließlich in der physischen Welt zu trainieren, doch nützliche Simulationen hängen weiterhin davon ab, Umgebungen zu bauen, die groß, stabil und realistisch genug sind, um relevant zu sein. Wenn ein einzelnes Bild eine kohärente Szene von mehreren Dutzend Metern anstoßen kann, könnte das die Kosten für die Erstellung von Simulationsinhalten spürbar senken.

Laut dem Bericht kann Lyra 2.0 Szenen mit einer Ausdehnung von etwa 90 Metern erzeugen. Noch wichtiger als die reine Größe ist jedoch der Anspruch, dass das Modell zwei häufige Schwächen früherer Methoden behebt: das Vergessen bereits erzeugter Inhalte und das Aufsummieren kleiner visueller Fehler, die sich im Laufe der Zeit zu größeren Verzerrungen verstärken.

Warum lange 3D-Generierung schwierig ist

Bestehende KI-Systeme zur 3D-Szenengenerierung verschlechtern sich oft, sobald sich die virtuelle Kamera weiter vom Startpunkt entfernt. Farben driften ab, Geometrien verändern sich und die Umgebung verliert an Konsistenz. Wenn die Kamera später zu einem bereits gesehenen Bereich zurückkehrt, erfindet das Modell diesen Ort unter Umständen praktisch neu, statt die Kontinuität zur früheren Ansicht zu bewahren.

Für die Robotik sind solche Fehler nicht nur kosmetisch. Eine Simulationsumgebung, die sich während der Erkundung subtil selbst umformt, ist eine schwache Grundlage für das Training verkörperter Systeme, die auf eine stabile räumliche Struktur angewiesen sind. Navigation, Manipulation und Planung werden weniger verlässlich, wenn die Welt selbst nicht beständig ist.

Deshalb ist Szenenkohärenz wichtiger als Neuheit. Eine brauchbare Trainingswelt braucht genug Konsistenz, damit sich ein Agent darin bewegen kann, als handele es sich um einen Ort und nicht nur um einen Strom plausibler Bilder.

Wie Lyra 2.0 das Problem zu lösen versucht

Der Bericht sagt, dass Lyra 2.0 für jedes generierte Frame 3D-Geometrie speichert. Wenn die virtuelle Kamera zu einem zuvor besuchten Bereich zurückkehrt, ruft das System diese früheren Frames ab und nutzt ihre räumlichen Informationen als Referenzmaterial. Die Bildsynthese übernimmt weiterhin das Videomodell, aber die gespeicherte Geometrie soll Orientierung bewahren und helfen, die Kontinuität aufrechtzuerhalten.

Dieses Design zielt auf die erste große Schwäche früherer Systeme: das Vergessen. Wenn zuvor gesehene Regionen wieder abgerufen und über gespeicherte Geometrie neu verankert werden können, hat die generierte Umgebung eine bessere Chance, über längere Trajektorien kohärent zu bleiben.

Das zweite Problem ist Drift, bei dem sich kleine Generierungsfehler Schritt für Schritt aufaddieren. Nvidias Antwort besteht laut Bericht darin, das Modell gegen seine eigenen fehlerhaften Ausgaben zu trainieren, damit es lernt, Verschlechterungen zu erkennen und zu korrigieren, statt sie einfach zu übernehmen. Das ist eine pragmatische Strategie. Anstatt so zu tun, als würde die Generierung sauber verlaufen, setzt der Trainingsprozess das Modell dem Rauschen aus, das es wahrscheinlich selbst erzeugen wird.

Benchmark-Ansprüche und Wettbewerb

Nvidia sagt, Lyra 2.0 habe in Benchmark-Tests auf zwei Datensätzen sechs konkurrierende Ansätze übertroffen, darunter GEN3C, Yume-1.5 und CaM. Der Bericht nennt nicht alle Details dieser Auswertungen, daher sollte die Wettbewerbsbehauptung als Zusammenfassung und nicht als vollständiger technischer Vergleich gelesen werden. Dennoch ist die Bedeutung klar genug: Nvidia präsentiert Lyra 2.0 nicht als Labor-Kuriosität, sondern als State-of-the-Art-Kandidaten für die Generierung von Szenen über große Distanzen.

Diese Einordnung ist wichtig, weil das Feld dicht besetzt ist. Viele Gruppen arbeiten an Bild-zu-3D, Video-Weltmodellen und simulationsfreundlichen generativen Systemen. Wer herausstechen will, muss nicht nur attraktive Demos zeigen, sondern auch unter Bewegung eine stabile Szenenqualität belegen.

Warum Robotik der direkte Anwendungsfall ist

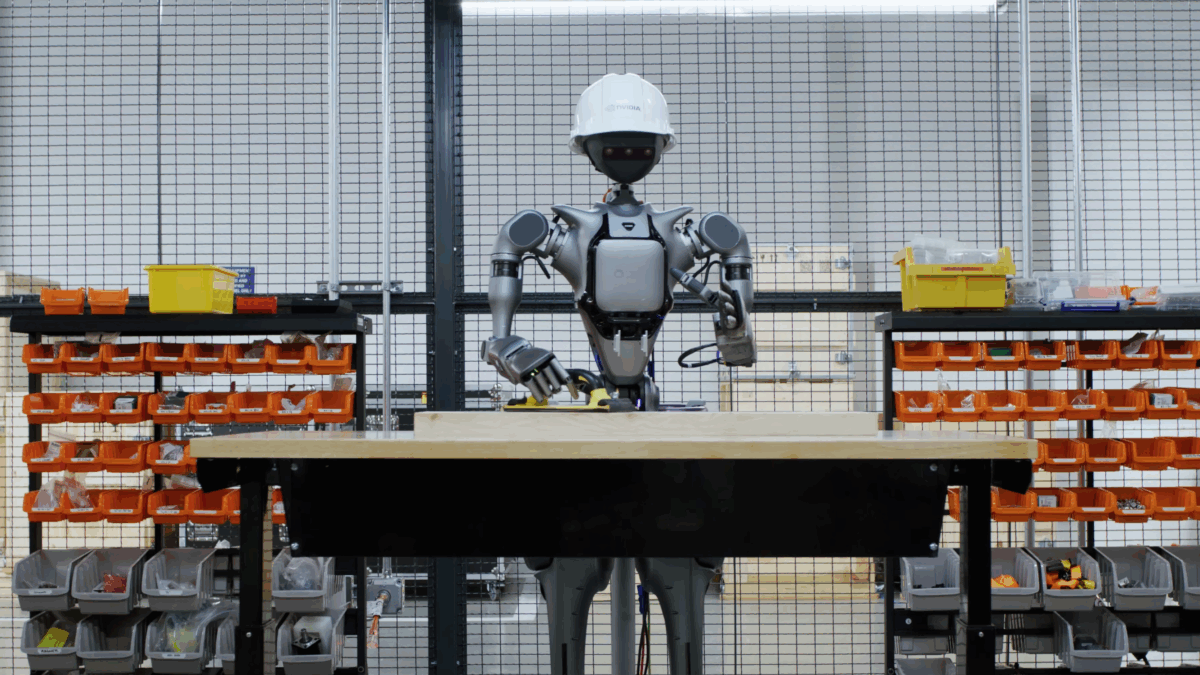

Der direkte Exportpfad in Physik-Engines wie Isaac Sim ist eines der wichtigsten Details des Berichts. Er legt nahe, dass Nvidia nicht nur an Content-Generierung für Visualisierung oder virtuelle Rundgänge interessiert ist. Das Ziel ist verkörperte KI.

Robotiktraining leidet oft unter einem Datenengpass. Realweltliche Datenerhebung ist teuer, und das manuelle Erstellen simulierter Umgebungen kostet Zeit. Ein System, das aus einem einzigen Foto plausible, erkundbare 3D-Räume erzeugen kann, könnte helfen, Trainingsdaten schneller zu skalieren, vor allem bei Navigations- oder Interaktionsaufgaben, bei denen Umweltvielfalt wichtig ist.

Praktisch könnte das Entwicklern erlauben, mit spärlichen visuellen Referenzen zu beginnen und sie rasch zu brauchbaren Simulationsszenen auszubauen. Das würde reale Validierung nicht ersetzen, aber die Vortrainings- und Testpipeline erweitern.

Was das löst und was nicht

Lyra 2.0 behebt ein reales technisches Hindernis, sollte aber nicht mit vollständigem physikalischem Realismus verwechselt werden. Eine kohärente Szene zu generieren ist das eine. Eine Szene zu erzeugen, deren Geometrie, Materialien, Dynamik und Objekt-Affordances präzise genug für einen robusten Transfer auf echte Roboter sind, ist etwas anderes.

Dieser Unterschied ist wichtig, weil Simulation nur so wertvoll ist, wie die dort erlernten Verhaltensweisen den Kontakt mit der Realität überstehen. Selbst hervorragende visuelle Kohärenz garantiert nicht automatisch nützliche Physik oder korrekte Objektinteraktion. Nvidias Bericht deutet das indirekt an, indem er die Exportmöglichkeit zu Physik-Engines hervorhebt. Das legt nahe, dass Lyra nur ein Teil eines größeren Simulations-Stacks ist und nicht die vollständige Lösung für sich allein.

Ein Schritt hin zu skalierbarer Welterzeugung

Dennoch ist die Arbeit bemerkenswert, weil sie das Feld in Richtung einer skalierbareren Methode zum Aufbau von Trainingswelten für Roboter bewegt. Die Kombination aus langer Szenenkohärenz, expliziter Geometrie-Erinnerung und driftbewusstem Training adressiert genau die Probleme, die frühere Systeme begrenzt haben. Wenn diese Fortschritte in breiterer Nutzung Bestand haben, könnte Lyra 2.0 helfen, einen der versteckten Kostenfaktoren in der Robotikentwicklung zu senken: genug Welten zu bauen, in denen Roboter lernen können.

Das ist die tiefere Bedeutung. Fortschritt in der Robotik hängt nicht nur von besseren Policies und größeren Modellen ab. Er hängt auch von besseren Umgebungen ab. Ein Roboter kann nur aus den Welten lernen, die er sieht, und diese Welten gut zu erzeugen wird selbst zu einem immer wichtigeren KI-Problem.

Dieser Artikel basiert auf Berichterstattung von The Decoder. Zum Originalartikel.

Originally published on the-decoder.com