Vom Kreis zum Commerce

Als Google Circle to Search im Januar 2024 einführte, stellte es sich als elegante Lösung für ein hartnäckiges Problem dar: die Schwierigkeiten, die mit der Suche nach etwas verbunden sind, das man auf dem Telefonbildschirm sieht. Statt einen Screenshot zu machen, zu einem Browser zu wechseln, Google Lens zu öffnen und den Screenshot hochzuladen, ermöglichte Circle to Search Benutzern, einfach die Home-Taste lange zu drücken und einen Kreis um alles zu zeichnen, das sie suchen wollten – um Text, ein Bild, ein Produkt, ein Gesicht – ohne die App zu verlassen, in der sie sich befanden. Die Funktion hat sich inzwischen auf Dutzende von Millionen Android-Geräte ausgebreitet und wurde von Google als einer der erfolgreichsten KI-gesteuerten Funktionen genannt, die es in den letzten zwei Jahren bereitgestellt hat.

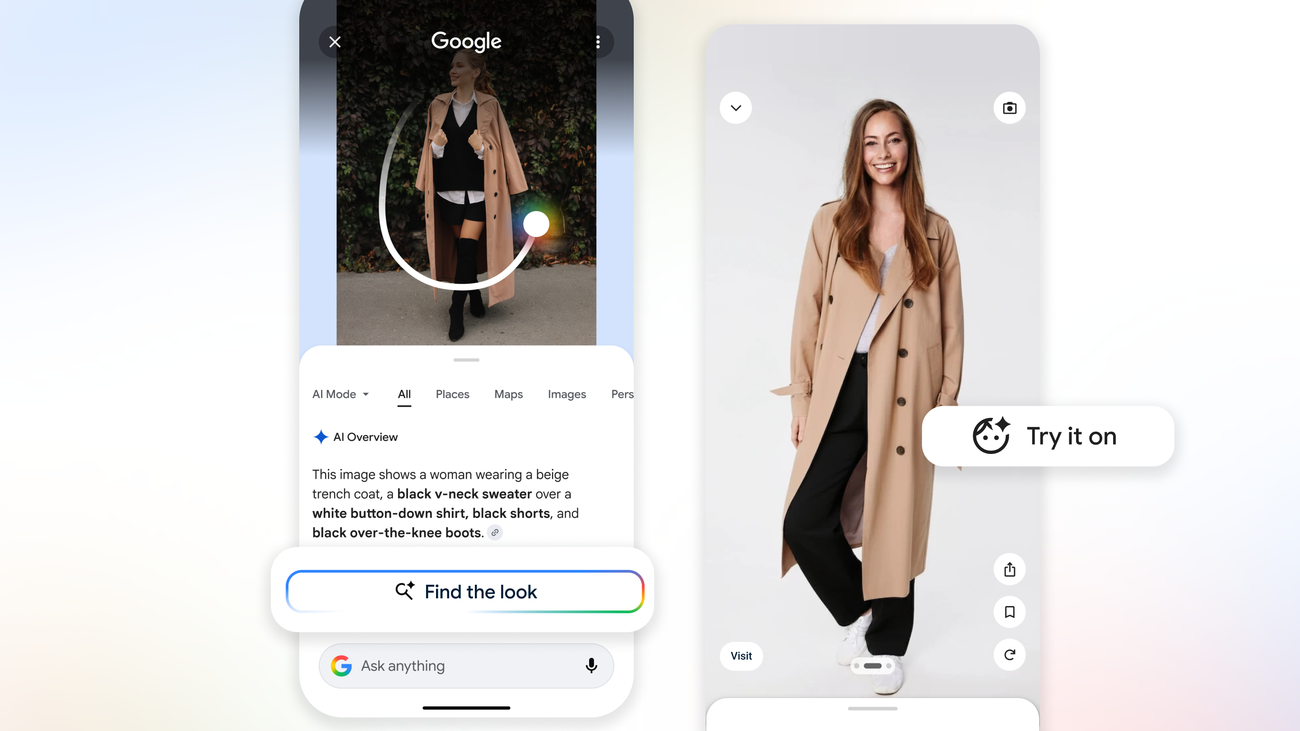

Nun vertieft Google die Fähigkeiten von Circle to Search in einer Richtung, die dessen Nutzen erheblich erweitern wird und, nicht zufällig, auch sein kommerzielles Potenzial. Eine Reihe neuer Updates fügt das hinzu, was Google als Funktionen zur visuellen Intelligenz bezeichnet: die Fähigkeit, bestimmte Modeartikel, Wohnungsdekorationsprodukte und Konsumgüter innerhalb von Bildern zu erkennen und zu suchen – und Einkaufsergebnisse anzuzeigen, mit denen Benutzer herausfinden können, wo diese Artikel verkauft werden, zu welchem Preis und in welchen Konfigurationen. In Kombination mit einer neuen Fähigkeit, das Gesamtbild bei der visuellen Suche zu erfassen – das Verständnis der räumlichen und kontextuellen Beziehungen zwischen Objekten in einer Szene – stellen die Updates eine bedeutende Erweiterung dessen dar, was Circle to Search leisten kann.

Modesuche: Der Hauptanwendungsfall

Die Modeidentifikationsfunktion ist die am unmittelbarsten benutzergerichtete der neuen Funktionen. Mit ihr kann ein Benutzer ein Kleidungsstück in einem Instagram-Beitrag, einer Pinterest-Pin, einem Website-Bild oder sogar einem Foto, das mit der Kamera aufgenommen wurde, markieren und erhält Ergebnisse, die den spezifischen Artikel identifizieren (wenn es sich um ein erkennbares Produkt handelt), visuell ähnliche Artikel von mehreren Einzelhändlern und Informationen über aktuelle Preise und Verfügbarkeit. Das System nutzt Googles visuelle Embedding-Modelle – dieselbe Technologie, die Google Lens' Produktsuche zugrunde liegt – aber direkt in die Circle to Search-Schnittstelle integriert und erweitert, um Teilansichten, unterschiedliche Lichtverhältnisse und teilweise verdeckte Artikel zu handhaben.

Der praktische Anwendungsfall ist einer, den modebewusste Verbraucher sofort erkennen werden: etwas sehen, das jemand trägt, es oder etwas Ähnliches finden wollen und mit dem mühsamen Prozess konfrontiert werden, zu versuchen, es in Textsuchbegriffen zu beschreiben. Circle to Search für Mode behebt diese Reibung vollständig. Die Genauigkeit der Identifikation variiert je nachdem, wie charakteristisch der Artikel ist – ein sehr spezifisches Designerstück mit erkennbarem Branding oder Details wird leichter identifiziert als ein generisches einfarbiges T-Shirt – aber Googles umfangreiche Trainingsdaten über Milliarden von Produktbildern geben dem System eine breite Erkennungsbasis.

Erkennung von Wohnungsdekorationen und Produkten

Dieselben visuellen Erkennungsfähigkeiten erstrecken sich auf Wohnungsdekorationen und Unterhaltungselektronik, Kategorien, in denen Benutzer häufig auf Artikel in Fotografien stoßen – redaktionelle Inhalte, Social-Media-Beiträge, Immobilienangebote – und diese kaufen möchten. Die Identifikation einer bestimmten Lampe, eines bestimmten Teppichmusters oder eines Fernsehmodells aus einer Raumfotografie war historisch gesehen ein schwieriges Problem für Bildsuchsysteme, da diese Artikel häufig in Winkeln, unter unterschiedlichen Lichtverhältnissen und in Teilansichten erscheinen, die eine genaue Identifikation erschweren.

Googles aktualisierte Modelle handhaben diese Szenarien eleganter, indem sie das Objekt in seinem Szenenkontext interpretieren, anstatt es als isoliertes Produktbild abzugleichen. Das System versteht, dass ein Objekt im Hintergrund einer Raumfotografie wahrscheinlich Möbel oder Dekoration ist, berücksichtigt dieses Verständnis im Erkennungsprozess und zeigt Ergebnisse an, die den Betrachtungswinkel und die Lichtverhältnisse berücksichtigen, anstatt ein ideales Katalogbild für eine genaue Identifikation zu erfordern.

Die kommerzielle Dimension

Es wäre naiv, diese Updates zu analysieren, ohne ihre kommerzielle Dimension anzuerkennen. Googles Kernwerbungsgeschäft hängt davon ab, Benutzerabsicht mit kommerziellen Möglichkeiten zu verbinden, und visuelle Suche stellt eine enorme ungenutzte Fläche für diese Verbindung dar. Wenn ein Benutzer ein Produkt in einem Bild markiert, ist dies ein Ausdruck der Kaufabsicht, der spezifischer und umsetzbarer ist als die meisten Textsuchen. Die Fähigkeit, sofort Einkaufsergebnisse aus dieser Absicht anzuzeigen – und dies innerhalb von Apps zu tun, in denen Benutzer bereits engagiert sind, anstatt sie zu zwingen, zu Google zu navigieren – ist aus Werbe- und Handelsperspektive enorm wertvoll.

Google Shopping war jahrelang ein bedeutender Umsatzträger, und die Integration von Circle to Search mit Suchergebnissen macht im Grunde jedes Bild auf einem Android-Gerät zu einem potenziellen Commerce-Kontaktpunkt. Das Unternehmen ist vorsichtig, dies als Benutzervorteil darzustellen – das zu finden, was man möchte – und in den meisten Anwendungsfällen ist diese Rahmung genau. Aber die Ausrichtung zwischen Benutzerkomfort und Googles kommerziellen Interessen ist nicht zufällig, und es ist erwähnenswert, dass die visuellen KI-Verbesserungen, die den Handel am direktesten ermöglichen, diejenigen sind, die in Googles Produktankündigungen die prominenteste Platzierung erhalten.

Ausblick

Die Circle to Search-Updates sind Teil einer breiteren Entwicklung von Googles KI-Funktionen auf dem Gerät. Da Gemini Nano und verwandte Modelle in der Lage sind, zunehmend anspruchsvolle Aufgaben direkt auf mobiler Hardware auszuführen, können Funktionen, die zuvor das Senden von Daten an Googles Server erforderten, lokal ausgeführt werden, mit Auswirkungen auf Latenz und Datenschutz. Google hat angegeben, dass einige Aspekte der visuellen Verarbeitung von Circle to Search mit der Verbesserung der Modelleffizienz zur Ausführung auf dem Gerät übergehen werden, was der Funktion ermöglichen würde, offline zu funktionieren und die mit visuellen Suchen verbundene Datenübertragung zu reduzieren. Derzeit gibt die Kombination aus Cloud-Intelligenz und Ausführung auf dem Gerät Circle to Search ein Funktionsprofil, das für Konkurrenten ohne Zugang zu Googles Umfang an Trainingsdaten und Infrastruktur schwer zu erreichen ist.

Dieser Artikel basiert auf Berichten vom Google AI Blog. Lesen Sie den Originalartikel.

Originally published on blog.google