Die übersehene Seite der KI-Pipeline

Ein Großteil der öffentlichen Debatte über künstliche Intelligenz dreht sich nach wie vor darum, was Systeme erzeugen. Es geht um flüssigen Text, realistische Bilder, Empfehlungen und synthetische Medien. Die leisere Frage, so ein Erklärstück von AI News, lautet: Wie verstehen diese Systeme eigentlich die Informationen, die sie überhaupt erst erhalten?

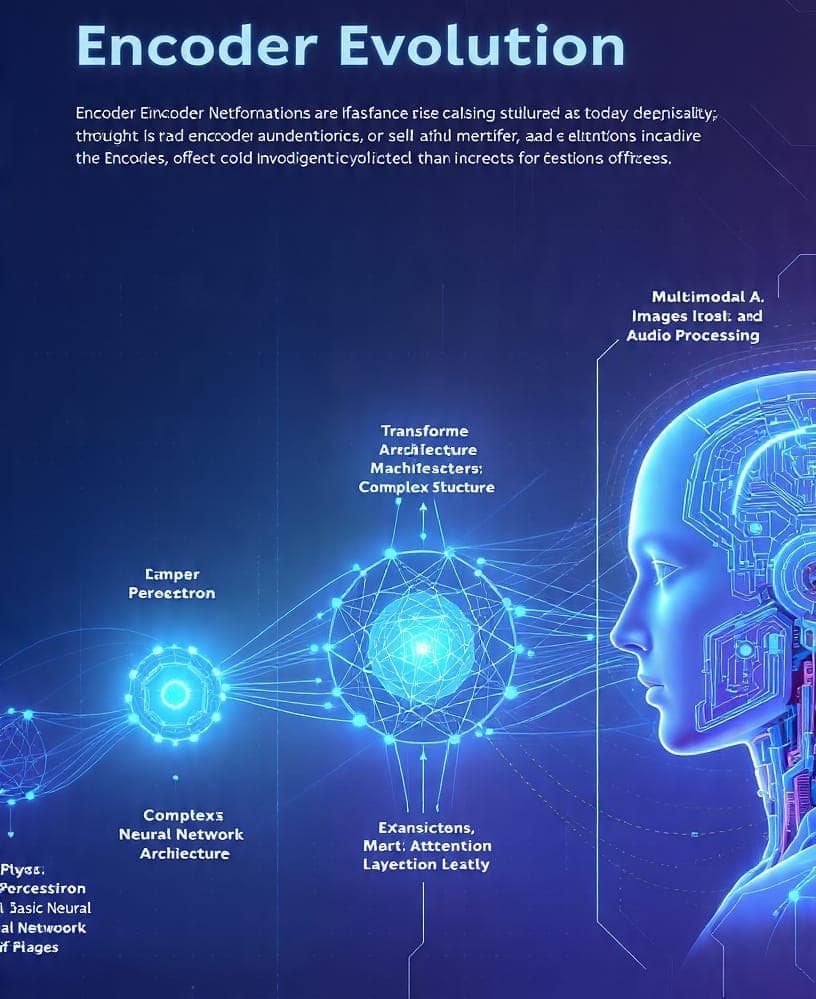

Dieser Blickwinkel ist hilfreich, weil er die Aufmerksamkeit vom Spektakel auf die Struktur lenkt. Die Ausgabe ist das, was Nutzer sehen, aber das Verstehen ist das, was die Ausgabe überhaupt möglich macht. Der Artikel konzentriert sich auf die Entwicklung von Encodern und beschreibt einen Weg von einfacheren Modellen hin zu den Systemen, die heute multimodale KI tragen.

Schon auf hoher Ebene markiert diese Entwicklung eine wichtige Veränderung darin, wie KI gebaut und diskutiert wird. Je mehr Arten von Informationen Systeme aufnehmen, desto geht es nicht mehr nur darum, plausible Antworten zu erzeugen. Es geht auch darum, unterschiedliche Eingabeformen so darzustellen und zu interpretieren, dass sie zu einem einheitlichen Modellverhalten zusammengeführt werden können. Genau dort werden Encoder zentral statt nachrangig.

Die öffentliche Neigung, diese Ebene zu übersehen, ist verständlich. Generierte Inhalte sind leichter vorzuführen als interne Repräsentationen. Eine Chatbot-Antwort oder ein Bildergebnis ist sofort sichtbar. Die Mechanik, die einem Modell hilft, Sprache, Bilder oder andere Signale zu verstehen, ist für Laien weniger lesbar. Doch je wichtiger multimodale KI wird, desto stärker wirkt sich diese verborgene Ebene auf Leistung, Zuverlässigkeit und Produktdesign aus.

Der übergeordnete Punkt des Artikels ist, dass KI-Fortschritt nicht nur durch die Linse der Generierung gelesen werden sollte. Es gibt eine parallele Geschichte darin, wie Systeme Informationen verarbeiten, bevor sie antworten. Diese Geschichte ist technisch, aber auch strategisch. Unternehmen, die multimodale Produkte bauen, ringen nicht nur darum, Ausgaben beeindruckender zu machen. Sie ringen auch darum, die Mechanismen zu verbessern, mit denen Modelle verschiedene Eingaben kohärent interpretieren können.

So gesehen bedeutet der Aufstieg multimodaler KI nicht nur, einem Modell mehr Medientypen hinzuzufügen. Es geht darum, die interne Verarbeitung dieser Medientypen zu verbessern, damit das Verstehen mit der Generierung Schritt hält. Je weiter sich KI in Suche, Assistenten, Produktivitätstools und Kreativsoftware ausbreitet, desto schwerer wird es, diese Unterscheidung zu ignorieren.

Encoder stehen selten im Mittelpunkt der KI-Berichterstattung für Verbraucher. Sie sollten wichtiger sein, als sie es sind. Wenn die nächste Phase der KI durch Systeme definiert wird, die über Formate und Kontexte hinweg arbeiten können, dann hängt der eigentliche Fortschritt nicht nur davon ab, was Modelle sagen oder erschaffen können, sondern davon, wie gut sie zunächst verstehen, was ihnen gegeben wird.

Dieser Artikel basiert auf der Berichterstattung von AI News. Den Originalartikel lesen.

Originally published on artificialintelligence-news.com