Android আরও সক্রিয় AI platform হয়ে উঠছে

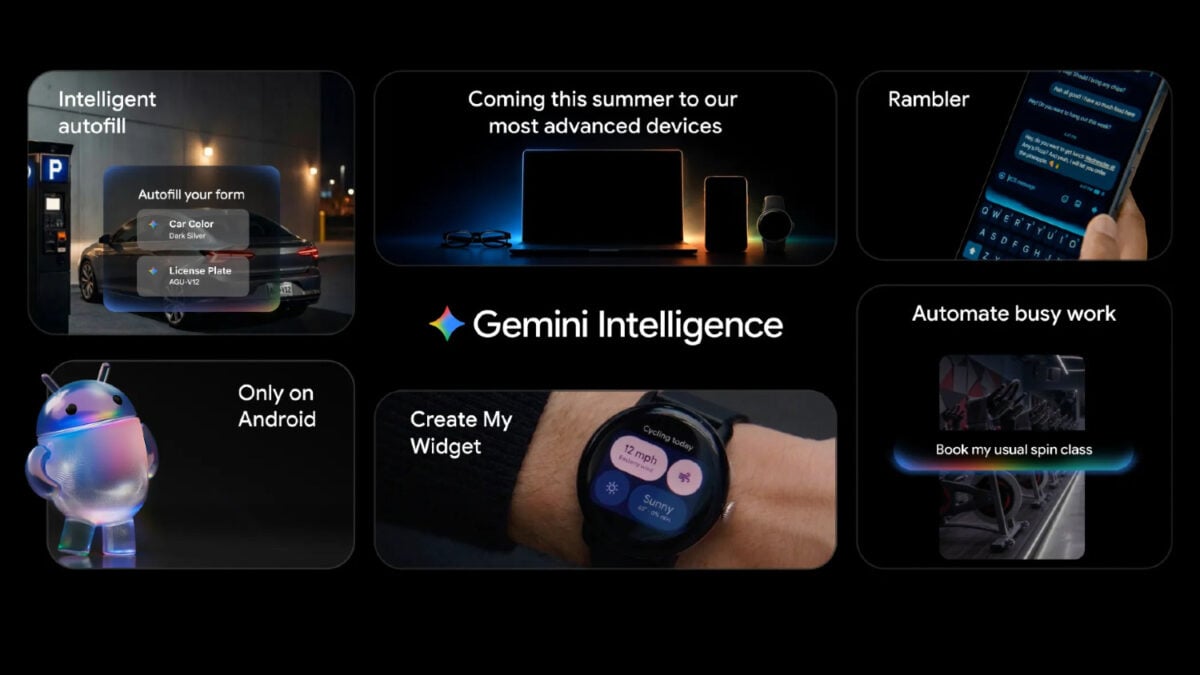

Google Gemini-এর জন্য Android-এ আরও বড় ধরনের সম্প্রসারণের প্রস্তুতি নিচ্ছে, যা এটিকে একটি আলাদা chatbot-এর বাইরে নিয়ে গিয়ে operating system-এর আরও গভীরে নিয়ে যাচ্ছে। Google I/O developer conference-এর আগে, কোম্পানিটি Gemini Intelligence ঘোষণা করেছে, যা Gemini-কে দৈনন্দিন mobile ব্যবহারে আরও সরাসরি নিয়ে আসার জন্য তৈরি AI-powered features-এর একটি suite।

Google-এর framing স্পষ্ট: লক্ষ্য শুধু prompts-এর উত্তর দেওয়া নয়, বরং apps এবং services across ব্যবহারকারীদের proactively কাজ শেষ করতে সাহায্য করা। premium hardware এবং software-এর মিশ্রণের মাধ্যমে Gemini Intelligence তার most advanced devices-এ Gemini-এর best আনবে বলে কোম্পানিটি জানায়।

এই ভাষা গুরুত্বপূর্ণ, কারণ এটি consumer AI-এর একটি পরিচিত প্রবণতার দিকে ইঙ্গিত করে। প্রতিযোগিতা এখন কার chatbot আছে তা থেকে সরে এসে, কে AI-কে routine actions-এর মধ্যে embed করতে পারে সেই দিকে যাচ্ছে। Google-এর ভাষ্য অনুযায়ী, Android এই পরিবর্তনের staging ground হয়ে উঠছে।

assistant থেকে operator

সবচেয়ে গুরুত্বপূর্ণ feature set হলো task automation। Google Gemini Intelligence-কে এমন কার্যকলাপ সামলাতে সক্ষম বলে বর্ণনা করেছে, যা multiple apps জুড়ে বিস্তৃত; এটি সেই agentic model-এর দিকে একটি পদক্ষেপ, যার ইঙ্গিত অনেক বড় platform company মাসের পর মাস দিয়ে আসছে।

Google যে উদাহরণগুলো বেছে নিয়েছে সেগুলো flashy নয়, বরং বাস্তবসম্মত। সিস্টেমটি ব্যবহারকারীদের spin class-এর জন্য front-row bike পেতে সাহায্য করতে পারে, Gmail-এর মধ্যে class syllabus খুঁজে দিতে পারে, তারপর প্রয়োজনীয় books shopping cart-এ যোগ করতে পারে। এটি grocery list-এর একটি ছবি নিয়ে সংশ্লিষ্ট items দিয়ে Instacart cart পূরণও করতে পারে।

এই উদাহরণগুলো দেখায়, ফোনে AI-এর জন্য সবচেয়ে convincing consumer argument কথোপকথন নয়, সুবিধা—এমনটাই Google বাজি ধরছে। feature যদি নির্ভরযোগ্যভাবে কাজ করে, তাহলে intention থেকে action-এ যেতে প্রয়োজনীয় taps এবং app switch-এর সংখ্যা কমে যায়। এটি যদি অসংগতভাবে কাজ করে, তবে সাধারণ কাজকেও opaque automation failure-এ পরিণত করার ঝুঁকি থাকে।

যেভাবেই হোক, কৌশলগত বিষয়টি স্পষ্ট। Google চাইছে Gemini software-এর ভেতরে কাজ করুক, শুধু তার সম্পর্কে কথা না বলুক।

Rambler এবং voice input-এর পরের ধাপ

আরেকটি গুরুত্বপূর্ণ feature হলো Rambler, একটি speech-to-text tool যা filler words এবং repetition-সহ natural speech patterns বিবেচনায় নিতে তৈরি। ব্যবহারকারীদের পরিষ্কারভাবে dictation করতে বাধ্য করার বদলে, Google বলছে Rambler বলা কথার গুরুত্বপূর্ণ অংশগুলো শনাক্ত করে সেগুলোকে সংক্ষিপ্ত বার্তায় রূপ দিতে পারে।

এটি ছোট উন্নতি মনে হতে পারে, কিন্তু voice interfaces-এর একটি বাস্তব দুর্বলতাকে এটি ঠিক করে। অনেক মানুষ পরিপাটি, punctuation-ready বাক্যে কথা বলেন না। তারা বলতে বলতে নিজেকে সংশোধন করেন, phrases পুনরাবৃত্তি করেন, এবং মূল পয়েন্টে পৌঁছানোর আগে এদিক-ওদিক করেন। এমন speech-কে পরিষ্কারভাবে distill করতে পারা system messaging এবং note-taking contexts-এ voice input-কে আরও উপযোগী করতে পারে।

Google আরও বলছে Rambler একই message-এর মধ্যে বিভিন্ন ভাষার মধ্যে switch করতে পারে। এই feature multilingual communication বাস্তবে কীভাবে কাজ করে, বিশেষ করে যেসব অঞ্চলে code-switching ব্যতিক্রম নয় বরং স্বাভাবিক, তা প্রতিফলিত করে।

কোম্পানিটি privacy signal-ও যোগ করেছে, জানিয়ে যে Rambler চালু থাকলে তা স্পষ্টভাবে দেখায় এবং audio কেবল real-time transcription-এর জন্য ব্যবহার হয়, সংরক্ষণ বা save করা হয় না।

ব্যক্তিগত data, opt-in controls, এবং browser reach

Gemini Intelligence-এর মাধ্যমে Google AI-powered autofill-ও বাড়াচ্ছে। সিস্টেমটি Personal Intelligence-এর ওপর ভর করে ব্যবহারকারীর হয়ে forms এবং text fields পূরণ করতে পারে, যা একটি opt-in layer এবং Gemini-কে YouTube history ও Google search records-এর মতো তথ্যের access দেয়।

এটি rollout-এর সবচেয়ে বিতর্কিত অংশগুলোর একটি হয়ে উঠতে পারে। একদিকে, autofill ব্যবহারকারীর context জানলে আরও কার্যকর হয়। অন্যদিকে, সেই contextual depth একটি personal assistant কতটা জানা উচিত এবং ব্যবহারকারীরা কতটা স্বাচ্ছন্দ্যে সেই data ছেড়ে দেবেন তা নিয়ে অনুমানযোগ্য উদ্বেগ বাড়ায়। Google-এর উত্তর হলো featureটি strictly opt-in।

Android-এর জন্য Chrome-এর মধ্যেও Gemini আরও গভীরে যাচ্ছে। Google বলছে assistant web across content summarize এবং compare করতে পারবে, desktop experiences-এর মতো, এবং auto browse capability পাবে যা appointment booking-এর মতো browser-based tasks automate করতে পারবে।

এটি apps থেকে web-এ একই operating logic-এর সম্প্রসারণ: AI-কে users এবং interfaces-এর মধ্যে একটি action layer হিসেবে স্থাপন করা হচ্ছে, যেগুলো মূলত manual navigation-এর জন্য তৈরি হয়েছিল।

ধাপে ধাপে rollout এবং বিস্তৃত প্রভাব

Google বলছে নতুন features ধাপে ধাপে আসবে, শুরু হবে সর্বশেষ Samsung Galaxy এবং Google Pixel phones থেকে। কিছু Chrome-related capability June-এ আসার কথা বলেও কোম্পানিটি জানিয়েছে।

এই staged rollout বর্তমান AI market-এর একটি গুরুত্বপূর্ণ বাস্তবতাকে তুলে ধরে। কোম্পানিগুলো software advances-কে সার্বজনীন ভাষায় বর্ণনা করলেও, তারা প্রায়শই প্রথমে premium-device feature হিসেবেই তা চালু করে। এতে performance expectations এবং hardware demands নিয়ন্ত্রণে রাখা যায়, তবে smartphone AI-এর পরের ধাপ শুরুতে সীমিত কিছু ব্যবহারকারীর কাছেই পৌঁছাবে।

তবু, এই ঘোষণা একটি স্পষ্ট দিক পরিবর্তনের ইঙ্গিত দেয়। Gemini আর Android-এর পাশে বসে থাকা একটি ঐচ্ছিক assistant হিসেবে মূলত উপস্থাপিত হচ্ছে না। এটি core mobile behaviors-এ গাঁথা হচ্ছে: typing, browsing, shopping, scheduling, এবং app-to-app coordination।

ব্যবহারকারীরা এটি গ্রহণ করবেন কি না, তা নির্ভর করছে দুটি অনির্ধারিত প্রশ্নের ওপর। প্রথমটি reliability। Agentic দাবি তখনই আকর্ষণীয়, যখন সিস্টেম কাজগুলো সঠিক ও পূর্বানুমেয়ভাবে সম্পন্ন করতে পারে। দ্বিতীয়টি trust। এই systems যত বেশি সক্ষম হচ্ছে, তত বেশি personal context-এ access-এর ওপর নির্ভর করছে, এবং ব্যবহারকারীদের ঠিক করতে হচ্ছে এই বিনিময় মূল্যবান কি না।

Google দুই দিকেই একসঙ্গে এগোতে বেছে নিয়েছে। তাই Gemini Intelligence নজর রাখার মতো Android পরিবর্তনগুলোর একটি, কারণ এটি প্রমাণ করে না যে mobile AI শেষ, বরং দেখায় platform companies এখন কতটা আক্রমণাত্মকভাবে চাইছে AI operating system-এর ভেতরে মিশে গিয়ে ব্যবহারকারীর হয়ে কাজ করুক।

এই নিবন্ধটি Gizmodo-এর রিপোর্টিং-এর ভিত্তিতে। মূল নিবন্ধ পড়ুন.

Originally published on gizmodo.com