AI Silahlanma Yarışında Yeni Bir Cephe

Claude büyük dil modelleri ailesi arkasındaki AI güvenliği şirketi Anthropic, amiral gemisi sisteminin dış aktörlerin Claude'ı sistematik olarak sorguladığı "endüstriyel ölçekte" model distilasyonu ile karşı karşıya olduğunu açıklamıştır. Bu, rakip AI sistemlerini oluşturmak için kullanılan eğitim verilerini orijinal geliştirme maliyetinin bir kısmına üretme pratiğidir.

Model distilasyonu, güçlü bir AI sistemine dikkatli bir şekilde hazırlanmış istemler beslemek ve bunun çıktılarını orijinalin yeteneklerini taklit eden daha küçük, daha ucuz bir modeli eğitmek için kullanmak anlamına gelir. Teknik araştırma topluluğunda yıllardır bilinmesine rağmen, Anthropic'in tehdidi "endüstriyel ölçekte" olarak nitelendirmesi, sorunun akademik deneyci çalışmasından jamanıal işbirliğine dönüştüğünü göstermektedir.

Distilasyon Nasıl Çalışır

Distilasyonun temel mekanizması basittir. Bir saldırgan hedef modelden binlerce veya milyonlarca istem-yanıt çifti oluşturur, ardından bu çiftleri yeni bir model için eğitim verisi olarak kullanır. Sonuç olarak ortaya çıkan sistem, ham veriye karşı sıfırdan eğitmek için gereken muazzam hesaplama masrafı olmadan belirli görevlerde hedefin davranışını yaklaşık olarak taklit edebilir.

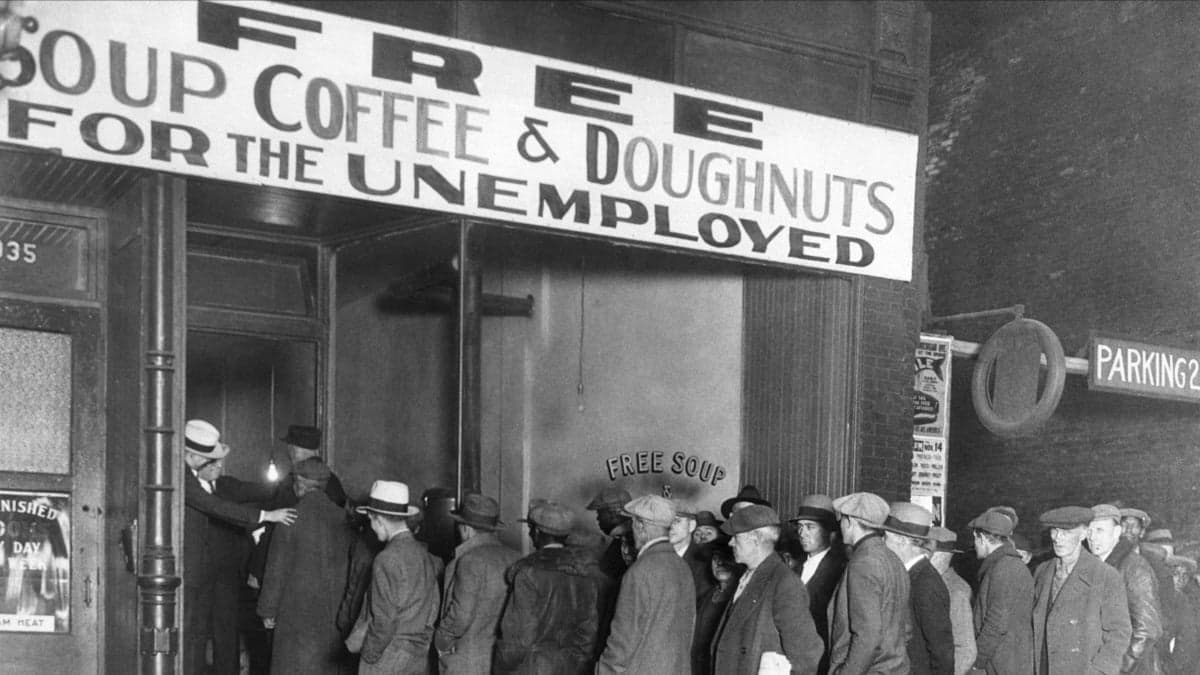

Endüstriyel ölçekte distilasyonu özellikle endişe verici kılan şey onun verimliliğidir. Claude gibi sınır AI modelini eğitmek, hesaplama, veri kürasyon ve mühendislik yeteneğine yüzlerce milyon dolar gerektirir. Distile edilmiş bir model, orijinal yeteneğinin önemli bir kısmını dolar başına sentler karşılığında ele geçirebilir ve bu da şirketlerin AI araştırmasının sınırlarını itme konusundaki ekonomik teşviklerini baltalır.

Saldırıların tespit edilmesi ve önlenmesi zordur, çünkü binlerce API hesabına dağıtılabilir ve her biri görünüşte meşru sorgular yapar. Anthropic hız sınırlandırması, kullanım deseni analizi ve diğer teknik karşı önlemleri uygulamıştır, ancak kararlı saldırganlar tespiti önlemek için stratejilerini uyarlayabilir.

AI Endüstrisine Etkileri

Distilasyon tehdidi, AI araştırmasını finanse eden iş modelinin kalbini hedef alır. Anthropic, OpenAI ve Google gibi şirketler, sınır modeller geliştirmeye milyarlar yatırır ve bu yatırımları API erişim ücretleri ve kurumsal sözleşmelerle geri almayı bekler. Rakipler distilasyon yoluyla bu modellerin yeteneklerini ucuz bir şekilde taklit edebilirlerse, sınır AI geliştirmesinin ekonomisi sürdürülemez hale gelir.

Bu dinamik rahatsız edici bir paradoks yaratır. AI sistemlerini API'ler aracılığıyla geniş çapta erişilebilir hale getirmek — benimseme ve gelir oluşturma için gerekli olan — aynı zamanda onları distilasyona maruz bırakır. Şirketlerin açıklık ile koruma arasında denge kurması gerekir, ancak bunun kolay bir teknik çözümü yoktur.

- Model distilasyonu, orijinal eğitim maliyetinin %1'inin altında bir sınır modelinin görev özel performansının %80-90'ını taklit edebilir

- Teknik, distile edilmiş modellerin orijinalin kalitesiyle eşleşebileceği veya yaklaşabileceği dar, iyi tanımlanmış görevler için özellikle etkilidir

- Açık kaynak AI modellerinin, tescilli sistemlere karşı distilasyondan önemli ölçüde faydalandığı gösterilmiştir

- AI model çıktılarını fikri mülkiyet olarak koruma konusundaki yasal çerçeve hala yetersiz olarak geliştirilmiştir

Yasal ve Etik Gri Alanlar

Model distilasyonunun yasallığı bulanık bir bölgede mevcuttur. Çoğu AI şirketinin hizmet şartları, çıktılarının rakip modelleri eğitmek için kullanılmasını yasaklar, ancak uygulama zordur ve yasal emsal azdır. Mahkemeler henüz AI tarafından oluşturulan çıktıların fikri mülkiyet koruması için uygun olup olmadığına kesin karar vermemiştir ve uygulamanın küresel doğası yargı yetkisinin uygulanmasını karmaşık hale getirir.

Bazı araştırmacılar, distilasyonun teknolojik ilerlemenin doğal ve faydalı bir parçası olduğunu, donanım endüstrilerinde tersine mühendislik benzerine tartışıyorlar. Diğerleri, bunun temel araştırmalara yatırımı caydırarak sonunda AI ilerlemeyi yavaşlatacak bir hırsızlık biçimi olduğunu savunuyorlar.

Anthropic'in kamuya açık açıklaması hem endüstri için bir uyarı hem de eylem çağrısı olarak işlev görür. Sorunu açıkça adlandırarak, şirket distilasyonun bir tehdit olarak daha geniş kabul edilmesini ve muhtemelen düzenleyici veya yasal yanıtlar için zemin hazırlamaktadır.

İleri Yol

Distilasyona karşı teknik karşı önlemler hızla gelişmektedir. Model çıktılarına algılanabilir imzalar yerleştiren filigran teknikleri, gelişmiş kullanım izleme sistemleri ve sözleşmesel uygulama mekanizmaları, tümü gelişen savunma araç setinin bir parçasını oluşturur. Ancak, erişebilirlik ile koruma arasındaki temel gerginlik teknoloji yalnız tarafından çözülmesi olası değildir.

Anti-distilasyon standartları hakkında endüstri işbirliği, AI çıktıları için daha net fikri mülkiyet çerçeveleri ve potansiyel olarak eğitim amaçları için AI tarafından oluşturulan içeriğin kullanımını yöneten yeni düzenlemeler, sorunu kapsamlı bir şekilde ele almak için gerekli olabilir. Şimdilik, Anthropic'in tehdit hakkında açık değerlendirmesi, AI endüstrisinin rekabetçi dinamiklerinin model performans kıyaslamalarının çok ötesine gidilen yollarla yoğunlaştığının sert bir hatırlatmasıdır.

Bu makale AI News tarafından yapılan raporlamaya dayanmaktadır. Orijinal makaleyi okuyun.