Cuma Günü Tarihi ve AI Etiği Üzerine Soğuk Savaş

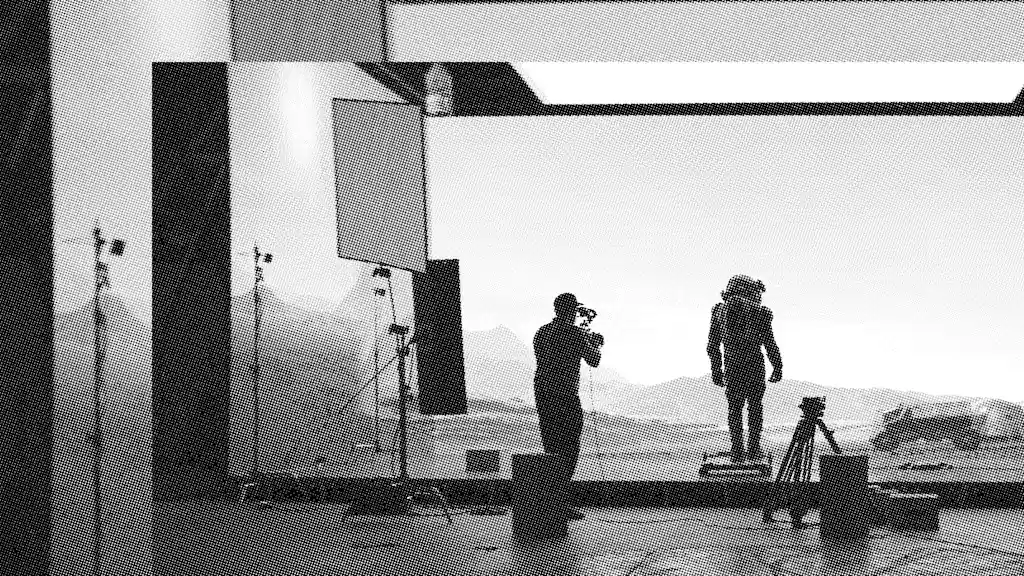

Claude dil modelleri ailesinin arkasındaki AI güvenliği şirketi Anthropic, ABD Savunma Bakanlığı'yla olağanüstü bir çatışmayla karşı karşıyadır. Raporlara göre Pentagon, Anthropic'in AI teknolojisinin askeri uygulamaları üzerindeki kısıtlamalarını gevşetmesini talep etmiştir — özellikle otonom silah sistemleri ve kitle gözetiminde kullanım yasağını. Anthropic reddetti ve Savunma Bakanlığı, Soğuk Savaş döneminden kalma ve hükümete özel şirketleri ulusal savunma üretimine öncelik vermeye zorlayabilecek bir yasa olan Defense Production Act'ı çalıştıracağını tehditle yanıt verdi.

Şirket Cuma gününe kadar uyması için zaman verildi. Anthropic direncini devam ettirirse, Pentagon yasal olarak şirketi askeri amaçlar için AI yeteneklerine erişim sağlamaya zorlayabilir ve bu da AI endüstrisinde benzer bir örneği olmayan yasal ve etik bir çatışma oluşturur.

Anthropic'in Kısıtladığı Şeyler Neler

Kuruluşundan beri Anthropic, AI modellerinin otonom silahlar, kitle gözetimi ve şirketin AI'yi güvenli bir şekilde geliştirme misyonuyla uyumlu olmadığını düşündüğü diğer uygulamalar için kullanımını açıkça yasaklayan kabul edilebilir kullanım politikasını devam ettirmektedir. Bu kısıtlamalar AI endüstrisinde alışılmadık değildir — çoğu büyük AI şirketinin benzer politikaları vardır — ancak Anthropic, AI güvenliğine temel bir kuruluş ilkesi olarak taahhütü hakkında özellikle sesli olmuştur.

Şirket, kısmen AI geliştirmesinin hızı ve yönetişimi hakkındaki endişeler nedeniyle eski OpenAI araştırmacıları Dario ve Daniela Amodei tarafından kurulmuştur. Marka kimliği sorumlu AI geliştirmesi etrafında inşa edilmiştir ve AI hizalaması ve yorumlanabilirliğe ilişkin araştırmaları, onu yapay zekanın güvenlik-ilk yaklaşımında lider olarak konumlandırmıştır. Askeri kısıtlamalardan geri çekilmek, şirketin temel anlatısını zayıflatacaktır.

Defense Production Act (Savunma Üretim Yasası) Tehdidi

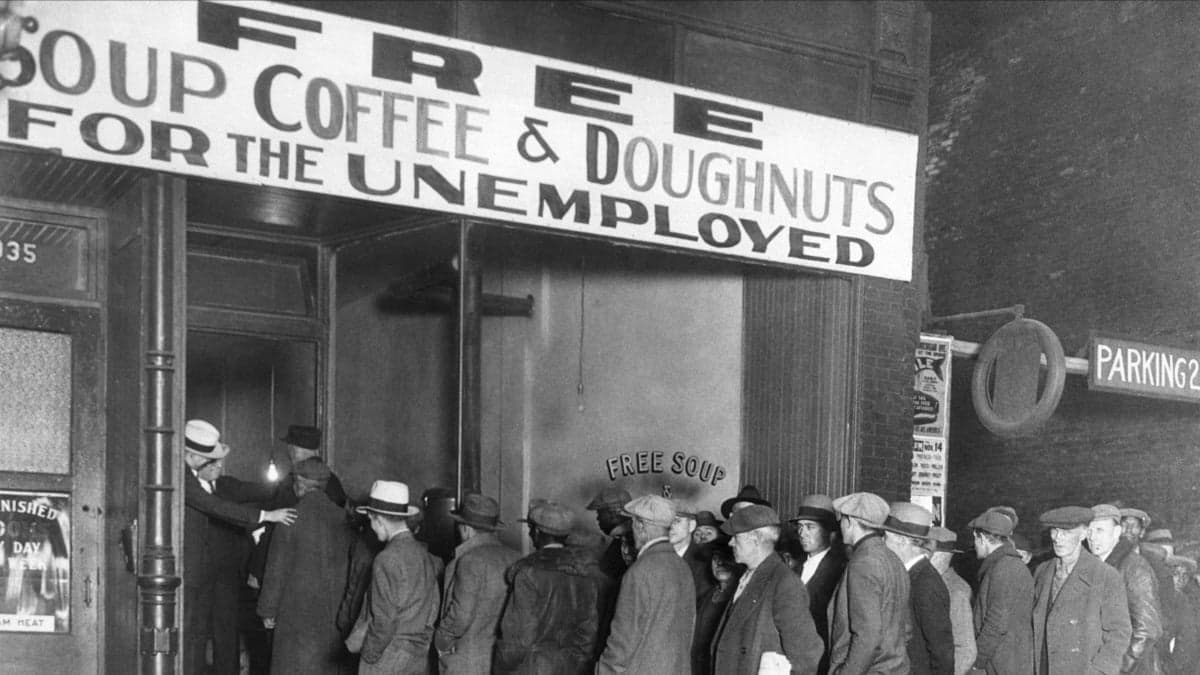

1950'de Kore Savaşı sırasında yasalaştırılan Defense Production Act, başkana özel endüstriyi ulusal savunma için gerekli olarak değerlendirilen sözleşmeleri ve siparişleri önceliklendirmeye yönlendirme konusunda geniş yetki verir. Çeşitli amaçlar için dönemsel olarak çalıştırılmıştır — en son COVID-19 pandemisi sırasında tıbbi malzeme üretimini zorlama amacıyla — ancak bunu bir AI şirketini askeri uygulamalar için teknoloji sağlamaya zorlamak için kullanmak, yasanın emsalsiz bir uygulaması olacaktır.

Yasal uzmanlar, böyle bir uygulamanın yargısal incelemeye dayanıp dayanamayacağı konusunda bölünmüştür. DPA, fiziksel mal üretimi — çelik, mühimmat, tıbbi ekipman — için tasarlanmıştır, bir yazılım şirketini hizmet şartlarını değiştirmeye zorlamak için değil. AI modeli erişiminin, yasa kapsamında ele geçirilebilecek bir "ürün" oluşturup oluşturmadığı sorusu, mahkemelerin henüz ele almadığı yeni yasal sorular ortaya çıkarır.

- Pentagon, Anthropic'i otonom silahlar ve gözetimde AI kullanımı kısıtlamalarını kaldırmaya talep ediyor

- Anthropic, AI güvenliği ilkelerine olan temel taahhütünü belirterek reddetti

- Savunma Bakanlığı, Cuma günü tarihine kadar Defense Production Act uygulanmasını tehdid ediyor

- Yasal uzmanlar, DPA'nın bir yazılım şirketini politikalarını değiştirmeye zorlayıp zorlayamayacağını sorguluyorlar

- Bu gerginlik, hükümetin AI şirketleri üzerindeki otoritesi için emsal teşkil edebilir

Endüstri Etkileri

Anthropic ve Pentagon arasındaki çatışma, ulusal güvenlik kurumlarıyla giderek daha karmaşık bir ilişkiye sahip olan AI endüstrisini sarsıyor. Google, Microsoft, Amazon ve OpenAI'nin tümü önemli savunma sözleşmelerine sahiptir ve her biri teknolojilerinin askeri uygulamaları konusunda iç ve dış baskı altında kalmıştır. Google, 2018'de çalışan protestolarından sonra Pentagon AI programı Project Maven'dan ünlü bir şekilde çekildi, ancak şirket o zamandan beri savunma çalışmalarını genişletmiştir.

Defense Production Act Anthropic'e karşı başarıyla kullanılırsa, Birleşik Devletler'de faaliyet gösteren herhangi bir AI şirketinin, kendi etik yönergelerine bakılmaksızın teknolojisini askeri amaçlar için sağlamaya zorlayabileceğine dair bir emsal oluşturacaktır. Bu olasılık, AI güvenliği araştırmasını durgunlaştırabilir, güvenliğe odaklı şirketleri ABD yargı alanı dışına taşınmaya itebilir veya şirketlerin hükümet sözleşmeleri ile güvenlik taahhütleri arasında seçim yapması gereken iki taraflı bir endüstri oluşturabilir.

Buna karşılık, Anthropic emri başarıyla reddederse — yasal zorluk yoluyla veya siyasi müzakere yoluyla — AI şirketlerinin, müşteri ABD hükümeti olsa bile, teknolojilerinin nasıl kullanıldığı konusunda etik sınırlar koyma hakkına sahip olduğu ilkesini güçlendirebilir.

Daha Geniş Gerilim

Bu gerginlik, büyük dil modelleri ve diğer gelişmiş AI sistemleri açık askeri uygulamalarla yetenekleri göstermeye başladığından beri gelişen temel bir gerilimi yansıtır. ABD hükümeti, AI hakimiyetini ulusal güvenlik için gerekli görmektedir, özellikle daha az etik kısıtlamalarla askeri AI uygulamalarına kaynak ayıran Çin'le rekabette. Pentagon'un perspektifinden, lider bir AI şirketinin savunma uygulamalarından vazgeçmesine izin vermek, ulusun karşılayamayacağı bir lükstür.

Anthropic'in perspektifinden, kısıtlamalar tam olarak şirketin güçlü AI sistemlerinin sınırlandırılmamış askeri uygulamasının felaket riski taşıdığına inanması nedeniyle vardır — bu riskler kullanıcı bir Amerikan üniforması giyse bile ortadan kalkmayan riskler. Şirketin konumu, AI'nın bazı uygulamalarının, kim tarafından talep edilirse edilsin, etkinleştirilmek için çok tehlikeli olduğudur.

Bu gerginliğin nasıl çözüleceği, yakında gelen yıllar için AI endüstrisi ve ABD hükümeti arasındaki ilişkiyi şekillendirecektir. AI güvenliği taahhütlerinin ulusal güvenlik emirlerinin çekim gücüne dayanıp dayanamayacağının — ve hükümetin en güçlü yasal araçlarını bunun mümkün olmadığını sağlamak için kullanıp kullanmayacağının — bir test örneğidir.

Bu makale The Decoder'ın raporlamasına dayanmaktadır. Orijinal makaleyi okuyun.