ఒక చిత్రంనుంచి నావిగేట్ చేయగల 3D ప్రపంచం వరకు

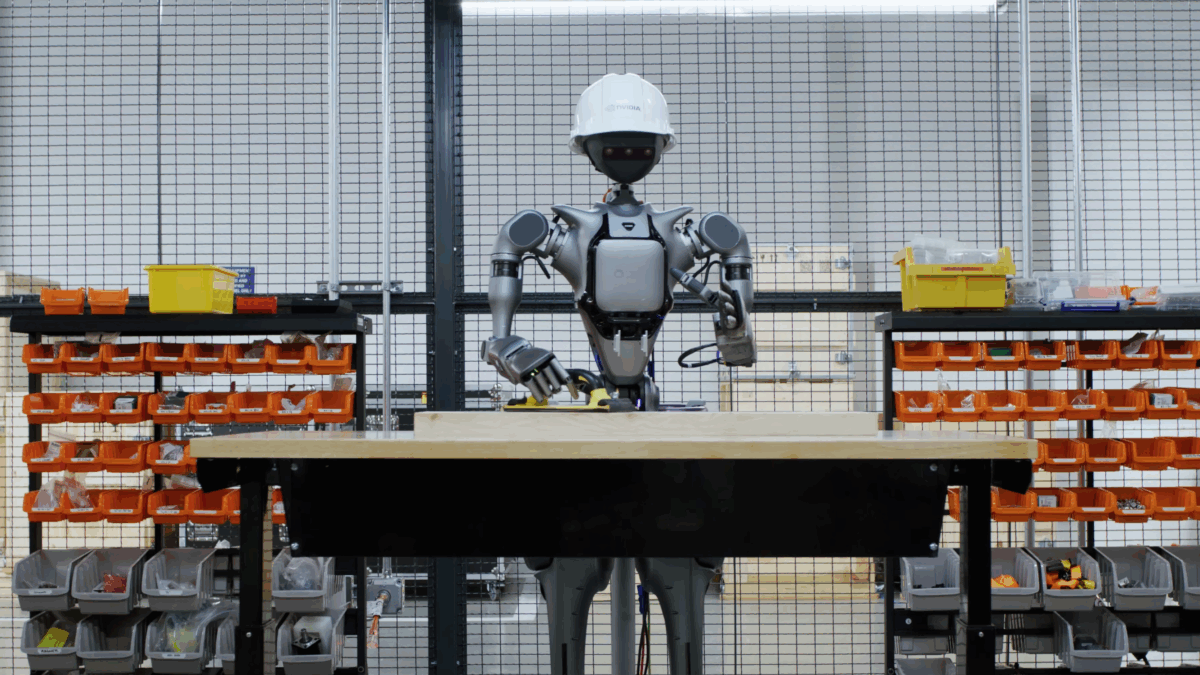

ఎన్వీడియా పరిశోధకులు Lyra 2.0ను పరిచయం చేశారు; ఇది ఒకే ఫోటో నుంచి పెద్ద, సుసంగతమైన 3D వాతావరణాలను సృష్టించడానికి రూపొందించిన వ్యవస్థ. ఈ సన్నివేశాలను real timeలో అన్వేషించవచ్చని, అలాగే Isaac Sim వంటి simulation ప్లాట్ఫారమ్లకు export చేయవచ్చని సంస్థ చెబుతోంది; అక్కడ వాటిని robotics training కోసం ఉపయోగించవచ్చు.

ఈ ఆలోచన ధైర్యవంతమైనదే, కానీ roboticsలో ఆధునిక AIకి ఉన్న ఒక ప్రధాన సమస్యకు బాగా సరిపోతుంది: simulationలో agentsను శిక్షణ ఇవ్వడం భౌతిక ప్రపంచంలో మాత్రమే శిక్షణ ఇవ్వడంకంటే చాలా సులభం, తక్కువ ఖర్చు, మరియు సురక్షితం. అయితే ఉపయోగకరమైన simulation ఇంకా పెద్ద, స్థిరమైన, మరియు తగినంత వాస్తవికమైన వాతావరణాలను నిర్మించడంపైనే ఆధారపడి ఉంటుంది. ఒకే చిత్రం దశాబ్దాల మీటర్ల వరకు విస్తరించే సుసంగతమైన సన్నివేశానికి ఆరంభ బిందువుగా పనిచేస్తే, simulation content సృష్టి ఖర్చు గణనీయంగా తగ్గవచ్చు.

నివేదిక ప్రకారం, Lyra 2.0 సుమారు 90 మీటర్ల పరిధి ఉన్న సన్నివేశాలను సృష్టించగలదు. కానీ కేవలం పరిమాణం కంటే ముఖ్యమైనది, మోడల్ మునుపటి పద్ధతులలో ఉన్న రెండు సాధారణ బలహీనతలను పరిష్కరిస్తుందన్న వాదన: ఇది ఇప్పటికే సృష్టించినదాన్ని మర్చిపోదు, మరియు చిన్న దృశ్యపరమైన లోపాలు పెరిగి పెద్ద వక్రీకరణలుగా మారకుండా నిలువరిస్తుంది.

లాంగ్-పాత్ 3D జనరేషన్ ఎందుకు కష్టం

ప్రస్తుత 3D scene generation AI వ్యవస్థలు, virtual camera తన ప్రారంభ బిందువునుంచి మరింత దూరంగా వెళ్లినప్పుడు తరచూ క్షీణిస్తాయి. రంగులు మారిపోతాయి, geometry మారుతుంది, మరియు వాతావరణం సుసంగతిని కోల్పోతుంది. camera తర్వాత ఇప్పటికే చూసిన ప్రాంతానికి తిరిగి వస్తే, model ఆ ప్రదేశాన్ని మునుపటి continuityని కాపాడకుండా దాదాపు మళ్లీ సృష్టించవచ్చు.

రోబోటిక్స్కు, ఇవి కేవలం దృశ్యపరమైన తప్పులు కావు. అన్వేషణ సమయంలో స్వల్పంగా రూపం మార్చుకుంటూ ఉండే simulation వాతావరణం, స్థిరమైన స్థల నిర్మాణంపై ఆధారపడే embodied systems trainingకు బలహీనమైన పునాది. ప్రపంచమే స్థిరంగా లేకపోతే navigation, manipulation, మరియు planning అన్నీ తక్కువ నమ్మకంగా మారతాయి.

అందుకే scene coherence novelty కంటే ముఖ్యమైనది. ఉపయోగకరమైన training worldకు, ఒక agent అది కేవలం possible images ప్రవాహం కాకుండా ఒక స్థలంలా దానిలోంచి నడవగలిగేంత స్థిరత్వం ఉండాలి.

Lyra 2.0 సమస్యను ఎలా పరిష్కరించేందుకు ప్రయత్నిస్తుంది

నివేదిక ప్రకారం, Lyra 2.0 ప్రతి generated frame కోసం 3D geometryని నిల్వ చేస్తుంది. virtual camera ముందే చూసిన ప్రాంతానికి తిరిగి వచ్చినప్పుడు, సిస్టమ్ ఆ పాత framesను తిరిగి తెచ్చి, వాటి spatial informationను reference materialగా ఉపయోగిస్తుంది. image synthesis ఇంకా video model ద్వారా జరుగుతుంది, కానీ నిల్వ చేసిన geometry orientationను కాపాడి continuityని నిలుపుకోవడమే లక్ష్యం.

ఈ రూపకల్పన మొదటి ప్రధాన బలహీనతైన మరచిపోవడాన్ని లక్ష్యంగా తీసుకుంది. ఇప్పటికే చూసిన ప్రాంతాలను stored geometry ద్వారా మళ్లీ గుర్తించి spatially re-ground చేయగలిగితే, సృష్టించిన వాతావరణం పొడవైన trajectories అంతటా మరింత సుసంగతంగా ఉంటుంది.

రెండవ సమస్య drift, అంటే చిన్న generation లోపాలు దశలవారీగా కూడికైపోవడం. నివేదిక ప్రకారం, ఎన్వీడియా పరిష్కారం modelని దాని స్వంత లోపభూయిష్ట outputsతో శిక్షణ ఇవ్వడం, తద్వారా degradationను కేవలం అనుసరించకుండా గుర్తించి సరిచేయడం నేర్చుకుంటుంది. ఇది ప్రాయోగిక వ్యూహం. generation శుభ్రంగా ఉంటుందని ఊహించడంకన్నా, training process modelను అది సృష్టించే noiseకు పరిచయం చేస్తుంది.

Benchmark దావాలు మరియు పోటీ సందర్భం

రెండు datasetsపై benchmark పరీక్షల్లో GEN3C, Yume-1.5, మరియు CaM సహా ఆరు పోటీ విధానాలను Lyra 2.0 మించిందని ఎన్వీడియా చెబుతోంది. ఆ మూల్యాంకనాల పూర్తి వివరాలు నివేదికలో లేనందున, ఈ పోటీ దావాను పూర్తిస్థాయి సాంకేతిక పోలికగా కాకుండా ఒక సారాంశంగా పరిగణించాలి. అయినప్పటికీ, దీని ప్రాముఖ్యత స్పష్టంగా ఉంది: ఎన్వీడియా Lyra 2.0ను ప్రయోగశాల ఆసక్తిగా కాదు, దీర్ఘ-దూర scene generationలో ఒక state-of-the-art contenderగా చూపిస్తోంది.

ఈ framing ముఖ్యమైనది, ఎందుకంటే ఈ రంగం చాలా రద్దీగా ఉంది. అనేక బృందాలు image-to-3D, video world models, మరియు simulation-friendly generative systemsపై పని చేస్తున్నాయి. ప్రత్యేకంగా కనిపించాలంటే, ఒక విధానం కేవలం ఆకట్టుకునే demosనే కాదు, కదలికల సమయంలో స్థిరమైన scene qualityని చూపించాలి.

రోబోటిక్స్ ఎందుకు తక్షణ వినియోగం

Isaac Sim వంటి physics enginesకు నేరుగా export చేసే మార్గం నివేదికలోని అత్యంత ముఖ్యమైన వివరాలలో ఒకటి. ఇది ఎన్వీడియా కేవలం visualization లేదా virtual tours కోసం content generationలో ఆసక్తి చూపడం లేదని సూచిస్తుంది. లక్ష్యం embodied AI.

రోబో శిక్షణ తరచూ data bottleneckను ఎదుర్కొంటుంది. నిజ ప్రపంచ డేటాను సేకరించడం ఖరీదైనది, చేతితో simulation వాతావరణాలను నిర్మించడం సమయం తీసుకుంటుంది. ఒక ఫోటోనుంచి plausible, అన్వేషించగల 3D స్థలాలను సృష్టించే వ్యవస్థ, ముఖ్యంగా navigation లేదా interaction పనుల కోసం environmental diversityని వేగంగా పెంచడంలో సహాయపడుతుంది.

ప్రయోగాత్మకంగా, దీని వల్ల developers sparse visual referencesతో మొదలుపెట్టి, వాటిని వేగంగా ఉపయోగకరమైన simulation scenesగా విస్తరించవచ్చు. ఇది real-world validationను భర్తీ చేయదు, కానీ pretraining మరియు testing pipelineను విస్తరించగలదు.

ఇది ఏమి పరిష్కరిస్తుంది, ఏమి కాదు

Lyra 2.0 నిజమైన సాంకేతిక అడ్డంకిని పరిష్కరిస్తోంది, కానీ దీనిని పూర్తి భౌతిక వాస్తవికతగా భావించకూడదు. సుసంగతమైన sceneను సృష్టించడం ఒకటి. geometry, materials, dynamics, మరియు object affordances నిజమైన రోబోట్లకు robust transferకు సరిపడా ఖచ్చితంగా ఉండే sceneను సృష్టించడం మరోటి.

simulation నిజ ప్రపంచంలో కూడా నిలిచే ప్రవర్తనలను నేర్పినప్పుడే విలువైనది. అద్భుతమైన visual coherence కూడా స్వయంగా ఉపయోగకరమైన physics లేదా సరైన object interactionను హామీ ఇవ్వదు. ఎన్వీడియా నివేదిక దీనిని పరోక్షంగా అంగీకరిస్తోంది, ఎందుకంటే ఇది physics enginesకు export చేయడంపై దృష్టి పెడుతోంది; అంటే Lyra output పెద్ద simulation stackలోని ఒక భాగం మాత్రమే, పూర్తి పరిష్కారం కాదు.

పెరుగుతున్న world generation వైపు ఒక అడుగు

అయినా, ఈ పని ముఖ్యమైనది; ఎందుకంటే ఇది రంగాన్ని రోబో శిక్షణ ప్రపంచాలను నిర్మించడానికి మరింత scalable మార్గం వైపు తీసుకెళ్తుంది. long-path coherence, స్పష్టమైన geometry recall, మరియు drift-aware training కలయిక ముందు వ్యవస్థలను పరిమితం చేసిన సరిగ్గా అదే సమస్యలను ఎదుర్కొంటుంది. ఈ లాభాలు విస్తృత వినియోగంలోనూ నిలిస్తే, Lyra 2.0 robotics developmentలోని ఒక దాగిన ఖర్చు, అంటే నేర్చుకోవడానికి తగిన ప్రపంచాలను నిర్మించడం, తగ్గించడంలో సహాయపడుతుంది.

అదే లోతైన ప్రాముఖ్యత. Robotics progress కేవలం మెరుగైన policies మరియు పెద్ద models గురించే కాదు. అది మెరుగైన environments గురించీ. ఒక రోబో దానికి కనిపించే ప్రపంచాల నుంచే నేర్చుకోగలదు, మరియు ఆ ప్రపంచాలను బాగా రూపొందించడం మరింత ముఖ్యమైన AI సమస్యగా మారుతోంది.

ఈ వ్యాసం The Decoder నివేదిక ఆధారంగా ఉంది. మూల వ్యాసాన్ని చదవండి.

Originally published on the-decoder.com