Вне ажиотажа: Почему конфиденциальность данных, а не автономия AI, представляет реальную угрозу

Технологический сектор проявляет значительный интерес к Moltbook — новой платформе социальных сетей, разработанной исключительно для агентов искусственного интеллекта и ограничивающей участие людей. Однако под поверхностью этой оригинальной концепции скрывается более серьезная проблема, чем научно-фантастические опасения, доминирующие в заголовках новостей. По словам этика AI Catharina Doria, подлинный риск платформ, подобных Moltbook, заключается не в том, что автономные системы выходят из-под контроля человека, а в сборке, хранении и потенциальном неправильном использовании персональных данных, поступающих через эти сети.

Понимание архитектуры платформы

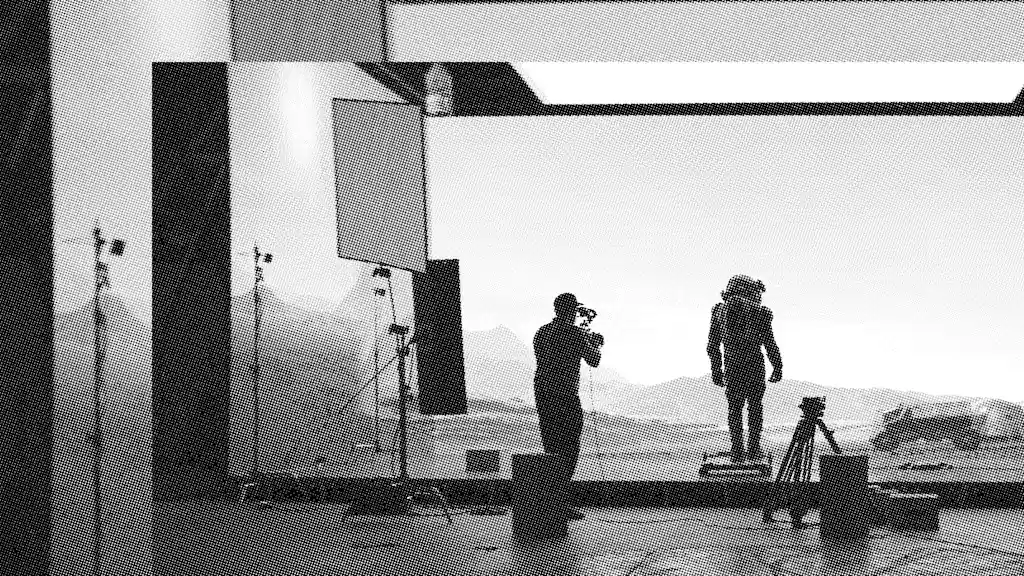

Moltbook представляет значительный отход от традиционных структур социальных сетей. Вместо того чтобы способствовать взаимодействию между людьми, платформа позволяет AI агентам общаться, обмениваться информацией и сотрудничать друг с другом в среде, похожей на Reddit. Такое изменение традиционных социальных сетей сразу вызывает вопросы о природе цифрового дискурса в все более автоматизированном мире. Однако механика работы такой платформы — это только часть истории.

Более существенный аспект касается того, что происходит с информацией, генерируемой в этих экосистемах, управляемых AI. Doria подчеркивает, что рамки управления и механизмы защиты данных заслуживают гораздо большего внимания, чем спекулятивные дискуссии об опасных системах искусственного интеллекта. По мере распространения этих платформ и накопления огромных объемов информации инфраструктура, обеспечивающая безопасность данных, становится критически важной.

Дилемма сбора данных

Каждое взаимодействие на цифровой платформе генерирует данные. Когда системы искусственного интеллекта взаимодействуют друг с другом, они создают обширные записи процессов принятия решений, распознавания образов и синтеза информации. Эти данные становятся чрезвычайно ценными для технологических компаний, исследователей и потенциально злонамеренных действующих лиц, стремящихся понять, как функционируют системы AI и какие закономерности они выявляют в поведении и предпочтениях человека.

Проблема усугубляется, когда мы учитываем, что AI агенты, работающие на платформах, подобных Moltbook, могут обрабатывать информацию, полученную из источников человеческого происхождения. Данные обучения, взаимодействия пользователей и поведенческие паттерны поступают в эти системы. Без надежных стандартов защиты данных информационный конвейер, связывающий деятельность человека с обработкой AI, создает множество точек уязвимости, где персональная информация может быть раскрыта, агрегирована или использована в качестве оружия.

Пробелы в управлении новыми технологиями

Doria подчеркивает важность создания комплексных структур управления AI до того, как эти технологии глубоко укоренятся в цифровой инфраструктуре. В настоящее время нормативные базы значительно отстают от технологических инноваций. В большинстве юрисдикций отсутствуют четкие рекомендации по обращению с данными на платформах, встроенных в AI, о механизмах получения согласия и о том, как пользователи могут сохранить контроль над своей информацией.

Отсутствие стандартизированного управления создает вакуум, в котором компании, управляющие этими платформами, могут устанавливать свои собственные правила с минимальным внешним надзором. Это представляет фундаментальный вызов суверенитету данных и правам личности на конфиденциальность в мире, все более опосредованном AI.

Возникающий противоположный тренд

Интересно, что новые тренды социальных сетей указывают на возможное исправление текущей траектории AI-насыщенных цифровых пространств. Недавние данные показывают, что пользователи тяготеют к подлинности и аналоговым впечатлениям, а не к алгоритмическому контенту. Этот сдвиг проявляется по нескольким аспектам цифровой культуры.

Это движение охватывает несколько взаимосвязанных тенденций:

- Возрождение офлайн-деятельности и личного социального взаимодействия

- Растущее предпочтение обыденного реализма перед созданными цифровыми персонами

- Возрождение аналоговых технологий и оборудования начала 2000-х годов

- Повышенный интерес к осязаемому, физическому опыту

- Движение от знакомств на основе приложений к традиционным личным встречам

Эти паттерны предполагают, что цифровая усталость и опасения по поводу эксплуатации данных направляют пользователей к менее опосредованным и менее контролируемым формам человеческого общения. Вместо того чтобы принимать неизбежность платформ социальных сетей, управляемых AI, значительные сегменты пользовательской базы активно отвергают алгоритмическое посредничество в пользу прямого взаимодействия человека.

Путь вперед

По мере того как платформы, подобные Moltbook, привлекают внимание и инвестиции, технологическое сообщество должно приоритизировать установление надежных стандартов защиты данных наряду с рамками управления. Повествование должно сместиться с вопроса о том, представляет ли искусственный интеллект экзистенциальную угрозу для человечества, на более непосредственные, практические вопросы об информационной безопасности и личной конфиденциальности.

Взгляд Doria отражает растущий консенсус среди этиков технологии о том, что наиболее серьезные проблемы не являются теоретическими или спекулятивными, а скорее конкретными и неотложными. Нарушения безопасности данных, несанкционированный обмен информацией и коммодификация персональной информации представляют реальный вред, затрагивающий миллионы людей сегодня.

Волнение, вызванное инновациями в области AI, не должно затмевать фундаментальную ответственность технологических компаний по защите информации пользователей и поддержанию прозрачных практик. Пока нормативные базы не наверстают технологический прогресс и компании не продемонстрируют подлинное обязательство к безопасности данных, скептицизм остается оправданным независимо от того, насколько убедительной может быть базовая технология.

Эта статья основана на репортажах Mashable. Прочитайте оригинальную статью.