Android devient une plateforme d’IA plus active

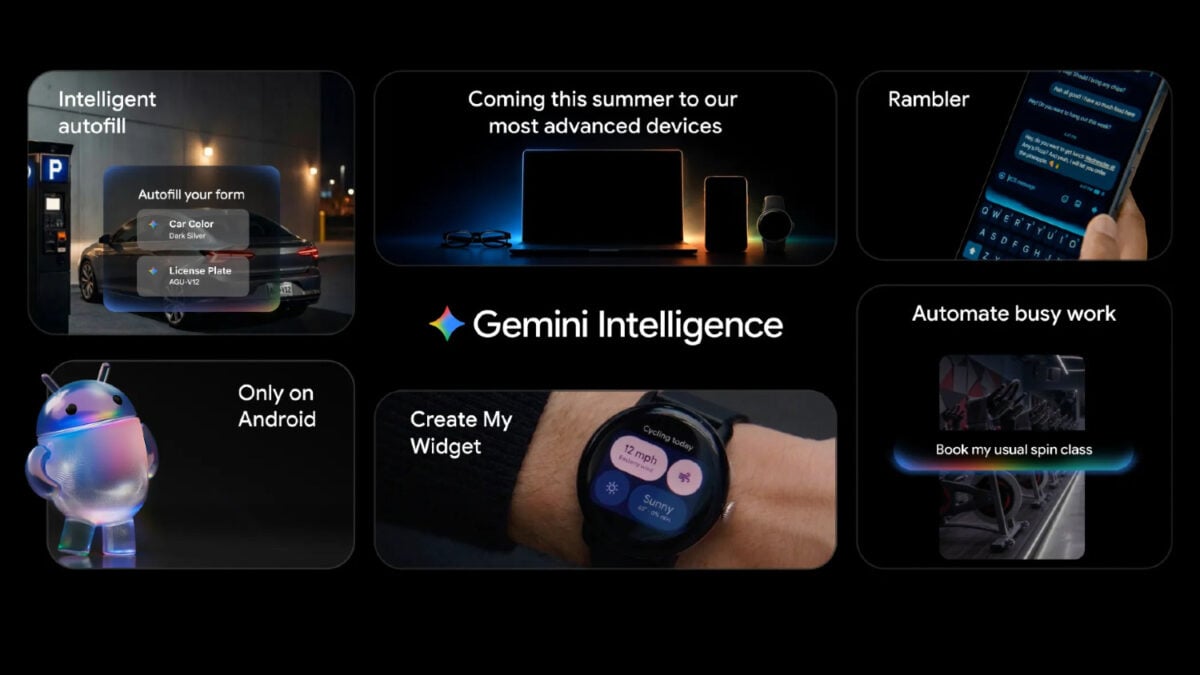

Google prépare une poussée plus large de Gemini sur Android, en allant au-delà d’un simple chatbot autonome pour l’intégrer plus profondément au système d’exploitation lui-même. À l’approche de sa conférence développeurs Google I/O, l’entreprise a annoncé Gemini Intelligence, une suite de fonctions dopées à l’IA conçue pour intégrer Gemini plus directement dans l’usage mobile quotidien.

Le message de Google est explicite : l’objectif n’est pas seulement de répondre à des requêtes, mais d’aider les utilisateurs à accomplir des tâches de façon proactive à travers les applications et les services. L’entreprise affirme que Gemini Intelligence apportera ce qu’elle considère comme le meilleur de Gemini à ses appareils les plus avancés grâce à un mélange de matériel et de logiciel haut de gamme.

Ce choix de mots compte, car il renvoie à une tendance familière dans l’IA grand public. La concurrence se déplace de “qui a un chatbot” vers “qui peut intégrer l’IA aux gestes du quotidien”. Selon Google, Android devient un terrain d’essai pour ce basculement.

De l’assistant à l’opérateur

La fonctionnalité la plus déterminante est l’automatisation des tâches. Google a décrit Gemini Intelligence comme capable de gérer des activités réparties sur plusieurs applications, une étape vers le modèle agentique que de nombreuses grandes plateformes laissent entrevoir depuis des mois.

Les exemples choisis par Google sont pratiques plutôt que spectaculaires. Le système pourrait aider les utilisateurs à obtenir un vélo en première ligne pour un cours de spinning, trouver un syllabus de cours dans Gmail, puis ajouter les livres requis à un panier d’achat. Il peut aussi prendre en photo une liste de courses et remplir un panier Instacart avec les articles correspondants.

Ces exemples suggèrent que Google parie sur la commodité, et non sur la conversation, comme argument de consommation le plus convaincant pour l’IA sur les téléphones. Si la fonction fonctionne de manière fiable, elle réduit le nombre de taps et de changements d’application nécessaires pour passer de l’intention à l’action. Si elle fonctionne de manière irrégulière, elle risque de transformer des courses ordinaires en échecs d’automatisation opaques.

Le point stratégique est clair dans tous les cas. Google veut que Gemini agisse à l’intérieur du logiciel, pas seulement qu’il en parle.

Rambler et la prochaine phase de la saisie vocale

Une autre fonction mise en avant est Rambler, un outil de reconnaissance vocale conçu pour tenir compte des habitudes naturelles de la parole, y compris les tics de langage et les répétitions. Plutôt que d’exiger des utilisateurs qu’ils dictent proprement, Google indique que Rambler peut identifier les éléments importants de ce qui a été dit et les transformer en un message concis.

Cela peut sembler progressif, mais cela répond à une vraie faiblesse des interfaces vocales. Beaucoup de gens ne parlent pas en phrases nettes, prêtes à être ponctuées. Ils se corrigent en temps réel, répètent des formules et s’écartent du sujet avant d’aller au fond. Un système capable de distiller clairement ce type de parole pourrait rendre la saisie vocale plus utile dans les contextes de messagerie et de prise de notes.

Google dit aussi que Rambler peut passer d’une langue à l’autre au sein d’un même message. Cette fonction reflète la manière dont la communication multilingue fonctionne en pratique, surtout dans les régions où le code-switching est courant plutôt qu’exceptionnel.

L’entreprise a aussi ajouté un signal de confidentialité, indiquant que Rambler affiche clairement lorsqu’il est activé et que l’audio est utilisé uniquement pour la transcription en temps réel, sans être stocké ni enregistré.

Données personnelles, contrôles d’opt-in et extension au navigateur

Google étend également le remplissage automatique alimenté par l’IA via Gemini Intelligence. Le système peut remplir des formulaires et des champs de texte au nom de l’utilisateur en s’appuyant sur Personal Intelligence, une couche d’opt-in qui donne à Gemini accès à des informations comme l’historique YouTube et les enregistrements de recherche Google.

Cela deviendra probablement l’un des aspects les plus contestés du déploiement. D’un côté, le remplissage automatique devient plus utile lorsqu’il connaît le contexte de l’utilisateur. De l’autre, cette profondeur contextuelle soulève des inquiétudes prévisibles sur ce qu’un assistant personnel devrait savoir et sur le degré de confiance avec lequel les utilisateurs accepteront de transmettre ces données. La réponse de Google consiste à souligner que la fonction repose strictement sur l’opt-in.

Gemini s’enfonce aussi davantage dans Chrome pour Android. Google indique que l’assistant pourra résumer et comparer des contenus sur le web, à l’image des expériences sur ordinateur, et qu’il disposera d’une capacité de navigation automatique capable d’automatiser des tâches basées sur le navigateur, comme la prise de rendez-vous.

Cela étend la même logique opérationnelle des applications au web : l’IA est positionnée comme une couche d’action entre les utilisateurs et des interfaces initialement conçues pour une navigation manuelle.

Un déploiement progressif aux implications plus larges

Google précise que les nouvelles fonctions arriveront par vagues, en commençant par les derniers téléphones Samsung Galaxy et Google Pixel. L’entreprise a aussi indiqué que certaines capacités liées à Chrome sont attendues en juin.

Ce déploiement progressif souligne une réalité importante du marché actuel de l’IA. Même lorsque les entreprises décrivent des avancées logicielles en termes universels, elles les lancent souvent d’abord comme des fonctions réservées aux appareils premium. Cela peut aider à maîtriser les attentes de performance et les contraintes matérielles, mais cela signifie aussi que la prochaine phase de l’IA sur smartphone pourrait d’abord n’être disponible que pour un groupe plus restreint d’utilisateurs.

Malgré tout, l’annonce marque un changement de direction clair. Gemini n’est plus présenté principalement comme un assistant optionnel à côté d’Android. Il est tissé dans les comportements mobiles essentiels : saisir du texte, naviguer, acheter, planifier et coordonner d’une application à l’autre.

Que les utilisateurs l’adoptent dépend de deux questions encore sans réponse. La première est la fiabilité. Les promesses agentiques ne sont convaincantes que lorsque le système peut accomplir des tâches avec précision et de manière prévisible. La seconde est la confiance. Plus ces systèmes deviennent capables, plus ils dépendent d’un accès au contexte personnel, et plus les utilisateurs doivent décider si l’échange en vaut la peine.

Google a choisi d’avancer simultanément sur ces deux fronts. Cela fait de Gemini Intelligence l’un des changements Android les plus importants à surveiller, non parce qu’il prouve que l’IA mobile est achevée, mais parce qu’il montre à quel point les plateformes veulent désormais que l’IA se fonde dans le système d’exploitation et commence à agir au nom de l’utilisateur.

Cet article s’appuie sur un reportage de Gizmodo. Lire l’article original.

Originally published on gizmodo.com