La Perception comme Sécurité, Pas Seulement Comme Performance

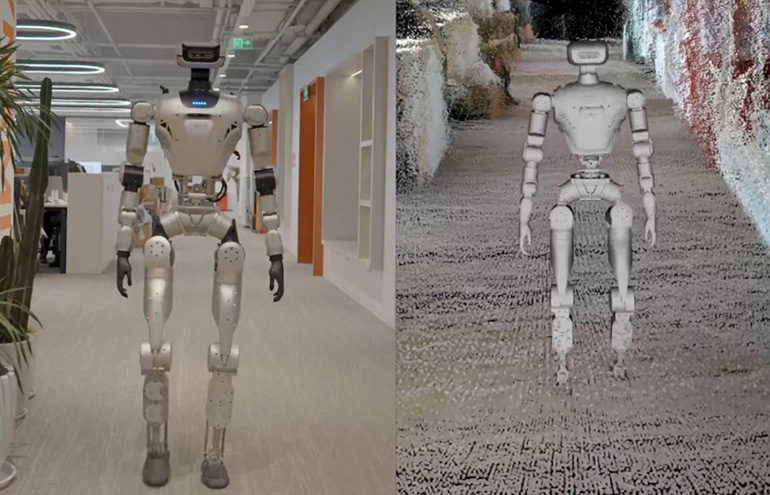

À mesure que les robots humanoides font la transition des environnements de recherche vers le déploiement commercial et industriel, les cadres techniques pour la façon dont ils perçoivent et naviguent dans le monde deviennent aussi importants que leurs capacités physiques. À NVIDIA GTC 2026, RealSense a démontré la navigation de robots humanoides avec LimX Dynamics, présentant une architecture perceptuelle qui traite la sécurité comme une contrainte de conception primaire plutôt que comme une réflexion tardive.

Nadav Orbach, PDG de RealSense, a formulé le défi directement : les humanoides opèrent en trois dimensions, aux côtés de personnes, dans des environnements qui changent constamment. Si les robots vont travailler en toute sécurité aux côtés des humains, la perception porte une responsabilité au-delà des capteurs bruts. Elle doit fonctionner comme le cortex visuel du robot, permettant une localisation précise, l'évitement de collisions, la compréhension du terrain et un mouvement stable et prévisible dans des environnements non structurés.

La Base Technique : CuVSLAM et Détection de Profondeur

La démonstration de RealSense a utilisé des caméras de profondeur et CuVSLAM de NVIDIA - une bibliothèque de localisation et cartographie simultanées visuelles accélérée par GPU - pour permettre une cartographie 3D en temps réel et une localisation sur la plateforme humanoide LimX. SLAM est une capacité fondamentale pour la navigation autonome : elle permet à un robot de construire une carte de son environnement tout en suivant simultanément sa propre position dans cette carte, sans dépendre d'infrastructures externes comme GPS ou des balises préinstallées.

Les caméras de profondeur fournissent les données de plage nécessaires pour construire des représentations 3D précises de l'environnement, détectant les obstacles à diverses distances et hauteurs. Pour un robot humanoïde bipède naviguant dans un terrain conçu pour les humains - incluant des escaliers, des rampes, des passages étroits et des sols encombrés - une compréhension précise du terrain 3D est essentielle pour une locomotion sûre. Un robot qui ne voit qu'en 2D ou qui a une perception de profondeur limitée est plus susceptible de mal juger les obstacles et de tomber ou de entrer en collision avec des personnes et des objets.

Le CuVSLAM de NVIDIA s'exécute sur les modules de calcul en périphérie Jetson de la société, de plus en plus intégrés dans les plates-formes robotiques pour fournir la puissance de calcul nécessaire au traitement visuel en temps réel. En accélérant SLAM sur le matériel GPU, CuVSLAM peut traiter les données de profondeur à des vitesses suffisamment rapides pour les environnements dynamiques où les positions des personnes et des obstacles changent continuellement.

L'Impératif de Sécurité dans la Collaboration Humain-Robot

L'accent sur la sécurité dans la présentation GTC de RealSense reflète un changement plus large dans la façon dont l'industrie de la robotique aborde le déploiement de robots mobiles capables dans des espaces partagés avec les humains. Les robots industriels ont historiquement fonctionné dans des environnements fermés pour éviter les collisions humain-robot. Les robots collaboratifs ont introduit des bras à force limitée qui peuvent fonctionner à plus grande proximité des personnes. Les robots humanoides représentent l'étape suivante : des plates-formes conçues pour naviguer librement dans des environnements humains et potentiellement interagir directement avec les personnes.

Cela crée un régime de sécurité différent. Un robot humanoïde se déplaçant dans un entrepôt, sur le sol d'une usine ou dans un environnement de vente au détail doit faire face à des mouvements humains imprévisibles, un éclairage varié, des surfaces réfléchissantes qui confondent les capteurs de profondeur et un terrain qui peut changer de manière inattendue. Les chutes sont particulièrement dangereuses : un robot humanoïde de toute taille importante peut blesser une personne sur laquelle il tombe.

La plateforme LimX dans la démonstration de RealSense semble conçue pour aborder ces scénarios grâce à une perception redondante - utilisant plusieurs modalités de caméra et un traitement accéléré par GPU pour maintenir un modèle environnemental fiable même dans des conditions qui pourraient dérouter un système moins capable.

Le Contexte GTC : La Poussée Robotique de Nvidia

NVIDIA GTC 2026 a présenté un groupe inhabituellement dense d'annonces de robotique, reflétant l'engagement déclaré de Jensen Huang de faire de la robotique un pilier commercial majeur aux côtés de l'IA data center. La plateforme Jetson de Nvidia et la pile de robotique Isaac positionnent l'entreprise comme le fournisseur de calcul dominant pour les systèmes autonomes - un rôle analogue à celui que les GPU jouent maintenant dans la formation et l'inférence de l'IA.

La démonstration RealSense-LimX est un exemple de la façon dont Nvidia permet un écosystème d'entreprises de robotique de construire des systèmes capables sur sa pile matérielle et logicielle. En fournissant CuVSLAM comme une bibliothèque prédéfinie optimisée pour le matériel Nvidia, l'entreprise réduit le fardeau du développement sur les entreprises de robotique et normalise la couche de calcul - une stratégie qui a bien fonctionné sur le marché du data center IA.

L'implication plus large est que la navigation de robots humanoides approche d'un niveau de maturité où le déploiement commercial dans des environnements industriels contraints devient possible, avec des architectures perceptuelles axées sur la sécurité comme l'approche RealSense fournissant l'infrastructure habilitante. La question n'est plus de savoir si les robots peuvent naviguer dans des espaces humains, mais s'ils peuvent le faire de manière suffisamment fiable et sûre pour fonctionner sans supervision humaine constante.

Cet article est basé sur les reportages de The Robot Report. Lisez l'article original.

Originally published on therobotreport.com